워프드 그래디언트 디센트를 통한 효율적인 메타 학습

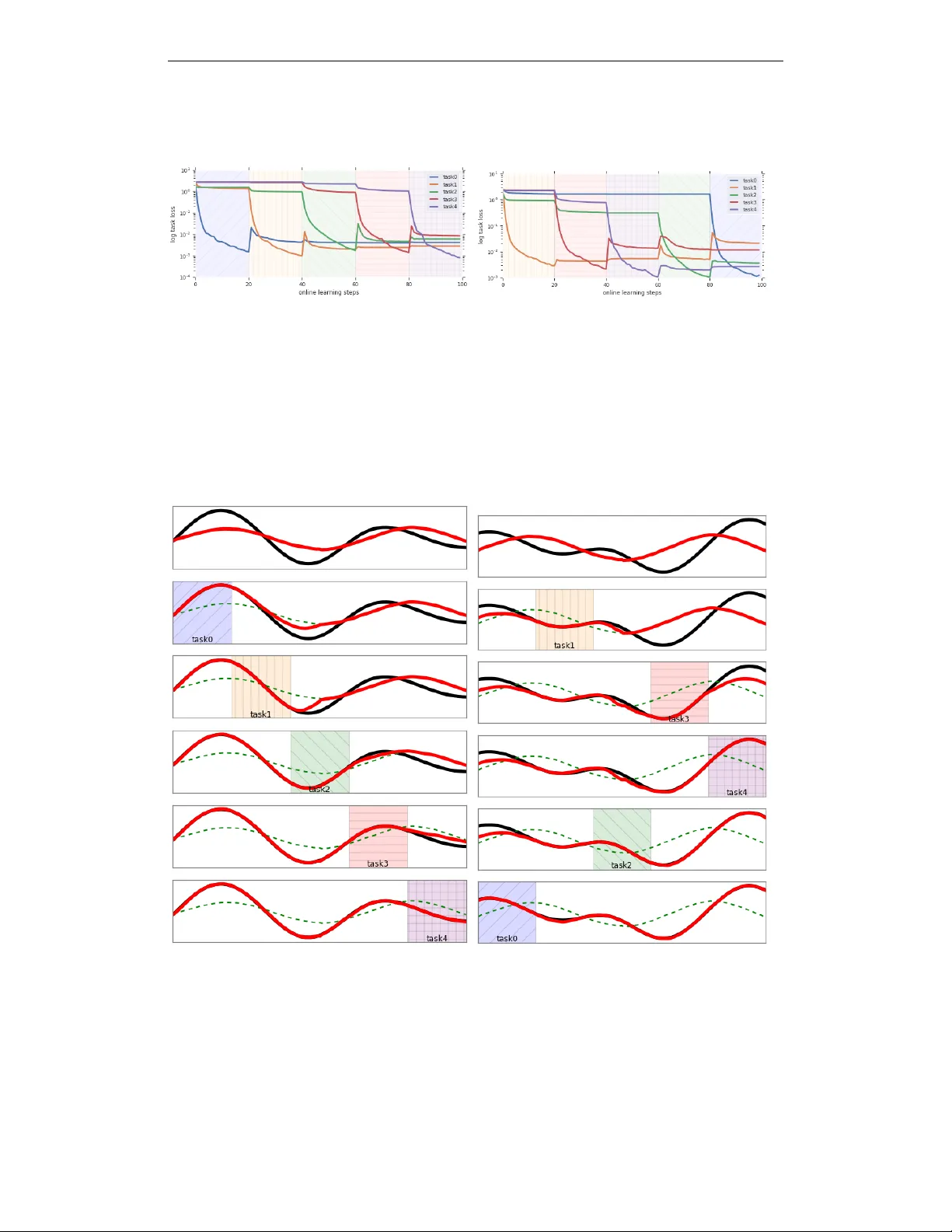

WarpGrad는 태스크 간 학습을 가속화하기 위해, 각 레이어 사이에 비선형 워프 레이어를 삽입해 사전조건(preconditioning) 행렬을 메타 학습한다. 워프 레이어는 학습 과정에 대한 역전파 없이 메타 파라미터를 업데이트하며, 이는 기존 MAML 계열이 겪는 계산·그래디언트 소실 문제를 회피한다. 실험 결과, few‑shot 이미지 분류, 다중‑샷 학습, 강화학습, 연속학습 등 다양한 도메인에서 기존 최첨단 방법들을 능가한다.

저자: Sebastian Flennerhag, Andrei A. Rusu, Razvan Pascanu

본 논문은 메타‑러닝에서 “빠른 태스크 적응”을 위한 효율적인 업데이트 규칙을 학습하는 새로운 프레임워크인 **Warped Gradient Descent (WarpGrad)** 를 제안한다. 기존 접근법은 크게 두 가지로 나뉜다. 첫 번째는 메모리 기반 메타‑러너가 직접 파라미터 업데이트를 생성하도록 학습하는 방법으로, 이론적으로는 모든 학습 규칙을 표현할 수 있으나, 강력한 사전조건이 부족해 수렴 보장이 약하고 학습이 불안정하다. 두 번째는 MAML 계열처럼 초기값이나 학습률을 메타‑학습하는 방법으로, 그래디언트 기반 업데이트라는 강력한 inductive bias를 유지하지만, 메타‑그라디언트를 얻기 위해 전체 학습 과정을 역전파해야 하므로 few‑shot 상황에만 적용 가능하고, 메모리·연산 비용이 급증한다.

WarpGrad는 이 두 접근법의 장점을 결합한다. 핵심 아이디어는 **Warp‑layer** 라는 비선형 변환을 태스크‑러너(학습 네트워크)의 각 레이어 사이에 삽입하는 것이다. Warp‑layer는 파라미터 \(\theta\)와 메타 파라미터 \(\phi\)를 입력받아 새로운 활성화를 생성하고, 역전파 과정에서 그 Jacobian \(D_x\omega\) 를 통해 그래디언트를 암묵적으로 사전조건한다. 즉, 명시적인 사전조건 행렬 \(P(\theta;\phi)\) 를 설계하지 않고, Warp‑layer 자체가 데이터‑조건부, 비선형 사전조건을 제공한다.

수학적으로는 일반적인 사전조건 업데이트 \(\theta \leftarrow \theta - \alpha P(\theta;\phi)\nabla L(\theta)\) 를, \(P\) 를 \(D_x\omega\) 의 곱으로 대체한다. 비선형성을 도입함으로써 기존 T‑Net이 제공하던 블록 대각선 형태를 넘어, 전역적인, 데이터‑의존적인 사전조건을 학습한다.

메타‑학습 목표는 **trajectory‑agnostic** 하다. 기존 MAML은 K‑step 전체를 역전파해 \(\partial L_{\text{meta}}/\partial \phi\) 를 구한다. 반면, WarpGrad는 사전조건이 현재 파라미터 상태만을 필요로 하는 1‑order Markov 프로세스라는 점을 이용해, 메타 목표를

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기