편향 없는 CNN으로 잡음에 강한 이미지 복원

본 논문은 기존 이미지 디노이징 CNN이 학습 시 사용한 편향(bias) 때문에 특정 잡음 수준에 과적합되는 문제를 지적한다. 모든 층에서 편향을 제거한 “bias‑free” 네트워크를 제안하고, 이는 잡음 수준이 학습 범위를 벗어나도 견고하게 일반화되며, 선형성으로 인해 Jacobian 기반의 해석이 가능함을 보인다. 실험을 통해 다양한 최신 아키텍처에 적용했을 때 동일한 성능 향상을 확인한다.

저자: Sreyas Mohan, Zahra Kadkhodaie, Eero P. Simoncelli

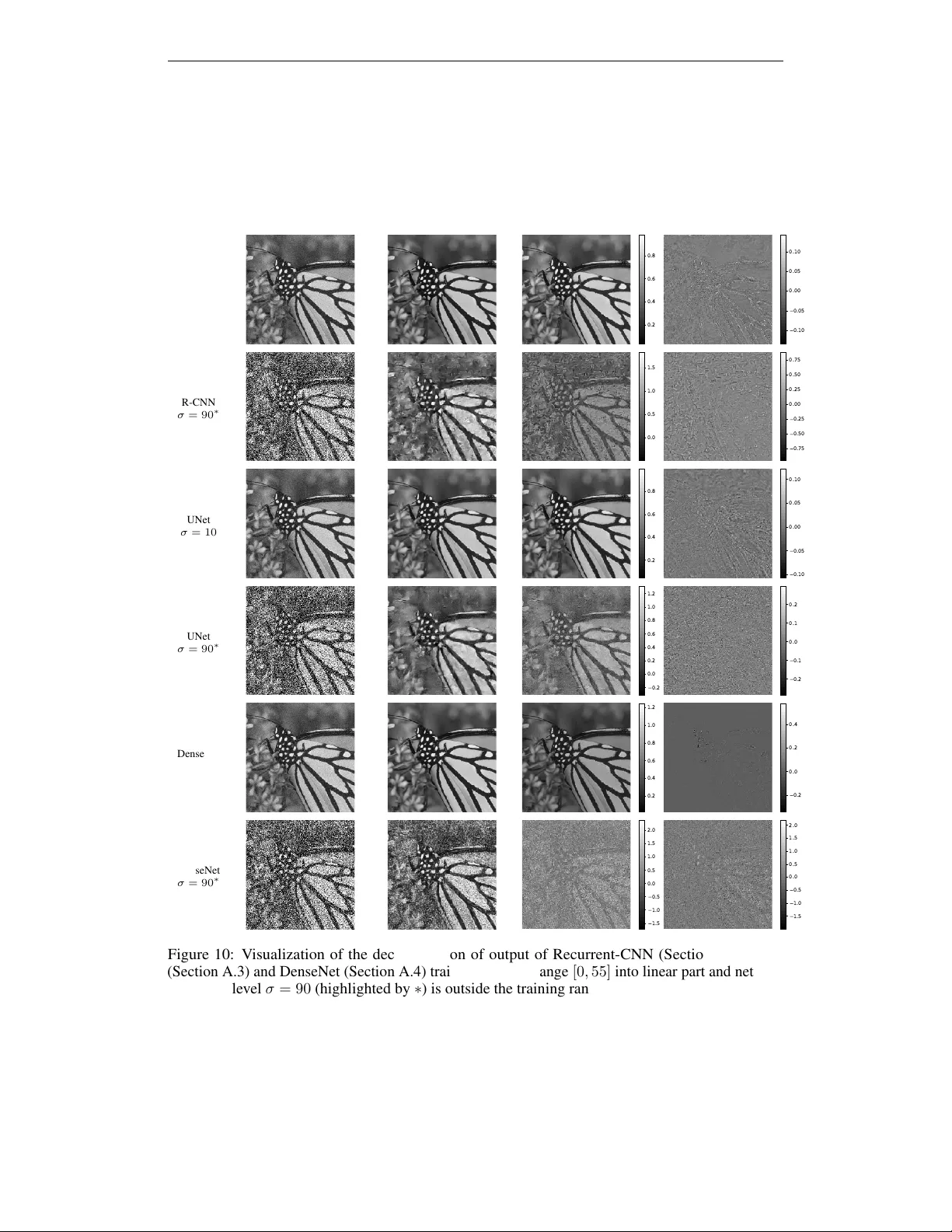

본 논문은 이미지 디노이징 분야에서 널리 사용되는 심층 합성곱 신경망(CNN)이 학습 과정에서 각 층에 삽입되는 상수 편향(bias)과 배치 정규화의 이동 파라미터가 실제로는 모델의 일반화 능력을 저해한다는 점을 체계적으로 조사한다. 기존의 대표적인 블라인드 디노이징 모델인 DnCNN을 비롯해 UNet, DenseNet, Recurrent CNN 등 다양한 최신 아키텍처를 대상으로, 잡음 표준편차 σ가 0~100 사이인 데이터를 이용해 학습시킨 뒤, 학습 범위를 벗어난 σ(예: 90)에서의 성능을 평가한다. 실험 결과, 모든 모델이 학습 범위 내에서는 높은 PSNR을 기록하지만, 학습 범위를 초과하는 잡음 수준에서는 PSNR이 급격히 하락한다. 이는 네트워크 출력 y − f(y) = (I − A_y) y − b_y 식에서 나타나는 ‘net bias’ b_y가 학습 범위 밖에서 크게 증가하기 때문이다.

논문은 이러한 현상을 해결하기 위해 “bias‑free” 네트워크(BF‑CNN)를 제안한다. BF‑CNN은 모든 층에서 편향을 완전히 제거하고, 배치 정규화의 이동 파라미터도 0으로 고정한다. ReLU 활성화만 남긴 구조는 입력 스케일에 대해 동차성을 만족한다(Lemma 1). 즉, 입력을 α배 하면 출력도 α배가 되며, 이는 자연 이미지가 밝기 변동에 강인함을 반영한다. 이러한 스케일 불변성은 기존 편향이 있는 네트워크가 입력 스케일에 따라 ReLU 활성화 패턴이 바뀌어 비선형성이 과도하게 증가하는 문제를 방지한다.

편향이 없는 구조 덕분에 BF‑CNN은 각 입력 y에 대해 고정된 ReLU 활성화 패턴을 갖고, 따라서 네트워크 전체는 선형 변환 A_y와 상수 항 b_y=0의 합으로 표현된다. 여기서 A_y는 입력에 대한 Jacobian이며, 실제로는 저차원 신호 서브스페이스에 대한 투영 연산으로 해석된다. 논문은 10개의 자연 이미지에 대해 σ=50일 때 Jacobian의 특잇값 분포를 SVD로 분석했으며, 대부분의 특잇값이 0에 가까워 신호가 저차원 공간에 압축됨을 확인했다. 비제로 특잇값들의 합은 σ의 역비례적으로 감소했으며, 이는 잡음이 클수록 네트워크가 더 넓은 영역을 평균화해 잡음을 억제한다는 의미이다. 또한, 각 픽셀에 대한 가중치 행(row)인 A_y의 행벡터는 이미지 구조에 따라 적응적으로 형태가 변한다. 저잡음에서는 작은 국소 영역을, 고잡음에서는 경계선을 넘어서는 넓은 영역을 가중치로 사용해 평균화한다. 이러한 특성은 전통적인 비선형 필터(예: 양방향 필터, 가우시안 필터)와 유사하지만, BF‑CNN은 데이터‑드리븐 방식으로 이러한 필터를 자동 학습한다는 점에서 차별화된다.

실험에서는 DnCNN(20층), Recurrent CNN(5층 × 4회 반복), UNet(9층), Simplified DenseNet 등 네 가지 아키텍처를 동일한 학습 설정으로 학습시킨 뒤, 각각을 bias‑free 버전과 비교하였다. 결과는 모든 아키텍처에서 BF‑CNN이 학습 잡음 범위 내에서는 기존 모델과 동등하거나 약간 우수한 PSNR을 보이며, 학습 범위를 초과하는 σ에 대해서는 성능 저하가 거의 없음을 보여준다. 특히, 학습 범위가 좁을수록(σ∈

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기