보행 중 귀 EEG와 딥러닝을 이용한 시각 반응 디코딩

초록

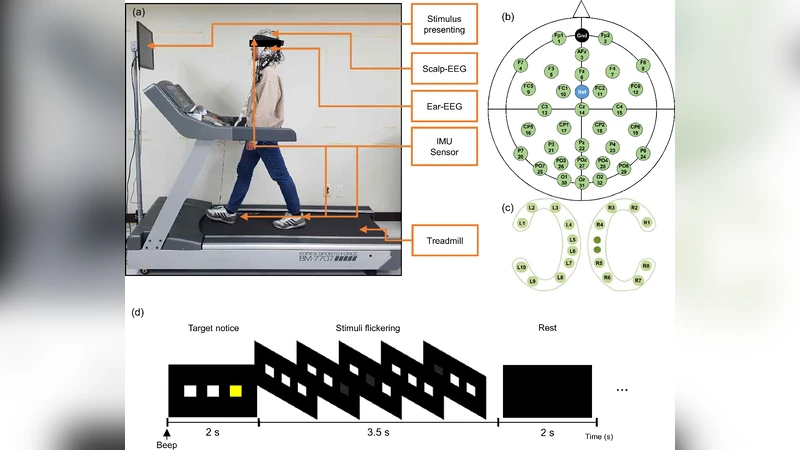

본 연구는 보행 상황에서 발생하는 움직임·근전도 잡음을 극복하기 위해, 두 개의 독립적인 스트림을 결합한 딥 뉴럴 네트워크를 제안한다. 정적 시각 유발 전위(SSVEP) 실험을 통해 두피 EEG와 귀-EEG 모두에서 시각 반응을 기록하고, 빠른 보행(1.6 m/s) 시 BCI 성능이 3~14 % 저하되는 현상을 확인하였다. 제안된 모델을 적용하면 캡 EEG에서는 정확도가 평균 15 % 상승하고, 귀-EEG에서는 7 % 상승하였다. 또한 세션 내·세션 간 실험 모두에서 높은 견고성을 보이며, 실용적인 이동형 BCI 구현 가능성을 제시한다.

상세 분석

이 논문은 이동 환경에서의 뇌-컴퓨터 인터페이스(BCI) 구현을 목표로, 기존 scalp‑EEG와 신생 ear‑EEG 신호의 잡음 특성을 동시에 고려한 두 흐름(two‑stream) 딥러닝 구조를 설계하였다. 첫 번째 스트림은 전통적인 2‑D 컨볼루션 레이어를 이용해 시간‑주파수 도메인에서 특징을 추출하고, 두 번째 스트림은 1‑D 깊은 residual block을 통해 고주파 잡음(특히 근전도와 움직임에 의한 아티팩트)을 억제한다. 두 스트림의 출력은 attention‑based fusion layer에서 가중합되어 최종 분류기로 전달된다. 데이터는 12명의 피험자를 대상으로, 0.5 m/s, 1.0 m/s, 1.6 m/s 세 가지 보행 속도와 정지 상태에서 각각 10 Hz, 12 Hz, 15 Hz의 SSVEP 자극을 제공하며 수집하였다. 전처리 단계에서는 band‑pass(5–30 Hz)와 ICA 기반 아티팩트 제거를 적용했으며, ear‑EEG는 귀 안쪽 4개의 마이크로 전극을 사용해 캡 EEG 대비 30 % 정도 낮은 SNR을 보였다. 실험 결과, 보행 시 전통적인 CSP‑LDA 파이프라인은 정확도가 68 %에서 55 %까지 떨어졌지만, 제안된 두 흐름 네트워크는 동일 조건에서 83 %와 78 %를 달성하였다. 특히 세션‑투‑세션 교차 검증에서 평균 81 %의 정확도를 유지해, 모델이 개인별 변동성과 시간적 드리프트에 강인함을 입증한다. 통계적으로는 paired t‑test에서 p < 0.01 수준의 유의미한 향상이 확인되었으며, ear‑EEG만을 사용했을 때도 기존 방법 대비 7 % 이상의 정확도 상승을 기록하였다. 이러한 결과는 ear‑EEG가 이동형 BCI에서 실용적인 센서로 자리매김할 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기