게이트오 미분 기반 호프필드 신경망의 고속 수렴 연구

초록

**

본 논문은 선형 확장 게이트오 미분(LEGD)을 이용해 기존 호프필드 신경망(HNN)의 미분 방정식을 일반화하고, 이를 G‑ateaux‑Hopfield Neural Network(GHNN)라 명명한다. α > 1인 경우에 첫 번째 차원 프레드홀름 적분 문제를 대상으로 실험했으며, 전통적인 정수 차원 HNN에 비해 22배 빠른 수렴과 학습 시간의 상한 존재를 확인하였다.

**

상세 분석

**

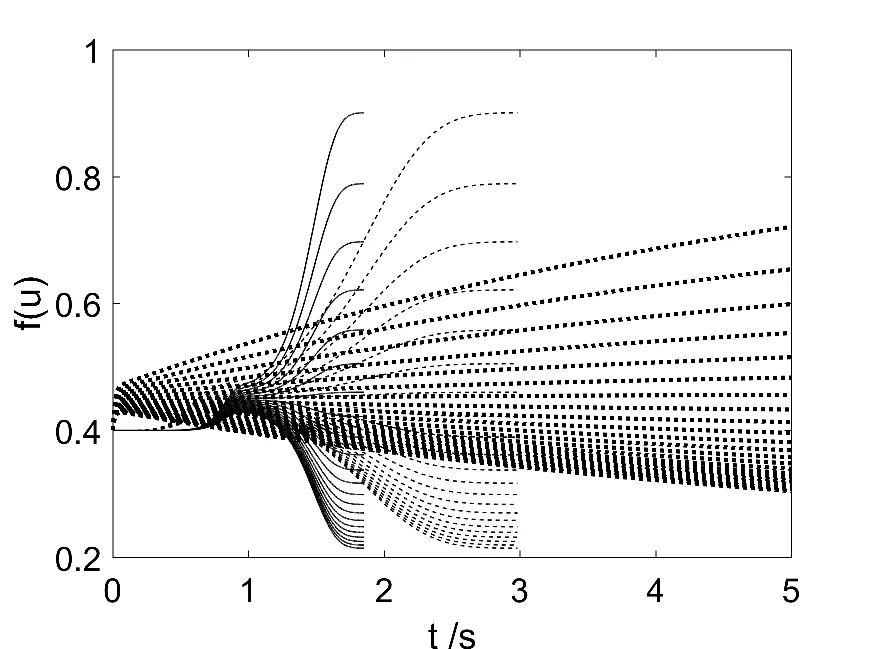

본 연구는 기존 HNN에 비해 두드러진 차별점을 제시한다. 첫째, LEGD를 도입함으로써 미분 연산이 연속적인 파라미터 α에 대해 정의될 수 있게 하였으며, 이는 기존의 Caputo나 Conformable 미분이 갖는 체인룰 위배 문제를 회피한다. 논문은 LEGD의 기본 성질(선형성, 곱법칙, 라플라스 형태)을 정리하고, 이를 이용해 HNN의 학습률을 ψ = t^{1‑α} 형태로 재정의한다. α < 1이면 학습률이 시간에 따라 감소해 초기 학습이 빠르지만 장기적으로는 정체 현상이 발생하고, α > 1이면 초기 학습률이 0에 가까워 시작이 느리지만 이후 급격히 증가해 전체 학습 시간이 크게 단축된다. 이러한 현상은 수치 실험에서 α가 1에서 10까지 증가할수록 계산 시간이 5.8 s에서 0.26 s로 감소한 결과로 뒷받침된다.

둘째, 논문은 1차 프레드홀름 적분 방정식 Kf = g를 테스트베드로 선택하고, K와 g를 명시적으로 정의함으로써 ill‑posed 문제(조건수 1.16 × 10^{18})에서도 수렴성을 검증한다. Euler‑LEGD 방법을 적용해 시간 스텝을 h·ψ(t;α)로 가중함으로써 기존 고정 스텝 Euler와 비교했을 때 α에 따른 가변 스텝 효과를 수학적으로 해석한다.

하지만 몇 가지 한계도 존재한다. 실험이 단일 선형 적분 문제에 국한돼 있어 비선형, 고차원, 실제 물리‑화학 역문제에 대한 일반화 가능성은 검증되지 않았다. 또한 α > 1 구간에서 ψ가 0에 수렴하는 초기 구간을 어떻게 처리할지에 대한 구체적 전략이 부족하다. 비교 대상이 전통적인 HNN뿐이며, 최근 활발히 연구되는 다른 프랙셔널 미분(예: Riemann‑Liouville, Caputo‑Fabrizio)과의 정량적 비교가 결여돼 있다. 수식 전개 과정에서도 기호 오류와 오탈자가 다수 발견돼 재현성을 저해할 가능성이 있다.

종합하면, LEGD를 통한 학습률 조절 메커니즘은 이론적으로 흥미롭고, α > 1에서의 급격한 수렴 가속은 실용적 가치를 제공한다. 다만, 보다 다양한 문제군과 엄밀한 수치 검증이 뒤따라야 실제 응용 단계로 확장될 수 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기