공급망 최적화를 위한 개미군집 알고리즘 가속화

초록

본 논문은 실제 물류 출고 문제에 개미군집 최적화(ACO)를 적용하고, 독립 개미 군집(IAC)과 병렬 개미(PA) 두 가지 병렬 구조의 확장성을 비교한다. 16코어 CPU, 68코어 Xeon Phi, 최대 4대의 Geforce GPU에서 구현된 AVX2·AVX‑512·CUDA 기반 벡터화 기법을 평가한 결과, 메타데이터 접근이 많은 공급망 문제에서는 GPU보다 CPU와 Xeon Phi가 월등히 효율적이었다. 특히 PA 구조에 벡터화를 결합한 PAwV는 1024개 인스턴스까지 148배 가속을 달성하였다.

상세 분석

이 연구는 기존에 TSP와 같은 전형적인 조합 최적화 문제에 국한되었던 ACO의 병렬화 연구를 실제 물류 네트워크라는 복합적인 도메인으로 확장한다는 점에서 의미가 크다. 공급망 출고 문제는 각 주문에 대한 물품 배치, 운송 경로, 창고 용량 등 다차원 메타데이터를 동시에 고려해야 하므로, 페이로드가 큰 데이터 구조에 대한 빈번한 읽·쓰기 연산이 발생한다. 이러한 특성은 GPU의 대규모 스레드 병렬 처리에 비해 메모리 대역폭과 캐시 일관성 문제가 크게 부각된다.

논문은 두 가지 병렬 아키텍처를 설계하였다. 첫 번째인 Independent Ant Colonies(IAC)는 각 코어 혹은 디바이스가 독립적인 개미 군집을 유지하며, 주기적으로 최적 해를 공유한다. 이는 통신 오버헤드가 낮지만, 각 인스턴스가 동일한 탐색 공간을 중복 탐색하게 되어 효율성이 제한된다. 두 번째인 Parallel Ants(PA)는 하나의 전역 페로몬 맵을 공유하고, 개미들이 동시에 경로를 구축한다. 이 방식은 페로몬 업데이트 시 원자적 연산과 잠금 메커니즘이 필요하지만, 탐색 다양성이 높아 빠른 수렴을 보인다.

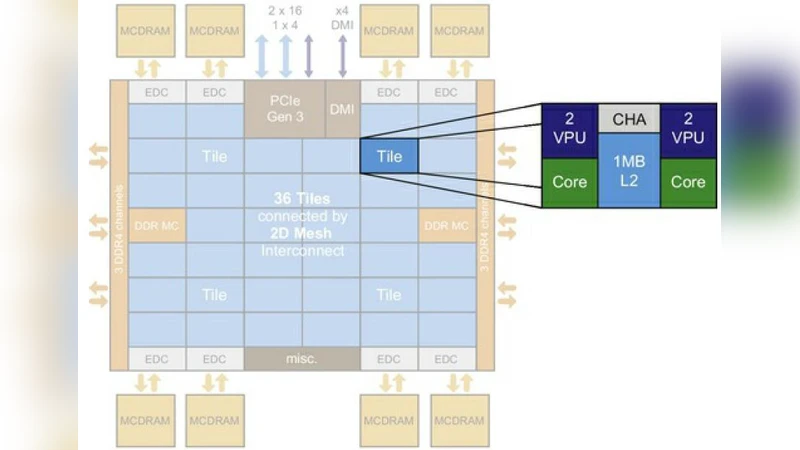

하드웨어 측면에서는 세 가지 플랫폼을 대상으로 구현하였다. 16코어 x86 CPU에서는 AVX2 명령어 집합을 활용해 SS‑Roulette(스칼라 선택) 연산을 SIMD 형태로 변환했으며, 68코어 Xeon Phi에서는 AVX‑512 기반 벡터화를 적용해 메모리 접근 패턴을 최적화하였다. GPU 구현은 CUDA와 SS‑Roulette를 이용해 스레드 블록당 하나의 개미를 할당했지만, 메타데이터 구조가 복잡해 전역 메모리 접근이 빈번해 성능이 저하되었다.

실험 결과는 두드러진 차이를 보였다. PA 구조는 인스턴스 수가 증가할수록 동일한 품질의 해를 더 적은 반복 횟수로 도달했으며, 특히 PAwV(Parallel Ants with Vectorization)는 1024 인스턴스에서 148배 가속을 기록했다. 반면 IAC는 25배 수준에 머물렀으며, GPU는 4대 사용 시에도 CPU 대비 1.8배 미만의 속도 향상에 그쳤다. 이는 공급망 문제에서 요구되는 복잡한 메타데이터 접근이 GPU의 메모리 계층 구조와 맞지 않음을 시사한다.

결론적으로, 복잡한 데이터 의존성을 갖는 실시간 물류 최적화에서는 고성능 CPU와 Xeon Phi와 같은 벡터화 친화형 아키텍처가 가장 효율적이며, PA와 같은 공유 페로몬 기반 병렬 모델이 수렴 속도와 해의 품질 모두에서 우수함을 확인하였다. 향후 연구는 페로몬 업데이트의 비동기화 전략과 메모리 압축 기법을 도입해 더욱 높은 확장성을 모색할 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기