관계 기반 텍스트 임베딩 RETRO

초록

RETRO는 데이터베이스 스키마의 관계 정보를 활용해 기존 워드 임베딩을 보정함으로써, 데이터베이스 내 텍스트 값에 대한 고품질 벡터 표현을 자동으로 생성한다. 이를 통해 분류·회귀·결측값 보정·링크 예측 등 다양한 인‑데이터베이스 머신러닝 작업에서 기존 방법보다 우수한 성능을 보인다.

상세 분석

본 논문은 전통적인 워드 임베딩이 텍스트 자체의 의미는 포착하지만, 데이터베이스 내에서의 열·테이블 간 관계를 반영하지 못한다는 한계를 지적한다. 이를 해결하기 위해 저자들은 ‘관계 레트로피팅(Relational Retrofitting)’이라는 새로운 프레임워크를 제안한다. 핵심 아이디어는 두 단계로 구성된다. 첫 번째 단계에서는 데이터베이스의 모든 텍스트 값을 추출하고, 각 값이 속한 열을 ‘카테고리’로 정의한다. 또한 기본 키‑외래 키, 다대다 연결, 동일 행 내 열 간 연결 등 스키마에서 파생될 수 있는 다양한 관계를 ‘관계 그룹’으로 구분한다. 두 번째 단계에서는 사전 학습된 워드 임베딩 W₀을 초기값으로 삼아, 앞서 구축한 관계 그래프를 이용해 목적함수 Ψ(W) 를 최소화한다. 이 목적함수는 (1) 원본 임베딩과의 차이를 최소화하는 복원 항, (2) 같은 관계 그룹에 속한 노드 간 거리를 최소화하는 관계 항, (3) 정규화 항으로 구성된다. 저자들은 이 함수가 볼록(convex)함을 증명함으로써, 초기값에 관계없이 전역 최적해에 수렴함을 보장한다.

알고리즘 구현 측면에서는 행렬 연산 기반의 효율적인 업데이트 규칙을 도출하고, 관계 그룹이 대칭인 경우와 비대칭인 경우를 각각 최적화한다. 또한, OOV(Out‑of‑Vocabulary) 문제를 해결하기 위해 ‘최장 접두사 트라이’를 활용해 다단어 구문을 올바르게 토큰화하고, 해당 구문의 임베딩을 토큰 평균으로 초기화한다. 이렇게 초기화된 ‘null 벡터’도 관계 정보에 의해 의미 있는 벡터로 재구성된다.

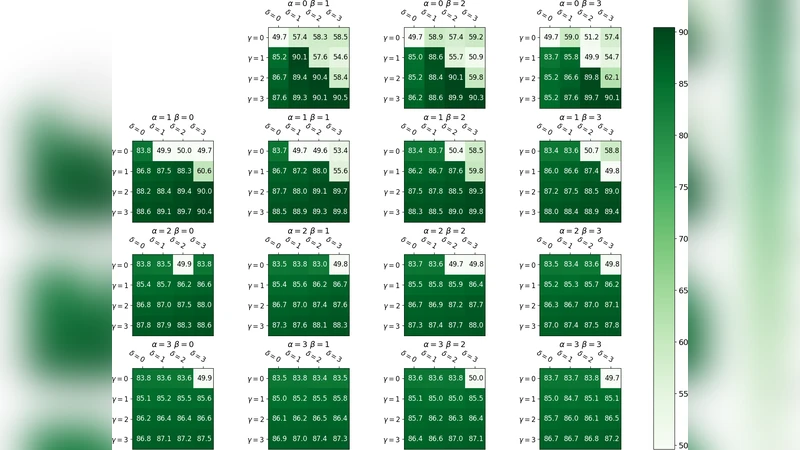

실험에서는 RETRO가 기존 레트로피팅(Faruqui et al., 2015)과 노드 임베딩 기법(DeepWalk) 대비, 텍스트‑중심 작업(분류·회귀)에서는 동일하거나 약간 높은 정확도를, 관계‑중심 작업(결측값 보정·링크 예측)에서는 현저히 높은 F1 점수를 기록한다. 특히, 데이터베이스 스키마가 복잡하고 다대다 관계가 많이 포함된 경우, 관계 정보를 반영한 RETRO 임베딩이 기존 방법보다 10~15% 정도 성능 향상을 보인다.

또한, RETRO는 사전 학습된 임베딩을 재학습 없이 증분 업데이트할 수 있다는 장점을 갖는다. 데이터가 추가·수정될 때마다 관계 그래프만 갱신하고, 기존 최적화 결과를 초기값으로 사용해 빠르게 재수렴한다. 이는 인‑데이터베이스 ML 시스템에서 실시간 혹은 주기적인 모델 재학습 비용을 크게 절감한다는 실용적 의미를 가진다.

종합하면, RETRO는 (1) 워드 임베딩의 풍부한 의미 정보를 유지하면서, (2) 데이터베이스 스키마가 제공하는 구조적 관계를 정량적으로 반영하고, (3) 효율적인 증분 학습 메커니즘을 제공한다는 세 가지 핵심 강점을 통해, 텍스트 기반 데이터베이스 분석에 새로운 표준을 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기