대규모 단어 수준 미국 수화 인식 데이터셋 및 방법 비교

초록

본 논문은 2,000개 이상의 어휘와 100명 이상의 서명자를 포함한 대규모 단어 수준 미국 수화 영상 데이터셋(WLASL)을 공개한다. 데이터셋을 기반으로 영상 외관 기반 모델과 2D 포즈 기반 모델을 비교하고, 공간‑시간 의존성을 동시에 학습하는 Pose‑TGCN을 제안한다. 두 접근법 모두 Top‑10 정확도 62~66%를 달성해 데이터셋의 실용성을 입증한다.

상세 분석

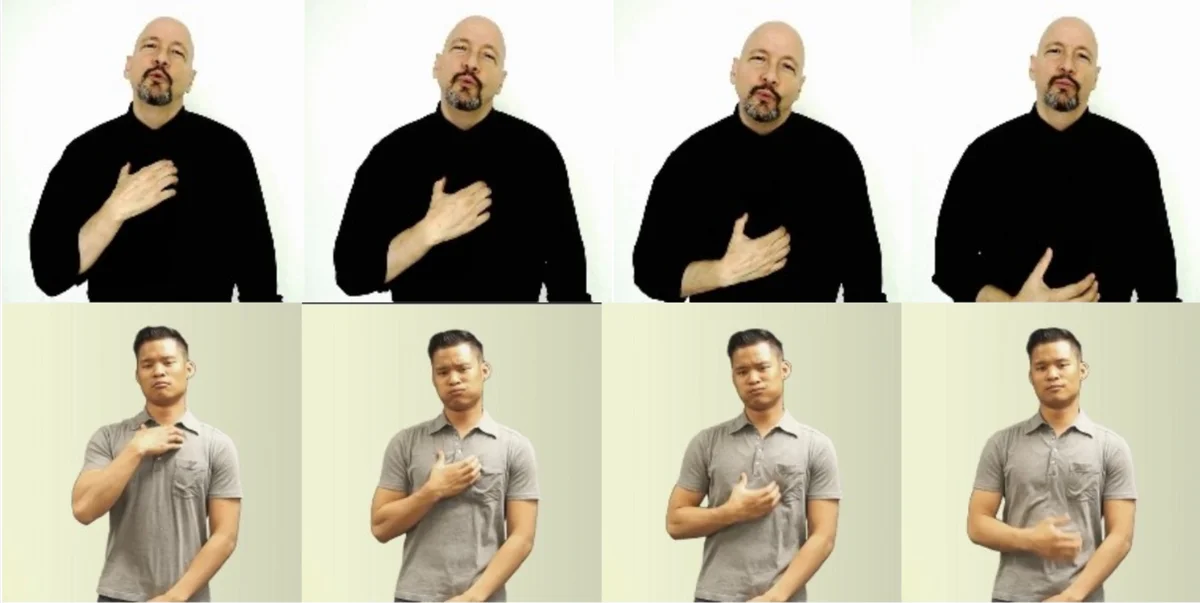

WLASL은 기존 ASL 데이터셋이 수십~수백 단어에 머물렀던 한계를 넘어, 2,000개 이상의 글로스와 21,083개의 비디오(평균 10.5개 샘플/글로스)를 제공한다. 데이터는 교육용 웹사이트와 유튜브 튜토리얼에서 수집했으며, 전면 시점, 다양한 배경·조명, 119명의 서명자를 포함한다. 자동 얼굴 임베딩 기반 서명자 식별, YOLOv3 기반 바운딩 박스 추출, 그리고 방언 라벨링 등 다층 메타데이터를 부여해 학습·평가의 신뢰성을 높였다.

기본 실험으로는 (i) VGG‑GRU와 I3D 같은 이미지 외관 기반 CNN‑RNN 모델, (ii) 포즈 시퀀스를 GRU에 입력하는 단순 시계열 모델을 구현했다. 이때 2D 포즈는 OpenPose 등으로 추출했으며, 포즈만을 사용했음에도 외관 모델과 비슷한 성능을 보였다. 이는 수화가 손·팔·몸통 움직임에 크게 의존함을 시사한다.

Pose‑TGCN은 그래프 구조를 이용해 각 프레임의 관절을 노드, 관절 간 해부학적 연결을 엣지로 정의하고, 시간 축을 따라 그래프 컨볼루션을 수행한다. 공간‑시간 그래프 합성곱은 포즈의 구조적 관계와 동적 변화를 동시에 포착해, 기존 GRU 대비 Top‑10 정확도가 약 2~3% 상승한다.

성능 평가는 Top‑1, Top‑5, Top‑10 정확도로 이루어졌으며, 2,000어휘 셋에서 최고 66%(Top‑10)까지 도달했다. 이는 2,000클래스 다중 분류 문제에서 의미 있는 수준이며, 데이터셋이 실제 적용 가능성을 갖춤을 보여준다. 그러나 평균 샘플 수가 10.5개에 불과해 클래스 불균형과 과소표본 문제를 완전히 해소하지 못했으며, 깊은 3D CNN이나 트랜스포머 기반 모델에 대한 탐색은 부족하다. 또한, 조명·배경 변동이 큰 실제 환경에서의 일반화 검증이 추가로 필요하다.

전반적으로, WLASL은 규모·다양성·메타데이터 측면에서 기존 ASL 데이터셋을 크게 능가하며, 포즈 기반 그래프 모델이 영상 외관 모델과 경쟁할 수 있음을 실증한다. 향후 연구는 더 많은 샘플 확보, 멀티모달 융합, 실시간 추론 최적화 등을 통해 실용적인 수화 인식 시스템 구축으로 이어질 수 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기