연속 학습을 위한 가중치 프로스팅

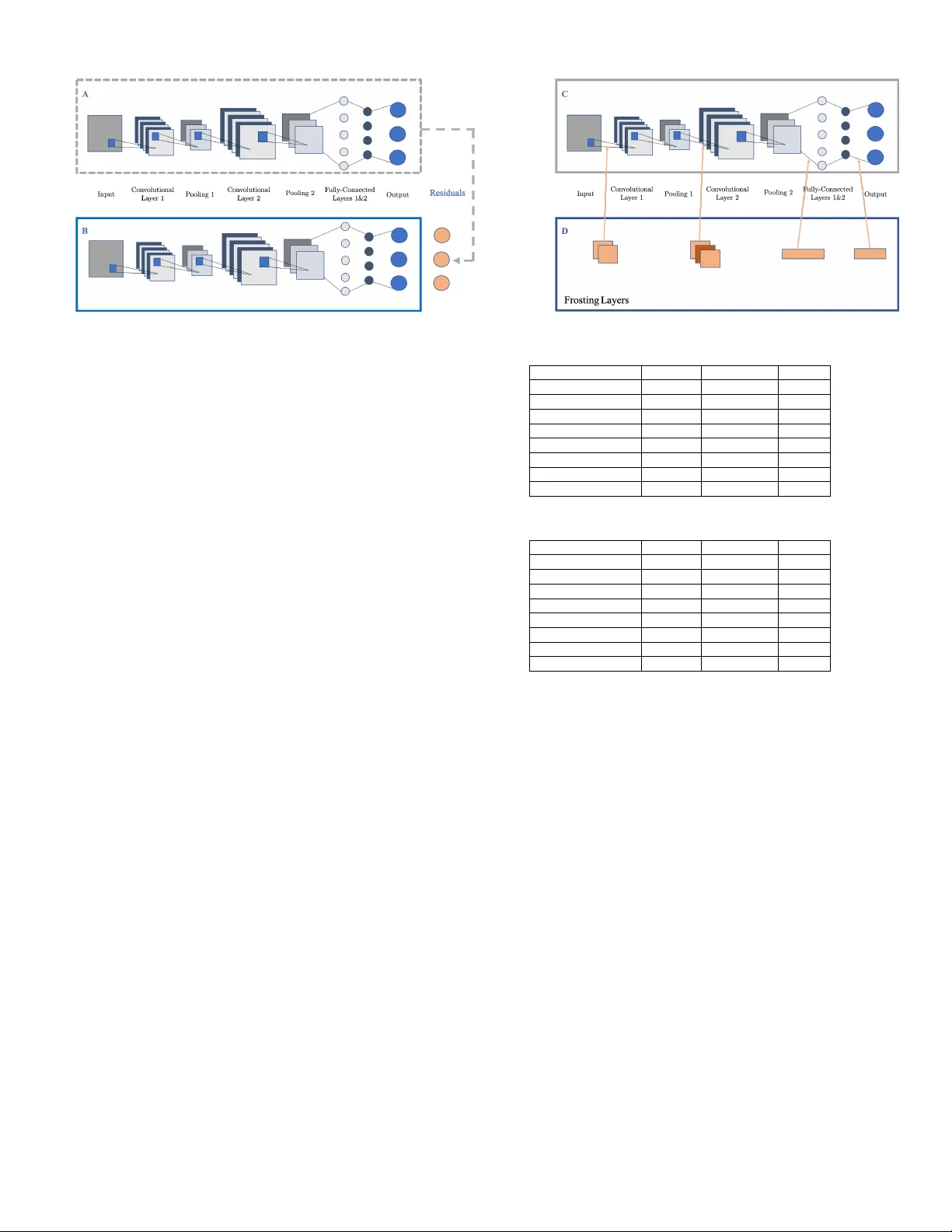

본 논문은 사전 학습된 신경망을 새로운 데이터에 재학습할 때 발생하는 재앙적 망각을 완화하기 위해 두 가지 앙상블 기법을 제안한다. 첫 번째는 기존 모델의 출력 잔차를 학습 목표로 하는 Gradient Boosting 기반 BoostNet이며, 두 번째는 기존 가중치에 “프로스팅” 층을 추가해 메타‑네트워크로 학습한 후 병합하는 FrostNet이다. 두 방법 모두 파라미터 효율성을 고려하면서도 기존 모델의 성능을 유지·향상시킨다. MNIST·C…

저자: Xiaofeng Zhu, Feng Liu, Goce Trajcevski

본 논문은 딥러닝 모델을 지속적으로 업데이트할 때 발생하는 재앙적 망각 문제를 해결하기 위해 두 가지 일반화 가능한 앙상블 방법을 제안한다. 첫 번째 방법은 기존 모델의 출력 잔차를 학습 목표로 삼는 Gradient Boosting 기반 BoostNet이다. 사전 학습된 모델에 새로운 데이터와 일부 오래된 데이터를 섞어 만든 재학습 데이터셋을 입력하고, 각 샘플에 대해 소프트맥스 교차 엔트로피 손실의 미분값인 잔차 ∂L/∂oᵢ = yᵢ − pᵢ을 계산한다. 이 잔차는 기존 모델이 새 데이터에 대해 얼마나 부족한지를 나타내며, 기존 모델의 파라미터는 그대로 고정한다. BoostNet은 잔차를 회귀 라벨로 사용해 평균 제곱 오차(MSE) 손실을 최소화하는 비교적 단순한 네트워크를 학습한다. 학습이 끝난 후 기존 모델의 출력과 BoostNet의 출력을 단순히 합산하여 최종 예측을 만든다. 이 방식은 기존 모델을 변경하지 않으면서도 새로운 데이터에 대한 오류를 보정한다. 다만, 매 재학습 단계마다 추가 파라미터가 누적되는 단점이 있다.

두 번째 방법은 메타‑러닝 기반 FrostNet이다. 여기서는 기존 가중치를 “뉴런”으로 보고, 동일한 형태의 가중치 텐서를 별도의 “프로스팅” 층으로 추가한다. 재학습 과정에서 기본 네트워크와 프로스팅 층 모두를 동시에 최적화한다. 활성화 함수로는 tanh와 ReLU를 실험했으며, tanh가 약간 더 좋은 성능을 보였지만, 활성화 없이도 충분히 향상이 나타났다. 학습이 종료되면 프로스팅 층의 파라미터와 기존 가중치를 원소별 곱으로 병합하고, 프로스팅 층은 폐기한다. 이렇게 하면 최종 모델의 파라미터 수는 원래와 동일하게 유지되며, 추론 단계에서 추가 연산 비용이 발생하지 않는다.

실험은 두 가지 주요 시나리오로 구성되었다. 첫 번째는 MNIST와 CIFAR‑10 데이터셋을 사용해 원본 이미지와 회전·이동·줌 등 다양한 변형을 적용한 데이터 변동 실험이다. 원본 데이터와 변형 데이터를 각각 절반씩 섞어 재학습 데이터셋을 만들고, 동일한 크기의 검증·테스트 셋을 유지하였다. 두 번째는 클래스를 0‑4와 5‑9로 나누어 순차적으로 학습하는 클래스 분할 실험이다. 초기 학습에서는 0‑4 클래스만 사용하고, 재학습 단계에서 5‑9 클래스를 포함한 데이터를 섞어 학습한다. 비교 대상은 (1) 기본 사전 학습 모델, (2) 새 모델을 처음부터 학습하는 train‑from‑scratch, (3) 파인튜닝, (4) 대표적인 연속 학습 정규화 기법인 EWC, MAS, Selfless이다.

실험 결과, BoostNet과 FrostNet 모두 변형된 테스트 셋에서 기존 정규화 기법보다 높은 정확도를 기록했다. 특히 FrostNet은 파라미터 수를 늘리지 않으면서도 원본 데이터와 변형 데이터 모두에서 가장 높은 정확도를 달성했다. 클래스 분할 실험에서도 BoostNet과 FrostNet은 오래된 클래스(0‑4)와 새로운 클래스(5‑9) 모두에서 균형 잡힌 성능을 보여, 기존 방법들이 새로운 클래스 학습에 취약한 점을 보완했다. 정규화 기반 방법들은 오래된 지식 보존에는 강하지만 새로운 지식 습득에서는 성능이 떨어지는 반면, 제안된 앙상블 방법은 성능 격차를 직접 최소화함으로써 두 목표를 동시에 달성한다.

논문의 주요 기여는 다음과 같다. 첫째, 기존 모델의 성능 격차를 직접 학습 목표로 삼는 Gradient Boosting 기반 BoostNet을 제안함으로써, 모델 파라미터를 변경하지 않고도 새로운 데이터에 대한 오류를 보정한다. 둘째, 메타‑네트워크 형태의 프로스팅 층을 도입해 가중치를 동적으로 보정하고, 학습 후 병합함으로써 파라미터 수를 유지하는 FrostNet을 제시한다. 셋째, 두 방법 모두 다양한 데이터 변형과 클래스 분할 상황에서 기존 정규화 및 메모리 통합 기법보다 우수한 성능을 입증하였다.

향후 연구 방향으로는 (1) 시간적 특성을 고려한 동적 데이터 선택 전략, (2) 대규모 사전 학습 모델에서 특정 도메인에 맞는 시냅스 경로를 선택하는 방법, (3) 네트워크 압축 기법과 결합해 메모리 효율성을 더욱 향상시키는 하이브리드 접근법 등이 제시된다. 이러한 확장은 제안된 프레임워크를 실제 연속 학습 시스템에 적용할 때 발생할 수 있는 계산·메모리 제약을 완화하고, 다양한 응용 분야에서 지속 가능한 모델 업데이트를 가능하게 할 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기