멀티모달 주제와 오디오 특징을 활용한 시각·청각 대화 시스템

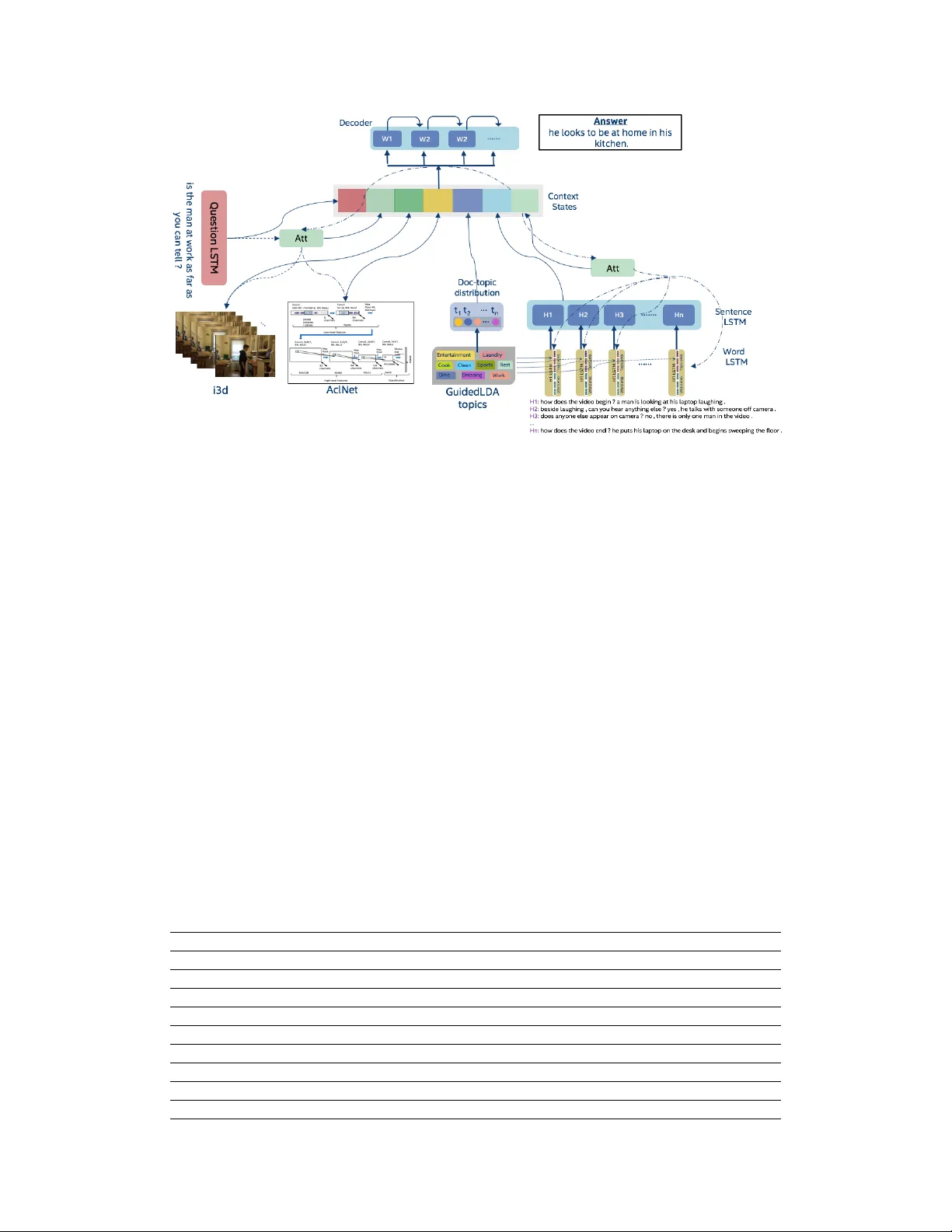

본 논문은 Audio‑Visual Scene‑Aware Dialog(AVSD) 과제에 대해 세 가지 핵심 확장을 제안한다. 첫째, 대화의 ‘주제’를 LDA·Guided‑LDA로 추출해 토픽 벡터를 질문·대화 이력에 통합한다. 둘째, 디코더가 대화 이력과 영상·오디오 특징에 선택적으로 집중할 수 있도록 다양한 멀티모달 어텐션 구조를 실험한다. 셋째, 원시 오디오 신호를 직접 입력받아 환경 소리를 분류하는 AclNet을 도입해 오디오 정보를 강화한…

저자: Shachi H Kumar, Eda Okur, Saurav Sahay

본 논문은 Audio‑Visual Scene‑Aware Dialog(AVSD) 과제에 대해 세 가지 주요 아키텍처 확장을 제안하고, 이를 실제 데이터셋에 적용해 성능을 검증한다. 첫 번째 확장은 대화의 ‘주제’를 정량화하는 것으로, Charades 영상 데이터에서 추출한 명사·동사·장소 등을 시드워드로 사용해 Guided‑LDA를 9개의 도메인 토픽(엔터테인먼트, 요리, 청소 등)으로 학습한다. 이렇게 얻은 토픽 분포는 질문, 답변, QA 쌍, 캡션, 대화 이력 각각에 대해 토픽 벡터로 변환되어 모델에 입력된다. 토픽 벡터는 직접 디코더 상태에 더하거나, 히스토리 LSTM(HLSTM)에 피처로 제공되어 대화의 전후 맥락을 강화한다. 실험에서는 토픽 임베딩에 사전학습된 GloVe(200‑dim) 임베딩을 결합한 변형이 BLEU‑4, METEOR, CIDEr 등 대부분의 지표에서 베이스라인을 앞섰으며, 특히 비이진(복합) 답변을 요구하는 샘플에서 큰 성능 향상을 보였다. 이는 토픽 정보가 대화의 전반적 흐름과 목표를 명시적으로 제공함으로써, 모델이 보다 구체적이고 일관된 응답을 생성하도록 돕는다는 점을 시사한다.

두 번째 확장은 멀티모달 어텐션 메커니즘이다. 기존 베이스라인은 대화 이력의 마지막 히든 스테이트만을 사용했지만, 저자들은 네 가지 어텐션 변형을 실험했다. (1) Word‑LSTM 전체 출력에 직접 어텐션을 적용했을 때는 과도한 정보량으로 성능이 저하되었다. (2) Word‑LSTM 마지막 히든 스테이트만을 이용한 어텐션은 코어퍼런스가 포함된 질문에 대해 베이스라인보다 약간 개선되었다. (3) Sentence‑LSTM 전체 출력에 어텐션을 적용한 경우, 대화 이력의 모든 턴을 압축된 문장 표현으로 활용해 디코더가 필요한 시점에 적절히 참조하도록 하였으며, 이는 코어퍼런스 서브셋과 이진 답변 평가 모두에서 가장 높은 BLEU·METEOR·ROUGE‑L 점수를 얻었다. (4) 여기에 영상·오디오 멀티모달 피처를 추가한 어텐션은 기대와 달리 전체 성능을 크게 끌어올리지는 못했는데, 이는 어텐션이 과도하게 분산되거나, 영상·오디오 피처와 텍스트 피처 간 정렬이 충분히 학습되지 않았기 때문으로 해석된다. 따라서 현재 단계에서는 텍스트 기반 어텐션이 가장 효율적이며, 멀티모달 피처를 효과적으로 결합하려면 보다 정교한 정렬 메커니즘이 필요하다.

세 번째 확장은 오디오 특성 강화이다. 기존 베이스라인은 VGGish(프리트레인된 스펙트로그램 기반)만을 사용했지만, 저자들은 원시 파형을 직접 입력받아 50가지 환경 소리를 분류하도록 학습된 AclNet을 도입했다. AclNet은 44.1 kHz 원시 오디오를 그대로 처리함으로써 전처리 비용을 낮추고, ESC‑50 데이터셋에서 얻은 풍부한 환경 소리 지식을 AVSD 대화에 전이한다. 실험 결과, 전체 데이터셋에서 AclNet 기반 피처가 BLEU‑4와 CIDEr에서 각각 0.001~0.015 포인트 상승을 보였으며, 특히 오디오 관련 질문(예: “팬이 흔들리고 있나요?”)에 대해서는 정확도가 크게 향상돼 인간이 기대하는 답변과 더 근접한 결과를 생성했다. 이는 원시 오디오를 직접 학습한 모델이 스펙트로그램 기반 모델보다 세밀한 시간‑주파수 패턴을 포착해 대화 생성에 유용한 정보를 제공한다는 점을 입증한다.

실험 설정은 DSTC7 AVSD 데이터셋(훈련 7,659 대화, 검증 1,787, 테스트 1,710)을 사용했으며, 평가 지표는 BLEU‑1~4, METEOR, ROUGE‑L, CIDEr이다. 토픽 모델링 실험에서는 Guided‑LDA(All topics)+GloVe가 전체 지표에서 가장 높은 점수를 기록했고, HLSTM에 토픽을 삽입한 변형도 소폭 개선을 보였다. 어텐션 실험에서는 ‘Sentence LSTM 전체 출력에 대한 어텐션’이 가장 효과적이었으며, 멀티모달 피처를 포함한 어텐션은 오히려 성능 저하를 일으켰다. 오디오 실험에서는 B+AclNet이 B와 B+VGGish보다 전체 및 오디오‑특정 서브셋 모두에서 우수한 성능을 보였고, 정성적 분석에서도 AclNet을 사용한 모델이 더 정확한 답변을 생성함을 확인했다.

결론적으로, 이 논문은 (1) 대화 주제라는 고수준 의미 정보를 토픽 모델링으로 정량화, (2) 어텐션을 통한 텍스트 이력 활용, (3) 원시 오디오를 직접 학습하는 AclNet 도입이라는 세 축을 통해 멀티모달 대화 시스템의 성능을 단계적으로 끌어올렸다. 각 축이 독립적으로도 베이스라인 대비 개선을 보이며, 특히 토픽 임베딩과 Sentence‑LSTM 어텐션의 결합이 가장 큰 시너지 효과를 나타낸다. 향후 연구에서는 토픽과 어텐션을 공동 학습하는 end‑to‑end 구조, 영상·오디오 피처와 텍스트 피처 간 정교한 정렬 메커니즘, 대규모 실시간 대화 데이터에 대한 지속적 미세조정 등을 통해 실제 가정용 IVA에 적용 가능한 완전 멀티모달 대화 에이전트를 구현하는 방향이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기