머신러닝 테스트의 현재와 미래: 종합 설문조사

초록

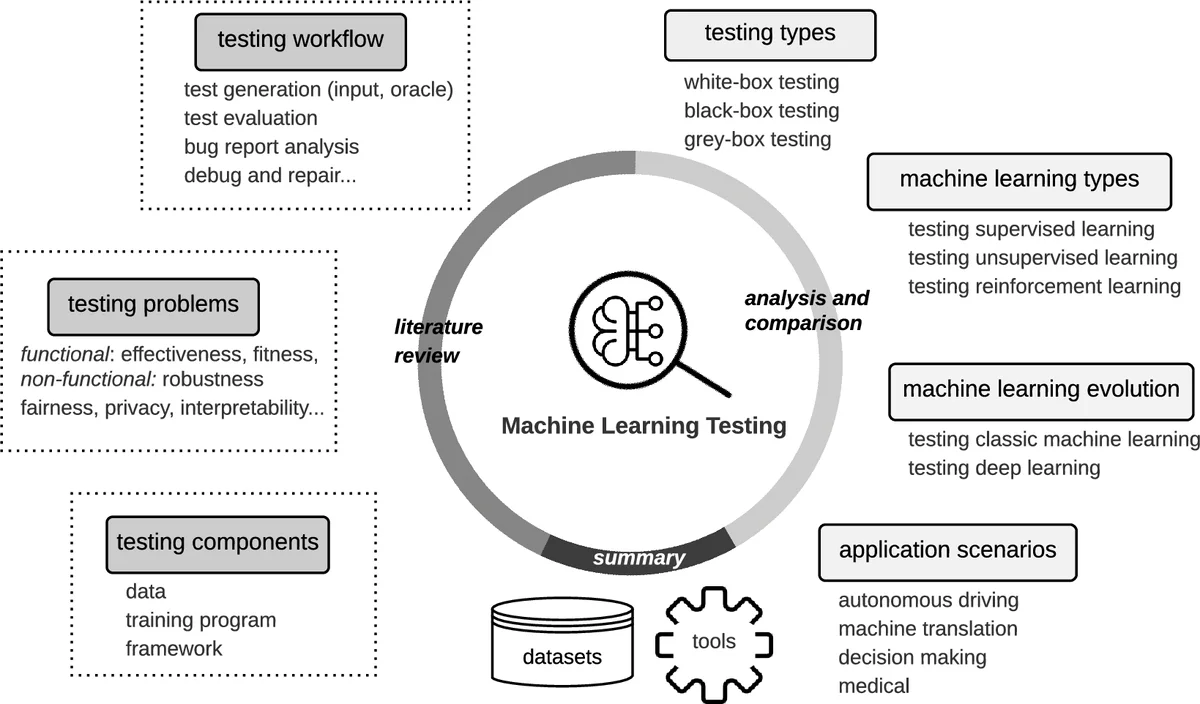

본 설문은 2007‑2019년 사이 발표된 144편의 논문을 분석해 머신러닝 테스트(ML 테스트)의 연구 흐름을 정리한다. 테스트 대상(정확도·견고성·공정성 등), 테스트 구성요소(데이터·학습 프로그램·프레임워크), 테스트 워크플로(입력 생성·오라클 구축·적합도 평가) 및 적용 분야(자율주행·기계번역 등)를 체계화하고, 데이터·연구 트렌드와 현재의 불균형(주로 지도학습·정확도·견고성에 집중) 등을 제시한다. 마지막으로 오라클 문제, 통합 테스트 난이도, 지속적 학습 등 주요 과제와 데이터·도구 표준화, 비지도·강화학습 테스트, 해석 가능성·프라이버시·효율성 테스트 확대 등 향후 연구 방향을 제시한다.

상세 분석

이 설문은 머신러닝 시스템을 전통적인 소프트웨어와 구별되는 특성—데이터‑주도 프로그래밍, 모델의 지속적 진화, 통계적 불확실성—에 초점을 맞추어 테스트 방법론을 재구성한다. 먼저 ‘ML 버그’를 기존 소프트웨어 버그와 동일시하면서도, 요구조건(정확도, 견고성, 공정성, 프라이버시 등)과 버그가 발생할 수 있는 위치(학습 데이터, 학습 프로그램, 프레임워크)로 구분한다. 이러한 구분은 테스트 워크플로를 ‘입력 생성’, ‘오라클 식별’, ‘적합도 평가’, ‘버그 트라이에지’ 네 단계로 체계화하는 기반이 된다.

논문은 144편을 네 축(테스트 속성, 구성요소, 워크플로, 적용 시나리오)으로 매핑했으며, 특히 정확도·견고성 테스트가 93편으로 압도적인 비중을 차지한다는 점을 강조한다. 반면, 해석 가능성·프라이버시·효율성 등 비기능적 속성은 각각 5~10편 수준에 머물러 있어 연구 편향이 명확히 드러난다. 또한 지도학습이 120편을 차지하고, 비지도·강화학습은 각각 3편, 1편에 불과해 학습 유형별 테스트 연구가 크게 불균형임을 지적한다.

데이터 측면에서는 이미지·음성·텍스트 등 도메인별 공개 데이터셋 활용이 일반적이며, 도구는 DeepXplore, Themis, TensorFuzz 등 테스트 입력 생성·오라클 자동화에 초점을 맞춘 프레임워크가 주류를 이룬다. 그러나 현재 도구들은 주로 백박스·화이트박스 기법에 국한돼 있어, 모델 내부의 복잡한 의사결정 과정을 포괄적으로 검증하기엔 한계가 있다.

핵심 과제로는 (1) ‘오라클 문제’ 해결을 위한 메타‑테스트, 메타‑러닝 기반 오라클 생성 기법의 필요성, (2) 오류 전파와 결함 은폐 현상을 추적하기 위한 통합·시스템 레벨 테스트 방법론, (3) 지속적 학습 환경에서 테스트 적합도와 회귀 검증을 자동화하는 파이프라인 구축이 있다. 특히, 모델이 새로운 데이터에 적응하면서 발생하는 ‘드리프트’ 현상을 실시간으로 감지하고 테스트 케이스를 자동으로 업데이트하는 메커니즘이 요구된다.

미래 연구 방향으로는 (①) 비지도·강화학습 전용 테스트 기준 및 벤치마크 설계, (②) 공정성·프라이버시·해석 가능성 등 사회적·법적 요구를 반영한 다목적 테스트 프레임워크, (③) 테스트 케이스 우선순위 지정·축소를 위한 메타‑학습 및 강화학습 기반 최적화, (④) 다양한 프레임워크와 하드웨어 환경을 포괄하는 표준화된 테스트 인터페이스와 오픈소스 툴체인 구축이 제시된다. 이러한 연구는 머신러닝 시스템의 신뢰성을 체계적으로 향상시키고, 실제 산업 현장에서의 안전·규제 요구를 충족시키는 데 핵심적인 역할을 할 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기