머신러닝 논문 라벨링 과정 투명성 점검

초록

본 연구는 소셜 컴퓨팅 분야에서 트위터 데이터를 이용한 감독학습 논문들을 대상으로, 인간이 라벨링한 학습 데이터의 출처와 라벨링 절차가 논문에 어떻게 보고되는지를 체계적으로 조사한다. 라벨러의 정체, 자격, 독립 라벨링 여부, 상호 평가 지표, 보상 정보, 데이터 공개 여부 등을 코딩하고, 보고 수준의 다양성과 투명성 결여를 밝혀낸다.

상세 분석

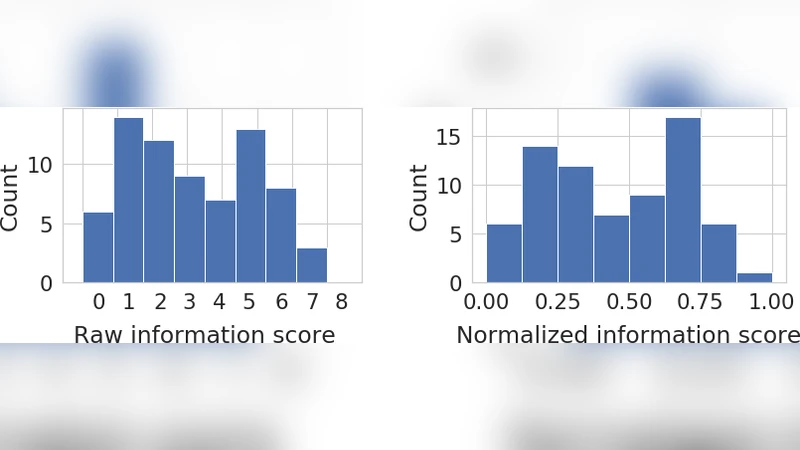

이 논문은 메타‑리서치의 한 형태로, 기존 사회과학·인문학에서 오랫동안 사용되어 온 구조화된 콘텐츠 분석 방법을 머신러닝 응용 논문의 메타데이터 검증에 적용하였다. 연구팀은 먼저 “트위터 기반 분류 작업”이라는 제한된 도메인을 선정하고, ArXiv와 Scopus에 게재된 논문을 샘플링하였다. 각 논문에 대해 12개의 코딩 항목을 설계했으며, 여기에는 라벨러의 신원(저자, 크라우드워커, 전문가 등), 라벨러 자격·훈련·지시서 제공 여부, 독립 라벨링 및 중복 라벨링 수행 여부, 상호 평가 지표(예: Cohen’s κ, Krippendorff’s α) 보고 여부, 크라우드워커 보상 수준 공개 여부, 라벨링 데이터의 공개 여부 등이 포함된다.

코딩 과정은 최소 두 명의 연구자가 독립적으로 수행하고, 불일치가 발생한 경우 토론을 통해 합의를 도출하였다. 이는 자체 라벨링 프로젝트와 동일한 신뢰성 확보 절차를 적용함으로써, 메타‑분석 자체의 품질을 보증한다. 결과는 크게 세 가지 차원에서 해석될 수 있다. 첫째, 라벨링 절차에 대한 보고가 전반적으로 불균형했으며, 절반 이상 논문이 라벨러의 정체나 훈련 과정에 대해 전혀 언급하지 않았다. 둘째, 상호 평가 지표를 제공한 논문은 극히 소수였으며, 제공된 경우에도 α값이 0.6 이하인 경우가 많아 신뢰성이 의심된다. 셋째, 데이터 공개와 보상 정보는 각각 20% 미만의 논문에서만 확인되었다.

이러한 결과는 머신러닝 연구가 “데이터 전처리·모델 설계”에 집중하는 경향이 강하지만, 근본적인 “골드 스탠다드” 구축 단계에서의 투명성과 검증이 소홀히 되고 있음을 시사한다. 특히, 라벨링이 구조화된 콘텐츠 분석과 동일한 인지·사회적 작업임을 인식하고, 해당 분야에서 확립된 코딩 스킴 정의, 파일럿 테스트, 독립 라벨링, 상호 평가, 불일치 조정 절차 등을 채택해야 한다는 점을 강조한다. 또한, 오픈 사이언스·재현성 운동과 연결해 라벨링 프로토콜과 데이터셋 자체를 문서화하고 공개하는 문화가 필요함을 역설한다.

마지막으로, 연구는 제한된 샘플(트위터 기반 논문)과 라벨링 정보가 논문에 명시되지 않은 경우 “정보 부재”로 코딩했기 때문에 실제 라벨링 절차가 존재했을 가능성을 완전히 배제하지 못한다는 한계를 인정한다. 향후 연구에서는 라벨러와 직접 인터뷰하거나, 라벨링 플랫폼 로그를 분석하는 등 보다 직접적인 증거 수집이 요구된다.

댓글 및 학술 토론

Loading comments...

의견 남기기