다중 구성 CNN RNN 기반 야생 환경 감정 차원 인식

본 논문은 OMG‑Emotion 챌린지를 위해 제안된 다중 구성 CNN‑RNN 모델을 소개한다. VGG‑16 및 ResNet‑50 기반의 CNN을 이용해 다양한 레이어의 특징을 추출하고, 이를 여러 RNN 서브넷에 입력함으로써 연속적인 valence와 arousal 값을 예측한다. Aff‑Wild 데이터로 사전 학습한 뒤 OMG‑Emotion 영상에 미세 조정하고, CCC 손실과 후처리(중간값 필터링, 스무딩)를 적용해 검증 성능을 최적화한다.

저자: Dimitrios Kollias, Stefanos Zafeiriou

본 논문은 One‑Minute Gradual‑Emotion Recognition(OMG‑Emotion) 챌린지에서 시각적 모달리티만을 이용해 연속적인 감정 차원인 valence와 arousal를 예측하는 새로운 딥러닝 프레임워크를 제안한다. 연구 배경으로는 기존 감정 인식 연구가 정형화된 실험실 환경에 국한되었으나, 최근 야생 환경 데이터가 증가하면서 ‘in‑the‑wild’ 조건에서의 감정 분석 필요성이 대두되고 있다는 점을 들었다. 이를 위해 저자들은 이전에 Aff‑Wild 데이터베이스에서 최고 성능을 기록한 CNN‑RNN 구조를 기반으로, 여러 레이어에서 추출된 특징을 동시에 활용하는 다중 구성 모델을 설계하였다.

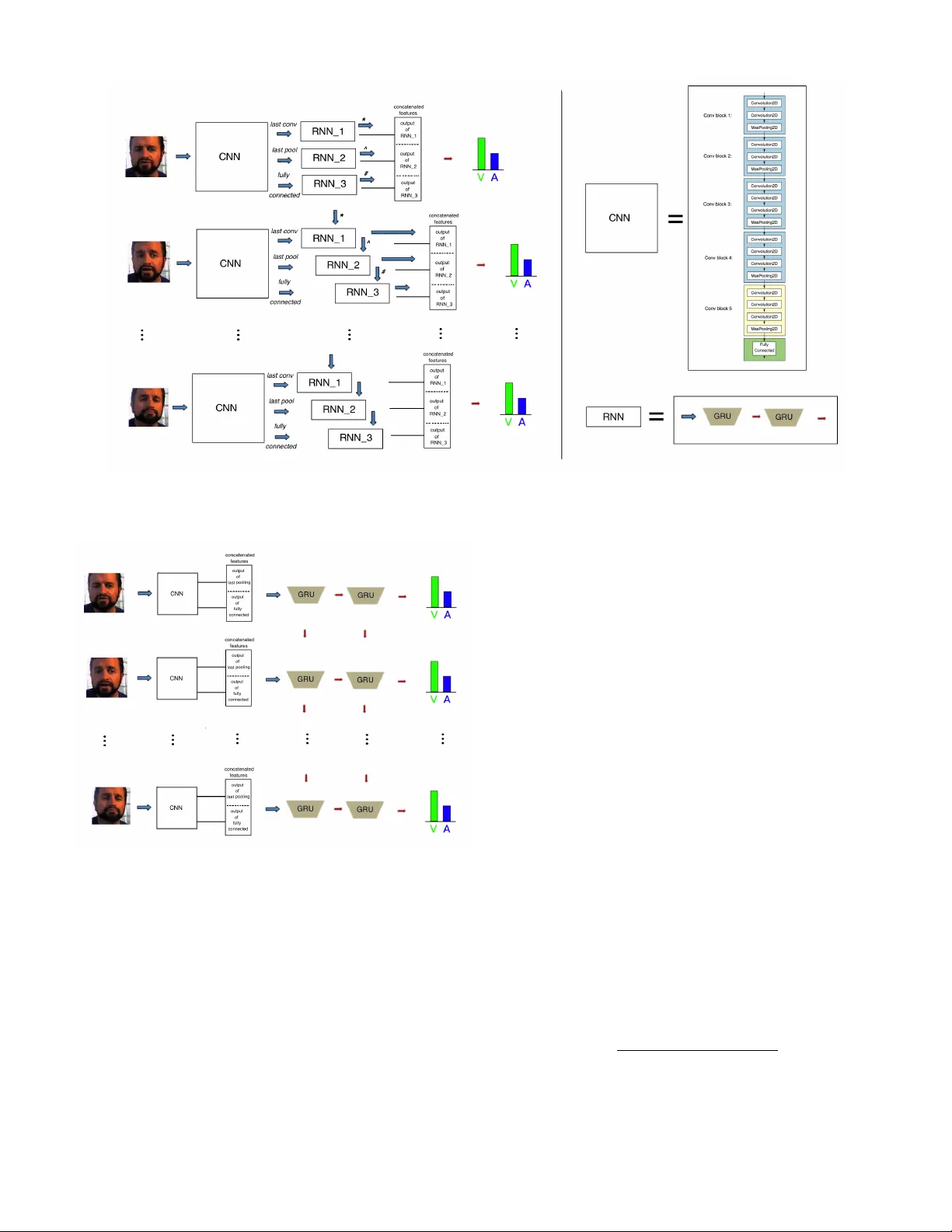

구체적인 모델 설계는 두 가지 주요 CNN 백본(VGG‑16, ResNet‑50)을 사용한다. VGG‑16 기반 모델은 8개의 블록(컨볼루션·풀링·FC)으로 구성되며, 마지막 컨볼루션, 마지막 풀링, 그리고 4096‑유닛 FC 레이어의 출력을 각각 별도의 2‑계층 RNN에 입력한다. 이 RNN들은 128 유닛을 가진 GRU/LSTM으로 구현되고, 최종적으로 각 RNN의 출력을 연결(concatenate)한 뒤 valence와 arousal를 동시에 예측하는 출력 레이어에 전달한다. ResNet‑50 기반 모델도 유사한 구조를 가지며, 필요에 따라 FC 레이어를 추가해 RNN 앞에 배치한다.

학습 과정은 두 단계로 이루어진다. 첫 번째 단계에서는 대규모 야생 데이터인 Aff‑Wild(298 비디오, 30시간 이상)으로 사전 학습을 수행해 얼굴 표정의 일반적인 특징을 학습한다. 두 번째 단계에서는 OMG‑Emotion 데이터(420 비디오, 2725 클립)로 미세 조정한다. 입력 영상은 DPM 기반 얼굴 검출기로 바운딩 박스를 추출하고, 96×96×3 크기로 리사이즈·정규화한다. 배치 크기 4, 시퀀스 길이 80프레임을 사용하며, 각 시퀀스는 해당 발화 전체에 대한 하나의 레이블(valence, arousal)을 공유한다. 손실 함수는 Concordance Correlation Coefficient(CCC)를 1‑ρ 형태로 최소화하도록 설계했으며, 평균과 중간값 두 가지 집계 방식을 실험했다.

성능 향상을 위해 후처리 단계가 도입되었다. 프레임 단위 예측에 대해서는 윈도우 크기 81(Valence)·3(Arousal)의 중간값 필터링을 적용하고, 발화 단위 예측에 대해서는 스무딩을 수행한다. 이러한 전처리·후처리 파이프라인은 검증 세트에서 CCC 점수를 일관되게 개선하였다. 또한, 서로 다른 CNN‑RNN 모델을 결합한 앙상블 기법을 적용했으며, 두 모델(VGG‑16 기반, ResNet‑50 기반)의 출력을 연결하거나 추가 FC 레이어를 삽입해 최종 예측을 수행한다.

실험 결과, 제안된 다중 구성 CNN‑RNN 모델은 기존 단일 CNN‑RNN 대비 valence와 arousal 모두에서 CCC 점수가 크게 향상되었으며, 특히 앙상블 모델이 가장 높은 성능을 기록했다. 이는 다양한 수준의 시각적 특징을 동시에 활용하고, 시간적 정보를 RNN이 효과적으로 통합함으로써 감정 차원 추정의 정확도를 높일 수 있음을 입증한다. 논문은 또한 CCC 기반 손실 함수와 맞춤형 후처리 전략이 연속 감정 예측에 유리함을 강조한다. 마지막으로, 향후 연구 방향으로는 텍스트·음성 등 다중 모달 정보를 통합하고, 더 큰 규모의 야생 데이터셋을 활용한 일반화 능력 강화가 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기