공간시간 상관성을 활용한 차세대 학습 비디오 압축

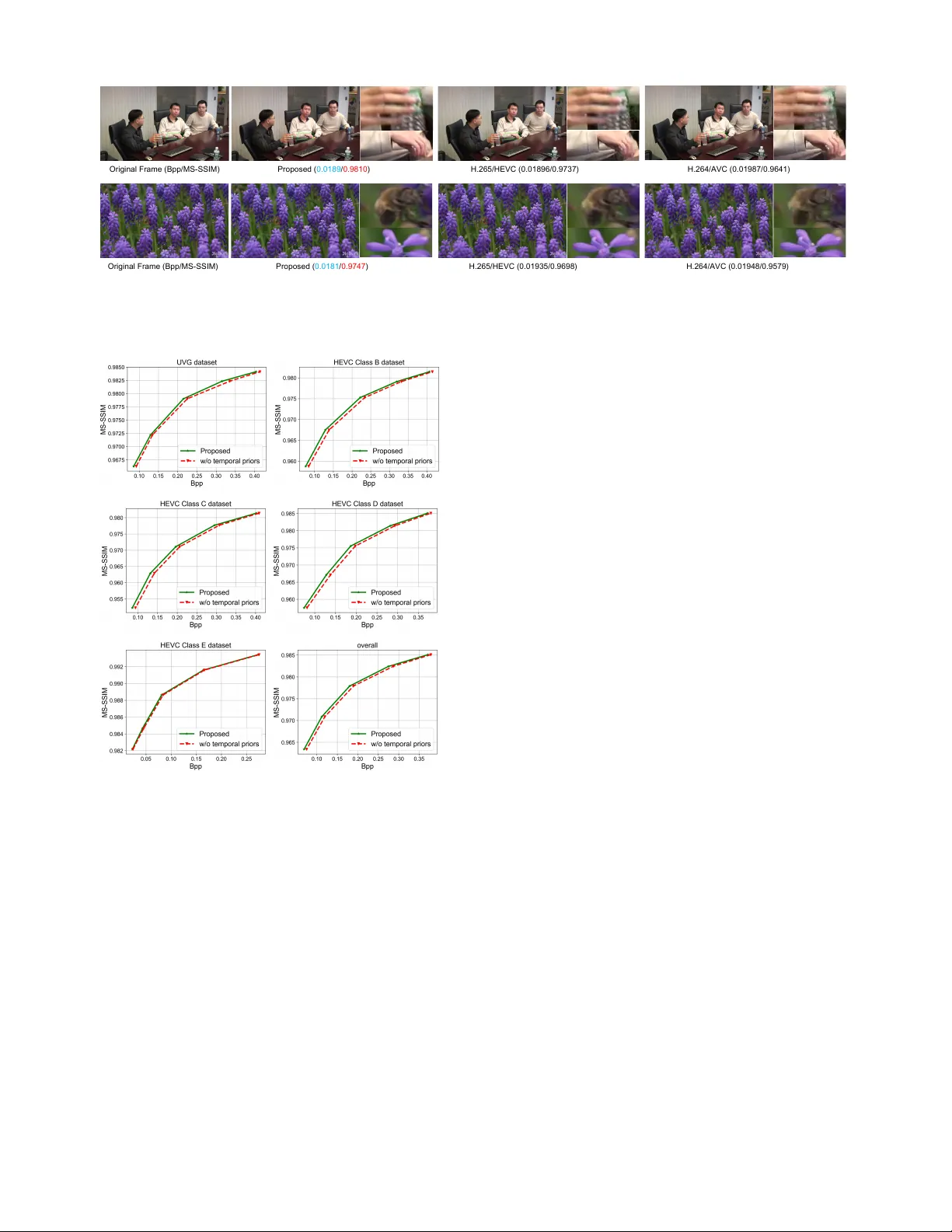

본 논문은 첫 번째 차원의 광학 흐름과 두 번째 차원의 흐름 예측을 결합한 새로운 학습 기반 비디오 압축 프레임워크를 제안한다. 흐름을 양자화된 특징으로 직접 학습·압축하고, 공간‑시간 결합 사전 정보를 ConvLSTM으로 전달해 적응형 엔트로피 코딩에 활용한다. 실험 결과, 저지연 시나리오에서 H.265/HEVC, H.264/AVC 및 기존 학습 압축 방법을 모두 능가하는 성능을 보였다.

저자: Haojie Liu, Han shen, Lichao Huang

본 논문은 비디오 압축에서 시간적 상관관계를 보다 정교하게 활용하기 위해, 첫 번째 차원의 광학 흐름(1차 흐름)과 두 번째 차원의 흐름 예측(2차 흐름)을 동시에 모델링하는 새로운 학습 기반 프레임워크를 제시한다. 기존의 전통적 비디오 코덱은 손으로 설계된 블록 기반 움직임 벡터와 복잡한 예측‑보정 구조에 의존해 왔으며, 최근의 학습 기반 이미지 압축 기술은 공간적 중복 제거에 뛰어난 성능을 보이지만, 시간적 중복을 효과적으로 다루는 방법은 아직 미흡했다. 이를 보완하고자 저자들은 다음과 같은 핵심 설계를 도입하였다.

1. **원스테이지 비지도 흐름 학습 및 양자화**

두 연속 프레임을 그대로 입력으로 사용해 비디오 프레임 간의 움직임을 직접 양자화된 특징(F)으로 학습한다. 이 과정은 사전 학습된 FlowNet2·PWC‑Net 같은 광학 흐름 네트워크를 필요로 하지 않으며, 흐름을 명시적으로 복원하지 않고도 압축 가능한 형태로 바로 변환한다. 특징 추출 네트워크는 비전역‑지역 상관을 포착하는 Non‑Local Attention Module(NLAM)와 다운샘플링 컨볼루션으로 구성되며, 양자화 후엔 엔트로피 코딩을 위해 확률 모델에 전달된다. 디코더는 동일한 구조를 역전시켜 양자화된 특징을 복원하고, 이를 H×W×2 크기의 흐름 벡터(ˆfd)로 변환해 이전 프레임을 워핑함으로써 예측 프레임(ˆXp) 을 만든다.

2. **2차 흐름 예측을 위한 적응형 엔트로피 모델**

흐름 자체에도 공간적, 시간적, 하이퍼(코드) 사전이 존재한다는 점에 착안해, 흐름 요소 Fi 를 주변 픽셀(공간 자동회귀), 이전 프레임의 동위치 흐름(시간 사전), 그리고 하이퍼 디코더가 제공하는 전역 통계(하이퍼 사전)와 결합한다. 구체적으로 3‑D 마스크 컨볼루션을 이용해 공간 자동회귀 사전을, ConvLSTM을 이용해 시간 사전을, VAE 기반 하이퍼 디코더를 이용해 하이퍼 사전을 추출한다. 이 세 사전을 함수 F에 입력해 평균 µF와 표준편차 σF 를 얻고, 가우시안 분포에 균일 잡음(Uniform

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기