페이스북 ResNeXt WSL 모델의 견고성: 대규모 약지도 학습이 가져온 변혁

초록

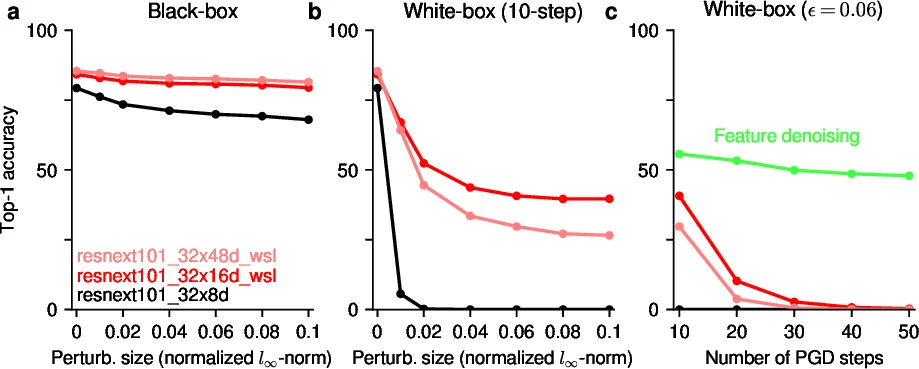

페이스북 AI가 공개한 10억 장 규모 Instagram 이미지로 약지도 학습한 ResNeXt 모델은 ImageNet‑C·P·A 벤치마크에서 기존 ImageNet‑학습 모델을 크게 앞서며, 일반 이미지 손상에 대한 강인성을 크게 향상시켰다. 그러나 10‑step PGD 공격에서만 제한적인 적대적 견고성을 보이고, 단계가 늘어나면 급격히 약화돼 진정한 적대적 방어는 아니었다. 시각화와 형태‑텍스처 실험을 통해 여전히 텍스처 편향이 남아 있음을 확인했다.

상세 분석

본 논문은 약 10억 장의 Instagram 이미지로 약지도(weak supervision) 학습한 ResNeXt‑101 계열 모델들을 대상으로, 기존 ImageNet‑전용 학습 모델과 비교하여 다양한 견고성 지표에서의 성능을 정량·정성적으로 분석한다. 모델은 cardinality 32에 폭넓은 bottleneck width(8, 16, 32, 48)를 적용한 5종류를 사용했으며, 가장 큰 48‑d 모델은 약 829 M 파라미터를 보유한다.

먼저 ImageNet‑C와 ImageNet‑P 벤치마크를 이용해 일반적인 이미지 손상(노이즈, 블러, 색상 변형 등)과 연속적인 변형에 대한 안정성을 측정한다. mCE(mean Corruption Error)와 rel. mCE, mFR(mean Flip Rate), mT5D(mean Top‑5 Distance)와 같은 지표는 모두 낮을수록 견고함을 의미한다. 표 1에서 확인할 수 있듯이, WSL 모델군은 기본 ResNeXt‑101(32×8d) 대비 mCE를 66.6→45.7, rel. mCE를 91.1→61.8 등 크게 감소시켰으며, 특히 가장 큰 48‑d 모델이 모든 지표에서 최첨단(SOTA) 수준을 기록한다. 이는 단순히 clean accuracy(79–85 %)의 소폭 향상(≈5 %)보다 손상 상황에서의 성능 향상이 훨씬 크다는 점을 강조한다.

다음으로 자연 적대적 예제 집합인 ImageNet‑A에 대한 정확도를 평가한다. 이 데이터셋은 텍스처, 배경, 색상 등에 과도하게 의존하는 기존 모델이 실수하기 쉬운 7,500장의 이미지로 구성된다. WSL 모델은 기존 ResNeXt‑101 대비 정확도가 현저히 상승했으며, 이는 대규모 약지도 학습이 “전역적인” 특징을 더 많이 포착하게 함을 시사한다.

적대적 견고성 측면에서는 10‑step PGD(ε=0.06) 화이트‑박스 공격에 대해 WSL 모델이 0 %에 가까운 정확도를 보이는 기존 모델과 달리 30–40 % 수준의 정확도를 유지한다. 이는 “데이터 규모만으로도 일정 수준의 적대적 견고성을 얻을 수 있다”는 흥미로운 결과다. 그러나 50‑step PGD로 공격 강도를 높이면 정확도가 급격히 0 %에 수렴해, 진정한 적대적 방어(예: adversarial training 기반 모델)와는 차이가 있음을 확인한다.

시각화 실험에서는 최종 레이어 직전 유닛을 최대 활성화하도록 PGD 기반 최적화를 수행했을 때, 비‑견고 모델은 초기 시드 이미지에 크게 의존해 잡음 같은 결과가 나오지만, 진정한 견고 모델은 의미 있는 패턴을 생성한다. WSL 모델의 시각화는 전자는 아니며, 이는 적대적 견고성 부재를 시각적으로도 뒷받침한다.

마지막으로 형태‑텍스처 충돌 실험(Geirhos et al., 2019)을 통해 모델의 편향을 정량화했다. WSL 모델은 텍스처 편향이 다소 감소했지만(Shape bias ↑), 인간 수준의 형태 중심 편향에 도달하지 못한다. 즉, 대규모 약지도 학습이 텍스처 의존성을 완전히 해소하지는 못한다는 결론이다.

전체적으로, 논문은 (1) 대규모 약지도 데이터가 일반 손상에 대한 견고성을 크게 향상시킨다, (2) 제한적인 적대적 견고성을 제공하지만 지속적인 공격에는 취약하다, (3) 텍스처 편향은 여전히 남아 있어 데이터 규모만으로는 인간과 유사한 인식 메커니즘을 구현하기 어렵다는 점을 강조한다. 이러한 결과는 향후 모델 평가에 있어 clean accuracy보다 ImageNet‑C/P/A와 같은 견고성 지표가 더 의미 있는 목표가 될 수 있음을 시사한다.

댓글 및 학술 토론

Loading comments...

의견 남기기