다중 뷰 통합으로 카테고리별 3D 형태 복원 혁신

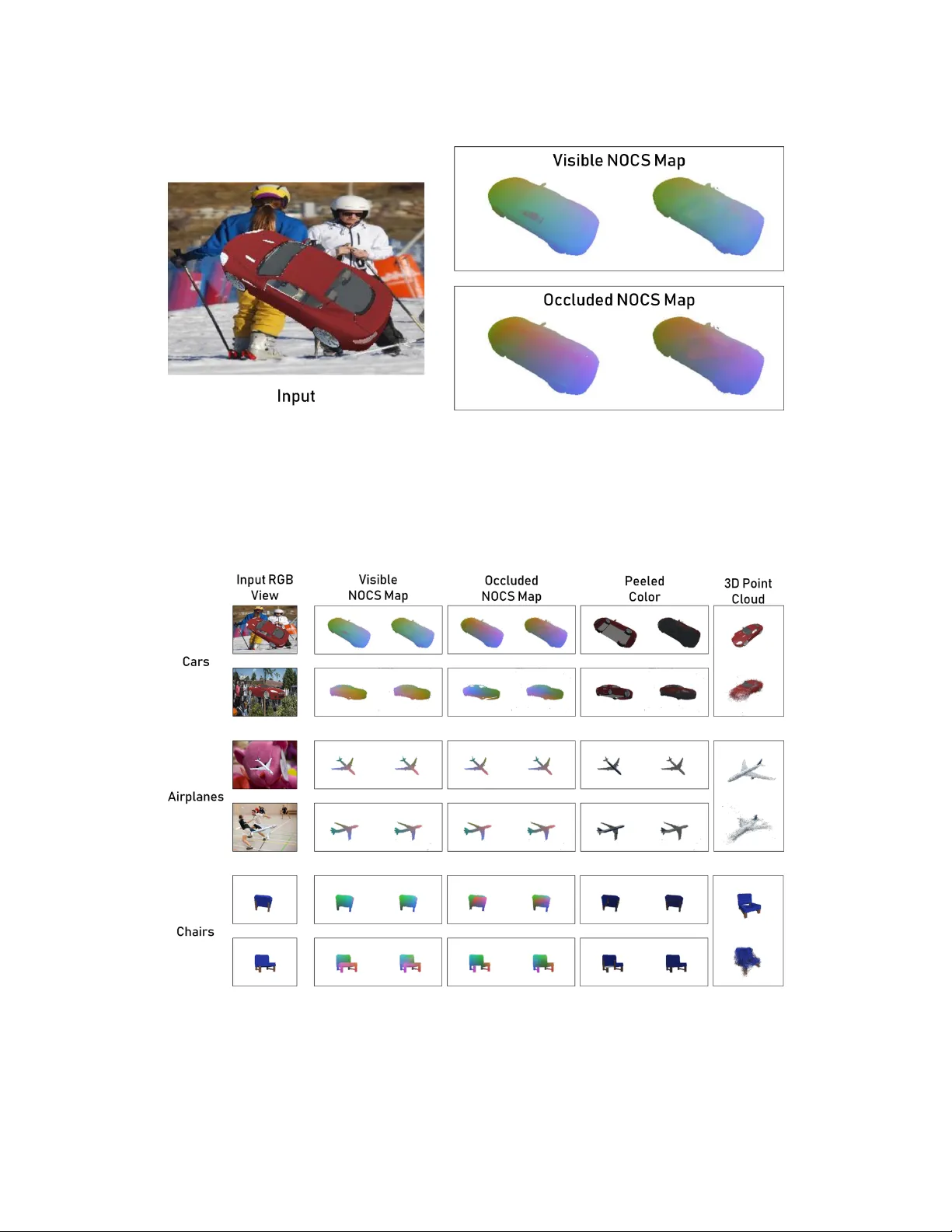

본 논문은 가변적인 RGB 뷰 수를 입력으로 받아, 카테고리 수준에서 밀집한 3D 형태를 복원하는 새로운 X‑NOCS 표현과 뷰 순서에 무관한 집합 연산 방식을 제안한다. 단일 뷰에서는 가시 표면과 가시선 뒤에 숨은 표면을 동시에 예측하고, 다중 뷰에서는 퍼뮤테이션 등가 레이어를 이용해 특징을 교환한 뒤 저비용 유니온 연산으로 전체 형태를 통합한다. 실험 결과, 뷰 수가 증가할수록 정밀도가 향상되는 것을 확인하였다.

저자: Srinath Sridhar, Davis Rempe, Julien Valentin

본 논문은 “Multiview Aggregation for Learning Category‑Specific Shape Reconstruction”이라는 제목으로, 가변적인 수의 RGB 이미지 뷰를 입력받아 카테고리 수준에서 밀집한 3D 형태를 복원하는 새로운 프레임워크를 제시한다. 기존 연구들은 주로 voxel, point cloud, mesh와 같은 희소하거나 메모리 소모가 큰 표현을 사용하거나, 고정된 뷰 수를 전제로 했다. 저자들은 이러한 제약을 넘어, (1) 가시 표면과 가시선 뒤에 숨은 표면을 동시에 인코딩할 수 있는 X‑NOCS(Normalized Object Coordinate Space) 지도, (2) 뷰 순서에 무관한 퍼뮤테이션 등가 레이어를 이용한 특징 교환, (3) 저비용 집합 합집합 연산을 통한 다중 뷰 형태 통합이라는 세 가지 핵심 요소를 결합한다.

먼저, NOCS 지도는 객체를 단위 큐브 안에 정규화하고, 각 픽셀에 해당하는 3D 좌표를 색상으로 저장한다. 이는 2D 이미지와 3D 포인트 클라우드 사이의 강한 픽셀‑좌표 대응을 제공한다. 그러나 기존 NOCS는 가시 표면만을 담아 occlusion을 처리하지 못한다. 이를 해결하기 위해 저자는 depth peeling 기법을 차용해 레이와의 첫 번째 교차점(가시 표면)과 마지막 교차점(가시선 뒤 표면)을 추출하고, 이를 각각 NOCS와 X‑NOCS로 명명한다. 두 레이어만 사용해도 대부분의 복합 형태를 충분히 표현할 수 있어 연산량을 크게 절감한다.

다음으로, 다중 뷰를 활용하기 위해 퍼뮤테이션 등가 레이어를 도입한다. 이 레이어는 입력 뷰들의 특징을 집합 형태로 처리해 순서에 독립적인 정보를 학습한다. 따라서 훈련 시 1~N개의 뷰를 무작위로 제공해도 네트워크가 일관된 표현을 학습할 수 있다. 각 뷰별로 SegNet 기반 인코더‑디코더가 NOCS와 X‑NOCS를 예측하고, 중간 특징은 퍼뮤테이션 등가 레이어를 통해 교환된다. 최종적으로 각 뷰에서 얻은 두 지도는 3D 포인트 집합으로 변환된 뒤, 단순히 집합 합집합(Union) 연산을 수행해 하나의 밀집 형태로 통합된다. 이 과정은 GPU 메모리와 연산량을 최소화하면서도 정확한 형태 합성을 가능하게 한다.

학습 데이터는 ShapeNet에서 추출한 자동차, 의자, 비행기 세 카테고리의 합성 객체를 사용했다. 각 객체에 대해 다양한 카메라 위치와 조명을 적용해 RGB 이미지와 대응되는 NOCS·X‑NOCS 지도, 그리고 선택적으로 색상 피딩 이미지(occluded surface texture)를 생성했다. 손실 함수는 L1/L2 거리와 표면 정규화 손실을 결합해 좌표와 색상의 정확성을 동시에 최적화한다.

실험 결과, 제안 방법은 단일 뷰 기준 모델보다 평균 IoU가 7~12% 향상되었으며, 뷰 수가 늘어날수록 정밀도가 꾸준히 상승한다. 특히, 얇은 다리, 복잡한 곡면 등 세부 구조 복원에서 기존 voxel‑기반(3D‑CNN)이나 point‑cloud‑기반(PointNet++) 방법보다 월등히 높은 품질을 보였다. 또한, 메모리 사용량은 2D 컨볼루션 기반이므로 3D voxel 네트워크 대비 5배 이상 효율적이었다.

한계점으로는 현재 카테고리 제한과 합성 데이터에 의존한다는 점, X‑NOCS가 내부 구조(예: 물체 내부 빈 공간)를 표현하지 못한다는 점을 들 수 있다. 향후 실제 촬영 데이터와 더 다양한 카테고리로 확장하고, 깊이 피링 레이어를 동적으로 조절하거나 내부 구조를 포함하는 확장 표현을 연구하는 것이 제안된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기