앞을 내다보는 최적화 알고리즘 Lookahead

초록

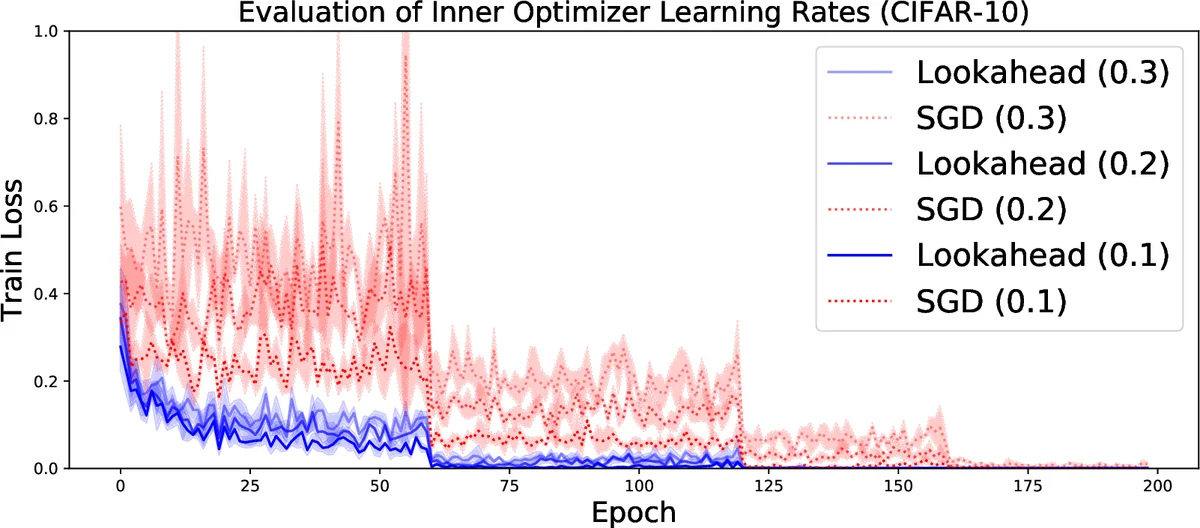

Lookahead는 기존 SGD, Adam 등 내부 옵티마이저와 별개로 “빠른 가중치”와 “느린 가중치” 두 집합을 교대로 업데이트하는 방법이다. 내부 옵티마이저가 k번 빠르게 움직인 뒤, 느린 가중치를 빠른 가중치 쪽으로 α 비율만큼 선형 보간해 이동한다. 이 과정은 변동성을 감소시키고 학습 안정성을 높이며, 계산·메모리 오버헤드가 거의 없다는 장점이 있다. CIFAR‑10/100, ImageNet, NMT, Penn Treebank 등 다양한 베치에서 기존 옵티마이저 대비 수렴 속도와 최종 성능이 향상됨을 실험적으로 입증한다.

상세 분석

Lookahead는 두 단계의 파라미터 집합을 유지한다. “빠른 가중치”(θ)는 선택한 내부 옵티마이저 A(예: SGD, Adam)를 사용해 k번 연속 업데이트한다. 이때 학습률은 기존 옵티마이저와 동일하게 설정해도 되며, 오히려 큰 값으로 설정해도 빠른 가중치가 고곡률 방향에서 진동을 일으키는 것을 완화한다. k번 업데이트가 끝나면 “느린 가중치”(φ)를 θ와 φ 사이의 차이 벡터에 α 비율만큼 이동시킨다: φ←φ+α(θ_k−φ). 이후 빠른 가중치를 φ로 복사해 다음 루프를 시작한다. 이 외삽 단계는 실제로 θ_k에 대한 지수 이동 평균(EMA) 형태를 만든다. 수식 (1)·(2)에서 보듯, φ는 최근 k번의 최종 빠른 가중치에 큰 가중치를 두고, 이전 빠른 가중치들의 영향은 (1−α)ⁿ 형태로 점점 감소한다.

이러한 구조는 변동성 감소 메커니즘을 제공한다. 논문에서는 잡음이 있는 2차 모델 L̂(x)=½(x−c)ᵀA(x−c) (c∼N(0,Σ))를 분석해, 동일 학습률 γ를 사용할 경우 SGD와 Lookahead의 고정점 분산을 각각 V*_SGD와 V*_LA로 도출한다. V*_LA는 V*_SGD에 비해 α와 (I−γA)ᵏ에 의해 곱해진 항이 추가돼 항상 작다(α∈(0,1) 가정). 따라서 같은 학습률이라도 Lookahead는 더 낮은 정규화 위험을 가진다. 또한 시뮬레이션 결과는 동일한 정규화 위험을 목표로 할 때 Lookahead가 더 빠르게 수렴함을 보여준다.

이론적 분석 외에도, 저자는 실제 딥러닝 작업에 적용해 보았다. k와 α는 보통 k=5~10, α=0.5가 기본값이며, α를 자동으로 조정하는 적응형 스킴도 제안한다. 적응형 α는 경험적 피셔(Fisher) 근사치를 이용해 최적 α*를 추정하고,

댓글 및 학술 토론

Loading comments...

의견 남기기