인공 신경망의 평생 구조 진화와 자가 조직화된 네트워크

초록

본 논문은 최소 구조만을 가진 ‘Unstructured Recursive Network(URN)’를 제안하고, L1 가중치·활성도 정규화와 입력 데이터의 기하학적 특성을 이용한 손실 함수 설계가 훈련 과정에서 완전 연결, 지역 연결, 잔차(skip) 구조 등 다양한 신경망 토폴로지를 자동으로 형성하도록 함을 실험적으로 입증한다.

상세 분석

URN은 S개의 뉴런을 하나의 벡터 N에 담고, 동일한 S×S 가중치 행렬 W와 편향 b를 사용해 N을 I번 반복 업데이트하는 재귀적 구조를 갖는다. 초기 W는 완전 밀집(He 초기화)이며, 블록 대각선 형태와 같은 사전 설계된 구조가 전혀 없다. 핵심은 손실 함수 L = (1/N)·L_XE + c_W·|W| + c_N·∑_l |N^{(l)}| 로, 여기서 c_W와 c_N은 각각 가중치와 뉴런 활성도에 대한 L1 정규화 강도를 조절한다. 높은 정규화 강도는 불필요한 연결과 뉴런을 자동으로 0으로 만들면서, 네트워크가 최소한의 활성 뉴런과 가중치만을 남기도록 압축한다.

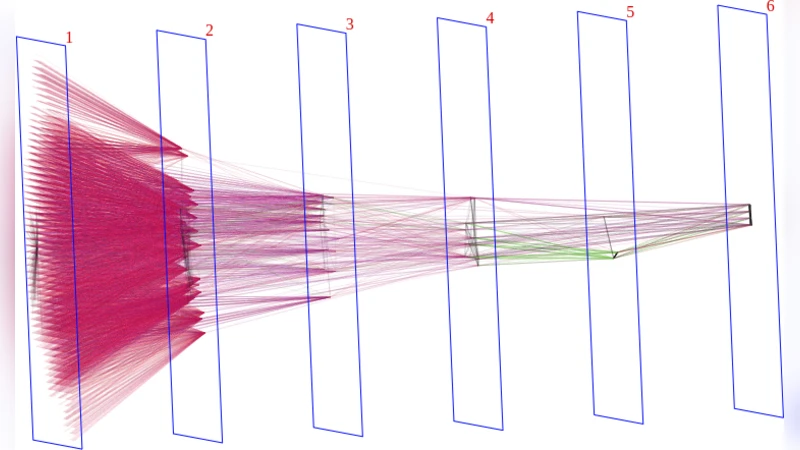

실험에서는 5000개의 뉴런을 가진 URN을 4번 반복(I=4)하여 10차원 구형 쉘 데이터셋을 학습시켰다. 정규화 파라미터를 충분히 크게 설정하면, 최종적으로 100% 정확도를 달성하면서도 활성 뉴런이 120개 정도로 급감하고, 가중치 행렬이 명확한 블록 서브대각선 형태를 띠어 3개의 은닉층을 가진 MLP 구조가 드러났다. 이는 “재귀적 업데이트 횟수 I가 실제 은닉층 수와 일치한다”는 가설을 실증한다.

잔차 연결을 도입한 변형(출력에 누적합을 적용)에서는 네트워크가 학습 초기에 출력 변화를 멈추고, 실제 사용된 층 수가 I보다 작아졌다. 즉, 잔차 메커니즘은 동적으로 필요한 깊이를 선택하게 만든다. 입력에 잔차를 추가하면 스킵 연결이 자연스럽게 형성되지만, 뉴런 활성 패턴이 복잡해져 해석이 어려워진다.

입력 데이터에 공간적 메트릭을 부여하고, 시냅스 길이 정규화(∑|W_ij|·d_ij^γ) 를 손실에 포함시키면, 지역 연결(LCN) 구조가 자동으로 나타난다. CIFAR‑10 흑백 이미지에 대해 60×60×6 격자를 사용하고, 시냅스 길이 정규화를 적용한 결과, 전방 가중치는 주로 z축이 증가하는 방향으로 집중되고, 다른 방향의 연결은 거의 사라져 10% 정도 정확도가 향상되었다.

논의에서는 URN이 현재는 주로 피드포워드 구조를 생성하지만, 과제 난이도에 따라 재귀적·순환적 구조가 나타날 가능성, 가중치 공유(컨볼루션)와 같은 추가 제약을 어떻게 도입할지, 그리고 왜 피드포워드 형태가 자주 등장하는지에 대한 이론적 설명이 아직 부족함을 인정한다. 또한, 연속적인 과제 학습(NEVER‑ENDING STRUCTURE ACCUMULATION, NESA) 시 URN이 점진적으로 깊이를 늘려가며 평생 학습을 수행할 수 있다는 전망을 제시한다.

요약하면, URN은 “구조가 없는” 초기 상태에서 손실 함수와 정규화 항에 의해 데이터와 하이퍼파라미터에 맞는 최적의 네트워크 토폴로지를 스스로 찾아낸다. 이는 신경망 설계 비용을 크게 낮추고, 생물학적 신경망이 평생 동안 구조를 재구성하는 현상을 인공 시스템에 도입하려는 중요한 시도이다.

댓글 및 학술 토론

Loading comments...

의견 남기기