생물학적 영감을 받은 경량 딥 강화학습 아키텍처

본 논문은 텐서 분해와 웨이브렛 스캐터링, 그리고 K‑FAC와 같은 2차 최적화를 결합해 Atari 환경에서 기존 Rainbow 기반 에이전트 대비 2~10배 적은 파라미터로 유사한 성능을 달성한다는 실험적 증거를 제시한다.

저자: Pierre H. Richemond, Arinbj"orn Kolbeinsson, Yike Guo

본 논문은 딥 강화학습이 요구하는 막대한 샘플 수와 수백만 개에 달하는 파라미터를 줄이기 위해, 생물학적 신경 메커니즘을 모방한 두 가지 수학적 도구—텐서 팩터라이제이션과 웨이브렛 스캐터링—를 도입하고, 이를 K‑FAC와 같은 2차 최적화 기법과 결합한다. 서론에서는 인간 수준의 Atari 성능을 달성하기 위해 수억 프레임이 필요하다는 점을 지적하고, 최근 연구들이 샘플 효율성을 크게 개선했지만 네트워크 규모는 여전히 과잉이라는 문제점을 제시한다. 또한, 신경 과학에서 관찰되는 저‑랭크 퍼셉추얼 매니폴드와 Gabor‑형 필터가 딥러닝에 적용될 가능성을 언급한다.

배경 부분에서는 강화학습의 기본 MDP 정의와 Q‑러닝, Rainbow 알고리즘의 주요 구성 요소(Double Q‑learning, Dueling 네트워크, Prioritized Replay 등)를 정리한다. 이어 텐서 팩터라이제이션을 CP와 Tucker 두 형태로 소개하고, 저‑랭크 텐서 회귀 레이어가 어떻게 기존 완전 연결층을 대체하면서 파라미터 수를 크게 감소시키는지를 수식적으로 설명한다. 웨이브렛 스캐터링 섹션에서는 고정된 파동 필터와 비선형 모듈(모듈러스)로 구성된 두 단계 컨볼루션을 통해 첫 번째 특징 추출 층을 학습 없이 구현하는 방법을 제시한다. K‑FAC 섹션에서는 Fisher 정보 행렬을 Kronecker 구조로 근사해 효율적인 2차 업데이트를 수행하는 원리를 설명하고, 강화학습에서의 성공적인 적용 사례를 인용한다.

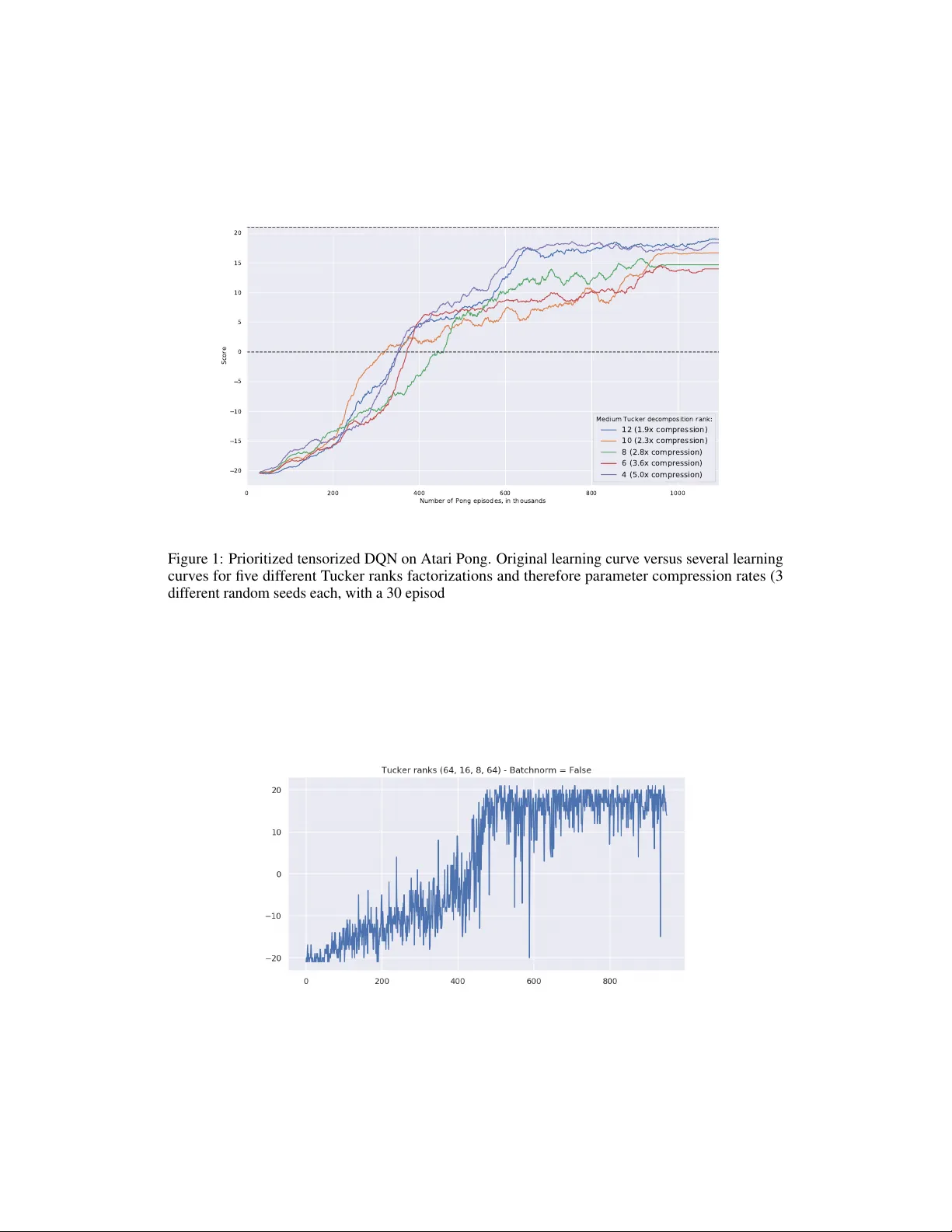

방법론에서는 데이터‑효율적인 Rainbow을 베이스라인으로 삼고, (1) 완전 연결층을 텐서 회귀 레이어로 교체해 다양한 랭크(2.5×, 5×, 10× 압축) 설정, (2) 옵티마이저를 ADAM에서 K‑FAC으로 교체, (3) 가능한 경우 첫 번째 컨볼루션을 스캐터링 레이어로 교체하는 세 가지 변형을 실험한다. 실험 환경은 OpenAI Gym Atari 26게임 중 절반을 선택해 100,000 스텝(약 2시간) 내에서 3개의 시드로 평균을 산출했다. 하이퍼파라미터와 랭크 설정은 부록에 상세히 기술된다.

결과는 표 1과 표 2에 정리된다. 표 1에서는 저‑랭크 텐서 회귀 레이어만 적용했을 때, 압축 비율이 커질수록 평균 점수가 감소하지만, 5× 압축에서도 평균 96 % 수준을 유지한다는 점을 보여준다. 특히 NoisyNet을 제거한 ‘Denoised’ 변형이 파라미터 수를 절반 이상 줄이면서도 성능 저하를 최소화한다. 표 2에서는 K‑FAC을 적용한 경우, 동일 압축 비율에서도 평균 점수가 109 %~114 %로 오히려 향상되는 것을 확인한다. 스캐터링을 적용한 실험은 계산 비용 제한으로 일부 게임에만 수행했지만, 파라미터 수를 거의 0에 가깝게 만들면서도 경쟁력 있는 점수를 기록한다.

논의에서는 저‑랭크 근사가 탐색 노이즈와 유사한 효과를 제공한다는 가설을 제시하고, 압축 비율이 지나치게 높으면 표현력 손실이 급격히 나타나 성능이 급락한다는 한계를 인정한다. 또한, K‑FAC이 2차 정보를 활용해 학습 속도를 크게 개선함으로써, 저‑랭크 모델의 최적화 난이도를 보완한다는 점을 강조한다. 결론에서는 생물학적 저‑랭크 구조와 고정된 파동 필터라는 두 가지 inductive bias가 샘플 효율성과 파라미터 효율성을 동시에 달성할 수 있음을 실험적으로 증명했으며, 향후 스캐터링 아키텍처의 전면 적용, 스파시티 기반 정규화, 그리고 더 복잡한 환경(예: 3D 시뮬레이션)으로의 확장 가능성을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기