이미지 적응형 GAN 기반 복원

본 논문은 사전 학습된 GAN 생성기를 테스트 시점에 이미지‑특화 방식으로 미세조정하고, 관측 데이터와의 일치를 강화하기 위해 백프로젝션을 적용함으로써 초해상도와 압축 센싱에서 기존 GAN 기반 복원보다 높은 정확도와 시각적 품질을 달성한다.

저자: Shady Abu Hussein, Tom Tirer, Raja Giryes

본 논문은 최근 딥러닝 기반 생성 모델, 특히 GAN과 VAE가 이미지 샘플링 품질을 크게 향상시켰음에도 불구하고, 복잡한 이미지 클래스(예: 인간 얼굴)의 전체 데이터 분포를 완전히 포착하지 못한다는 문제점을 지적한다. 이러한 제한은 사전 학습된 생성기를 이용해 이미지 복원(초해상도, 압축 센싱 등) 문제를 해결하려는 기존 연구에서 재구성 정확도가 낮게 나타나는 원인으로 작용한다.

관련 연구 섹션에서는 CSGM(Bora et al., 2017)을 중심으로, 사전 학습된 생성기를 압축 센싱의 사전(prior)으로 활용하는 방법을 소개한다. CSGM은 관측 y와 생성기 출력 G(z) 사이의 ℓ₂ 손실을 최소화하는 잠재벡터 z를 찾지만, 생성기의 표현 범위가 제한적이어서 관측이 충분히 많거나 잡음이 거의 없을 때도 복원 품질이 떨어진다. 또한, 내부 학습만을 이용하는 DIP, Deep Image Prior, 그리고 최근의 내부‑외부 학습 결합 방식(Tirer & Giryes, 2019) 등도 언급되지만, 이들 방법은 외부 사전 지식이 부족하거나 메모리·시간 요구량이 크게 늘어나는 단점이 있다.

이에 저자들은 두 가지 핵심 기법을 제안한다. 첫 번째는 “이미지‑적응(Image‑Adaptive, IA) 접근법”이다. 기존 CSGM에서 얻은 초기 ẑ를 시작점으로 삼고, 사전 학습된 생성기 파라미터 θ와 z를 동시에 최적화한다. 최적화 목표는 f_IA(θ, z) = ‖y − A G_θ(z)‖₂²이며, 이는 관측 모델 A와 손실 함수가 직접 연결된 형태다. 초기 θ는 사전 학습된 가중치를 그대로 사용하고, 학습률을 작게 잡아 조기 종료(Early Stopping)를 적용함으로써 오프라인에서 학습된 의미론적 정보가 과도하게 변형되지 않도록 한다.

수학적 근거는 Bora et al. (2017)의 정리 1.1을 확장한다. 정리에서는 측정 행렬 A가 가우시안이며, 측정 수 m이 k_L·log n보다 충분히 클 때, 최적화된 ẑ에 대한 재구성 오차가 표현 오류 E_rep(G, x)와 잡음‖e‖에 의해 제한된다고 증명한다. 저자들은 첫 번째 레이어의 가중치 W₁을 추가 최적화하면 표현 오류가 감소한다는 명제(Prop. 2)를 제시한다. 이는 W₁을 포함한 새로운 생성기 G̃가 더 큰 잠재공간을 제공하므로, 원본 이미지 x에 더 가깝게 매핑될 가능성이 높아진다. 이 논리를 모든 레이어에 순차적으로 적용하면 표현 오류를 점진적으로 감소시킬 수 있다.

두 번째 기법은 “백프로젝션(Back‑Projection, BP)”이다. 관측이 거의 잡음이 없을 경우, 복원된 이미지 ˆx를 관측 방정식 A x = y를 만족하는 affine subspace에 정규 직교 투영한다. 이는 ˆx_bp = A†y + (I − A†A) ˆx 로 계산되며, A†는 의사역행렬이다. BP는 행공간에서의 오차를 완전히 제거하고, 영공간에 존재하는 오류만 남긴다. 잡음이 존재하면 A†y가 잡음을 증폭할 위험이 있으므로, 저자들은 저노이즈 상황에서만 BP를 적용한다.

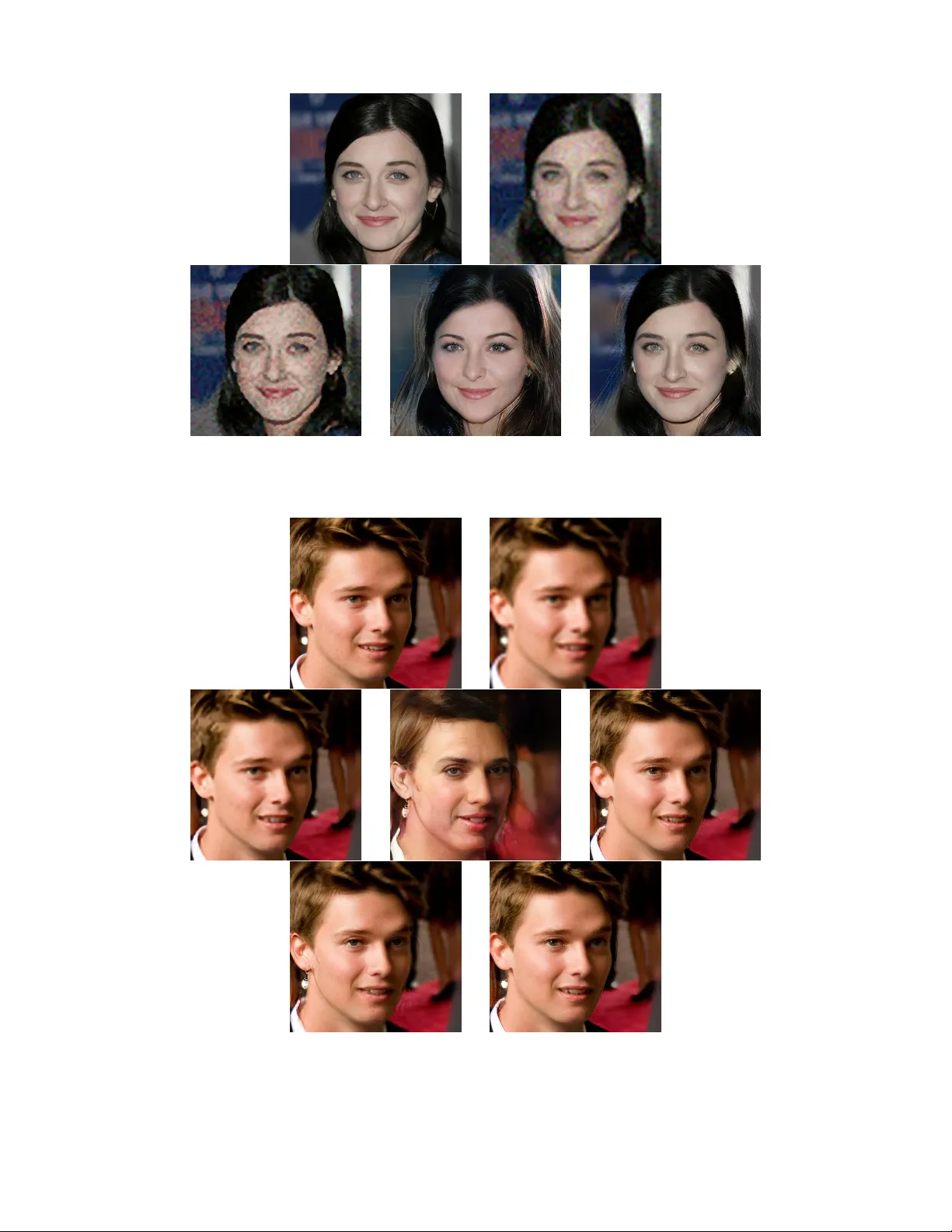

실험에서는 두 가지 최신 GAN, BEGAN(128×128)과 PGGAN(1024×1024)를 CelebA와 CelebA‑HQ 데이터셋에서 사전 학습된 모델을 그대로 사용하였다. 압축 센싱에서는 Gaussian 측정 행렬을, 초해상도에서는 4× 다운샘플링 + 블러링 연산자를 적용했다. 비교 대상은 기존 CSGM, CSGM‑BP, 그리고 제안 IA‑GAN, IA‑GAN‑BP이다. 결과는 다음과 같다.

1. **압축 센싱**: m/n = 0.12(≈12 % 측정)에서 IA‑GAN‑BP가 PSNR을 약 2.5 dB 향상시켰으며, 시각적으로도 눈에 띄게 선명한 얼굴 디테일을 복원했다. m/n = 0.61(≈61 % 측정)에서도 IA‑GAN이 CSGM 대비 1.8 dB 이득을 보였다.

2. **초해상도**: 4× 초해상도(×4)에서 IA‑GAN‑BP는 기존 GAN‑기반 방법보다 SSIM이 0.03 정도 높았으며, 특히 눈, 입술 등 고주파 영역에서 블러링이 크게 감소했다.

3. **연산 효율성**: IA 단계는 약 200–300번의 추가 gradient step을 필요로 했으며, 전체 실행 시간은 CSGM 대비 1.5배 정도 증가했지만, GPU 메모리 사용량은 DIP와 비교해 30 % 이하로 유지되었다.

4. **한계 및 향후 과제**: 높은 잡음 수준에서는 BP가 잡음을 증폭해 PSNR이 감소했으며, IA 단계의 학습률·조기 종료 기준이 데이터마다 민감하게 작용한다. 또한, 현재 실험은 얼굴 이미지에 국한돼 있어, 자연 풍경이나 의료 영상 등 다른 도메인에 대한 일반화 검증이 필요하다.

결론적으로, 사전 학습된 GAN의 의미론적 강점을 유지하면서 테스트 시점에 이미지‑특화 파라미터 튜닝과 관측 일치 강화를 결합한 본 접근법은 복잡한 이미지 복원 문제에서 기존 방법들을 능가한다. 향후 다양한 측정 모델과 잡음 환경, 그리고 다른 이미지 도메인에 대한 확장 연구가 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기