스파이킹 뉴런을 위한 강화학습 기반 헤비안 시냅스 업데이트

이 논문은 강화학습의 직접 정책경사 알고리즘을 스파이킹 뉴런 네트워크에 적용해, 전·후 시냅스 활동과 전역 보상 신호만을 이용하는 국소적인 시냅스 가중치 업데이트 규칙을 유도한다. 제시된 규칙은 전통적인 헤비안 법칙과 형태가 유사하지만, 보상에 의해 변조되어 장기 평균 보상을 최적화한다. 다중 에이전트(뉴런) 상황에서도 통신 없이 독립적으로 학습이 가능함을 증명하고, 패턴 분류와 모터 학습 시뮬레이션을 통해 실효성을 확인한다.

저자: Peter L. Bartlett, Jonathan Baxter

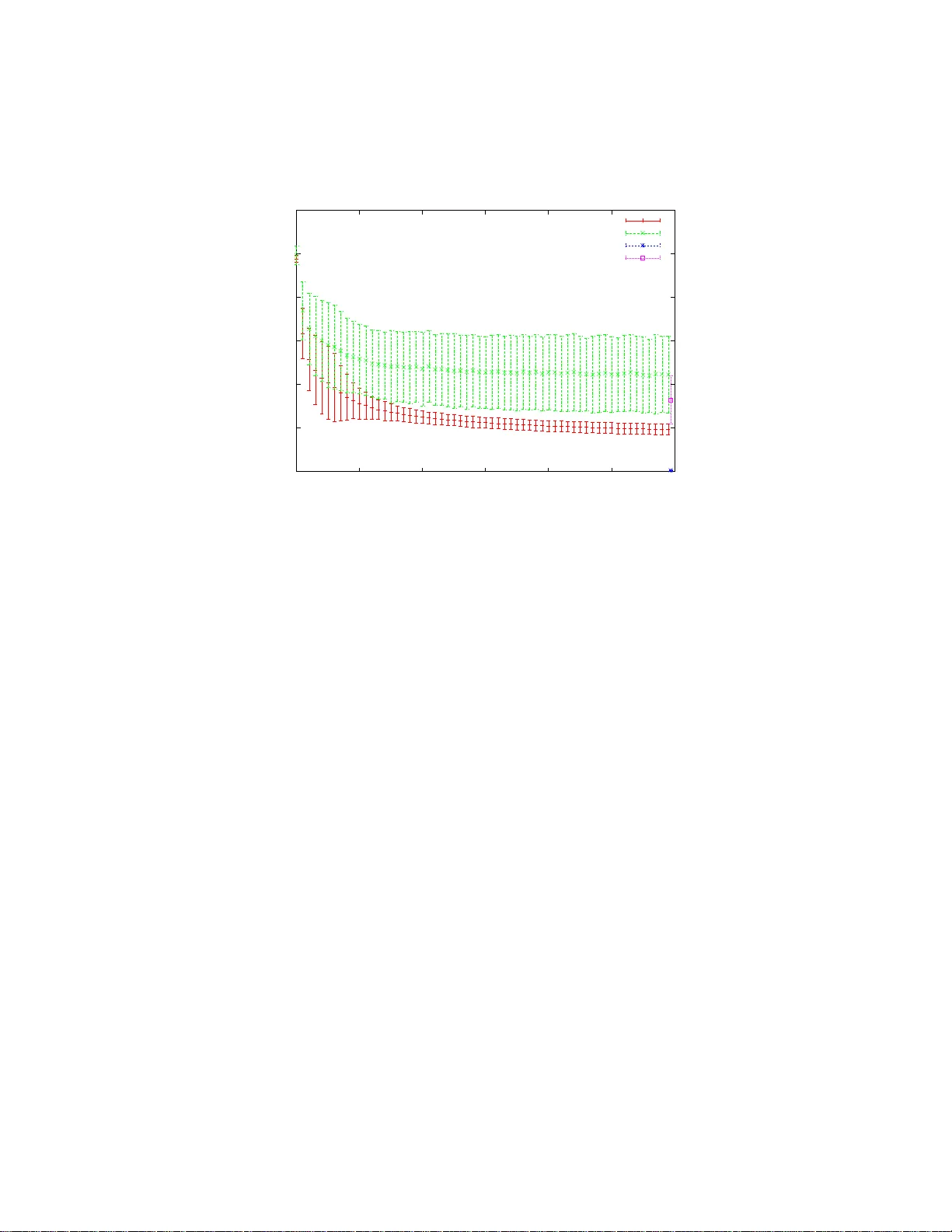

논문은 먼저 기존의 Hebbian 시냅스 가중치 변화 이론을 검토하고, 그 한계—특히 학습 성능을 정량적으로 보장하지 못한다는 점—를 지적한다. 이어서 강화학습(RL)의 일반적 프레임워크를 소개한다. 여기서는 에이전트가 관찰 y_t와 파라미터 θ에 기반해 확률적 정책 μ(y_t,θ)로 행동 u_t를 선택하고, 장기 평균 보상 η=lim_{T→∞} (1/T)∑_{t=1}^T r_t 를 최대화한다는 목표를 설정한다. 저자는 이전 연구

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기