모든 지역 최소점이 전역 최소점인 비볼록 머신러닝 이론

초록

본 논문은 비볼록 최적화 문제에서 ‘교란 가능한 그래디언트 기반 모델(perturbable gradient basis model)’을 도입하고, 미분 가능한 모든 점에서 지역 최소값이 해당 모델의 전역 최소값과 동일함을 증명한다. 이를 통해 손실 함수가 미분 가능한 지역 최소점에서만 평가될 경우, 비볼록 딥러닝 모델도 이론적으로는 볼록 모델과 동등한 최적화 보장을 갖는다는 결론을 제시한다. 증명은 완화된 가정 하에 이루어지며, 기존 딥 네트워크, 잔차 네트워크, 과잉 파라미터화 네트워크 등에 바로 적용 가능하다. 또한 표현 학습 이론에도 새로운 기반을 제공한다.

상세 분석

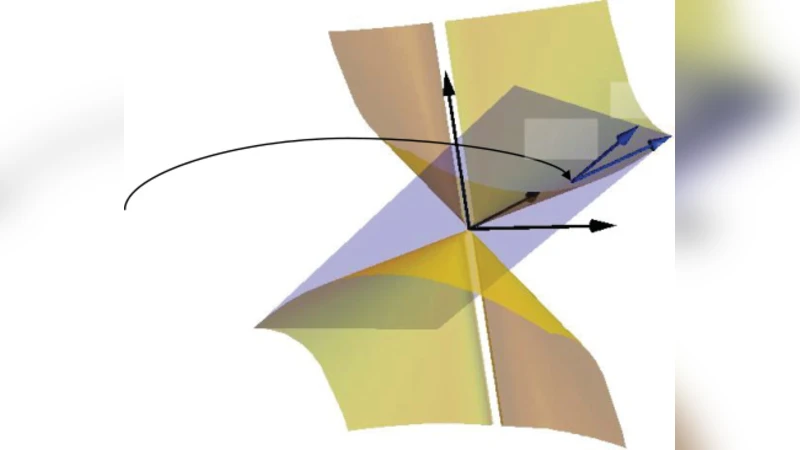

이 논문은 비볼록 최적화 문제를 기존의 “핸드크래프트 기반” 접근법과 대비되는 새로운 “교란 가능한 그래디언트 기반(perturbable gradient basis, PGB)” 프레임워크로 재구성한다. 핵심 가정은 (1) 모델 파라미터 공간이 충분히 매끄럽고, (2) 손실 함수가 거의 모든 점에서 미분 가능하며, (3) PGB가 충분히 풍부해 모든 가능한 방향을 근사할 수 있다는 것이다. 이러한 가정 하에 저자들은 라그랑주 승수와 미분 가능성 이론을 결합해, 임의의 지역 최소점 x에서 ∇L(x)=0이면 해당 점이 PGB 모델의 전역 최소값을 달성한다는 정리를 도출한다. 증명 과정에서 사용된 기하학적 직관은 “손실 표면의 등고선이 PGB에 의해 완전히 펼쳐진다”는 개념으로, 이는 기존의 “산악 지형” 비유와는 달리 손실이 지역적으로 평탄화된다고 보는 새로운 시각을 제공한다.

논문의 강점은 (i) 기존의 “over‑parameterization → global optimum” 결과를 일반화하여, 파라미터 수가 충분히 크지 않더라도 PGB가 존재하면 동일한 전역 최적 보장을 얻을 수 있다는 점, (ii) 잔차 연결(skip‑connection) 구조와 같은 현대 딥러닝 아키텍처에 대한 특수한 경우를 자연스럽게 포함한다는 점이다. 특히, 잔차 네트워크의 경우 PGB가 잔차 경로를 통해 추가적인 자유도를 제공함으로써 기존의 “잔차가 손실을 보정한다”는 직관을 수학적으로 뒷받침한다.

하지만 몇 가지 제한점도 존재한다. 첫째, PGB의 존재와 구축 방법이 실제 모델에 어떻게 구현되는지 구체적인 알고리즘이 제시되지 않는다. 논문은 “이론적으로 존재한다”는 주장에 머물며, 실제 학습 과정에서 PGB를 어떻게 추출하거나 근사할지에 대한 실험적 검증이 부족하다. 둘째, 가정 (2)인 거의 모든 점에서의 미분 가능성은 ReLU와 같이 비연속적인 활성함수를 사용하는 현대 네트워크에 직접 적용하기 어려울 수 있다. 저자는 이를 “미분 가능한 근사”로 회피하지만, 이는 실제 손실 표면의 비볼록성을 완전히 설명하지 못한다는 비판을 받을 수 있다. 셋째, “핸드크래프트 기반보다 PGB가 우선되지 않을 경우”라는 예외 조건이 모호하게 기술되어 있어, 실제 연구자가 어떤 상황에서 이 예외가 발생하는지 판단하기 어렵다.

결과적으로 이 논문은 비볼록 최적화에 대한 새로운 이론적 시각을 제공하고, 기존의 과잉 파라미터화 이론을 일반화하는 데 기여했지만, 실용적인 구현 방안과 실험적 검증이 부족한 점이 향후 연구 과제로 남는다.

댓글 및 학술 토론

Loading comments...

의견 남기기