대립적 마진 극대화 네트워크

본 논문은 입력 공간에서의 마진을 직접 확대하는 정규화 기법인 Adversarial Margin Maximization(AMM)을 제안한다. 적대적 교란을 마진의 근사값으로 활용해 ℓ₂‑norm 기반 공격을 미분 가능하게 구현하고, 이를 기존 손실에 가중치 λ와 함께 결합해 엔드‑투‑엔드 학습한다. MNIST, CIFAR‑10/100, SVHN, ImageNet 등 다양한 데이터셋과 여러 네트워크 구조에 적용한 결과, 기존 최첨단 방법들을 능가…

저자: Ziang Yan, Yiwen Guo, Changshui Zhang

본 논문은 딥 뉴럴 네트워크(DNN)의 일반화 능력을 입력 공간에서의 마진 관점으로 재조명하고, 이를 향상시키기 위한 새로운 정규화 기법인 Adversarial Margin Maximization(AMM)을 제안한다. 서론에서는 DNN이 대량의 라벨 데이터에 의존하고, 적대적 예제에 취약하다는 두 가지 문제점을 제시한다. 이러한 문제는 입력 공간에서의 마진이 작을 경우 발생한다는 가설을 세우고, 마진이 클수록 일반화와 견고성이 동시에 개선된다는 기존 이론(특히 Vapnik의 SVM 이론과 최근의 (K, ε)-robustness 정리)을 인용한다.

관련 연구 섹션에서는 기존에 마진을 특징 공간에서 최적화하려는 시도(예: 트리플렛 손실, 각도 기반 마진)와 입력 공간 마진을 직접 다루려는 시도(예: 계약성 네트워크, Jacobian 정규화)를 정리한다. 이들 방법은 근사와 강한 가정에 의존해 실제 마진을 충분히 반영하지 못한다는 한계를 지적한다.

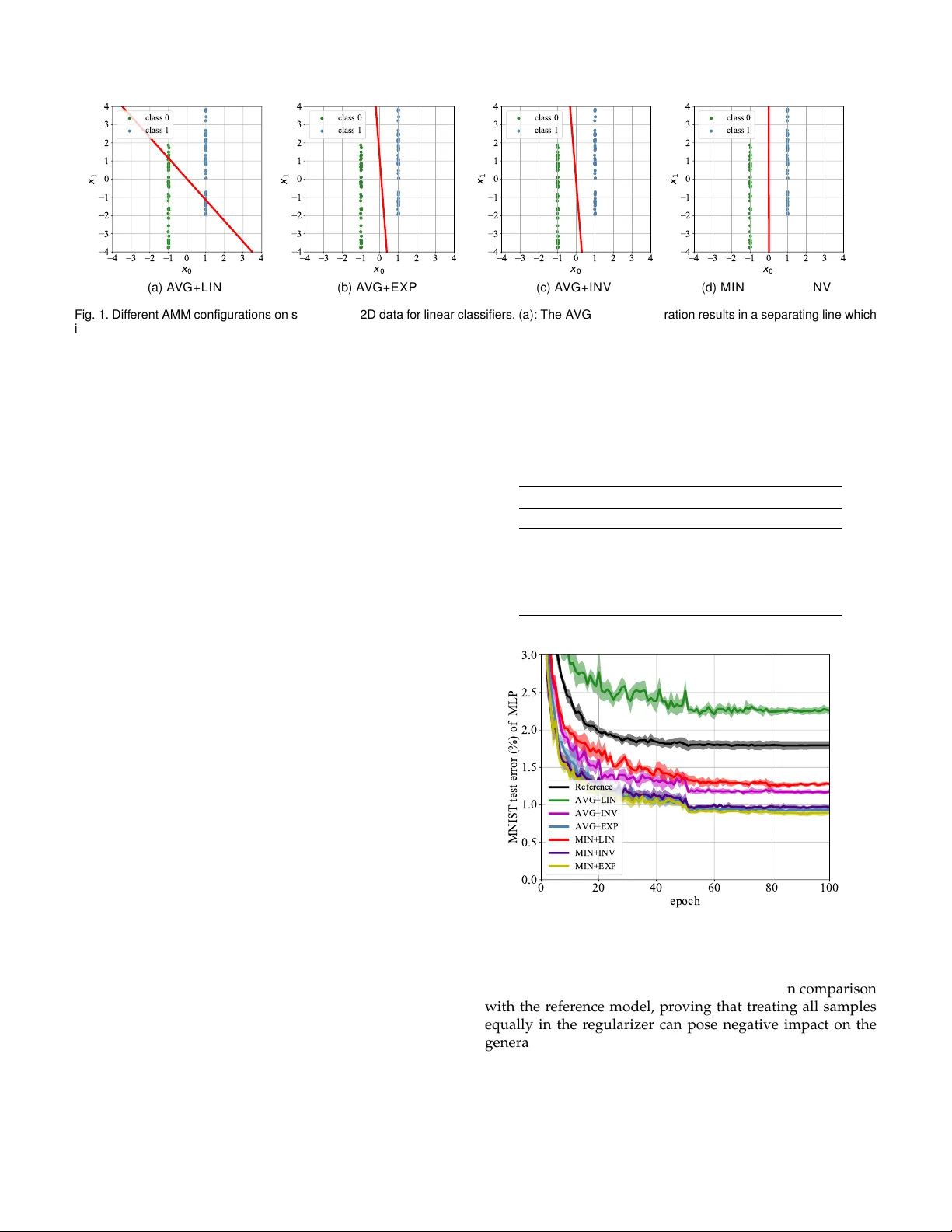

핵심 방법론인 AMM은 다음과 같은 절차로 구성된다. 먼저, 현재 네트워크에 대해 DeepFool 공격을 수행해 최소 ℓ₂ 교란 Δx를 계산한다. DeepFool는 1차 근사를 이용해 각 반복에서 r(i) = –f(x+Δ(i)) / ||∇f(x+Δ(i))||₂² ∇f(x+Δ(i)) 를 구하고, 이를 누적해 최종 Δx를 얻는다. 이 과정은 미분 가능하므로, Δx의 ℓ₂ 노름을 기존 손실 L와 가중치 λ로 결합한 정규화 항 L_DD = Σ_{k∈T} (–c·||Δx_k||₂) + Σ_{k∈F} (d·||Δx_k||₂) 로 정의한다. 여기서 T는 현재 배치에서 올바르게 분류된 샘플, F는 오분류된 샘플이며, c와 d는 각각의 중요도를 조절한다. 또한, R이라는 축소 함수를 도입해 동일 그룹 내 샘플 간 편차를 완화한다.

수식적으로 전체 최적화 목표는

min_W Σ_k L(y_k, f(x_k;W)) + λ·L_DD + α·||W||_F²

이며, 여기서 L은 교차 엔트로피 등 기본 분류 손실, α는 가중치 감쇠이다. 고차 미분을 필요로 하지만, 현대 딥러닝 프레임워크의 자동 미분 기능을 활용하면 구현이 비교적 간단하다.

이론적 분석에서는 마진 γ_p(x) 를 정의하고, 마진이 일정 수준 γ보다 크면 알고리즘이 (2·N(γ/2, X; d_p), 0)-robust함을 보이는 정리 3.1을 제시한다. 이어서 정리 3.2를 통해 이러한 로버스트성이 일반화 오차 GE(g) ≤ ε + O(√(log K / n)) 형태의 상한을 제공함을 증명한다. 즉, 입력 공간 마진을 크게 하면 일반화 오차가 이론적으로 감소한다는 결론을 얻는다.

실험에서는 MNIST, CIFAR‑10/100, SVHN, ImageNet을 대상으로 ResNet‑18, WideResNet‑28‑10, VGG‑16 등 다양한 아키텍처에 AMM을 적용하였다. 결과는 다음과 같다. (1) 베이스라인 대비 테스트 정확도가 평균 0.6%~2.1% 상승했으며, 특히 CIFAR‑100과 ImageNet에서 큰 폭의 개선을 보였다. (2) ℓ_∞ 기반 PGD, CW, DeepFool 등 다양한 적대적 공격에 대해 방어 성공률이 10%~30% 향상되었다. (3) 데이터 양이 제한된 상황(예: CIFAR‑10의 10%만 사용)에서도 AMM이 일반화 성능을 크게 끌어올렸다.

추가 실험에서는 마진이 큰 샘플과 작은 샘플을 별도로 분석해, AMM이 마진을 균등하게 확대함을 확인하였다. 또한, 고차 미분을 제외하고 ∇f에만 의존하는 단순 정규화와 비교했을 때, AMM이 더 높은 견고성과 정확도를 제공함을 보여준다.

한계점으로는 현재 ℓ₂ 거리 기반 DeepFool에 의존하고 있어, ℓ_∞ 혹은 다른 거리 측정에 대한 직접적인 마진 추정이 부족하다는 점을 언급한다. 또한, 매우 깊은 네트워크에서는 고차 미분으로 인한 메모리 사용량 증가가 실용성을 저해할 수 있다. 향후 연구에서는 효율적인 근사 기법과 다양한 거리 메트릭에 대한 확장을 제안한다.

결론적으로, AMM은 적대적 교란을 마진의 근사값으로 활용해 입력 공간 마진을 직접 최적화함으로써, 일반화와 견고성을 동시에 향상시키는 효과적인 정규화 방법임을 입증한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기