커버리지와 견고성 사이의 제한된 상관관계

본 연구는 100개의 딥 뉴럴 네트워크와 25가지 메트릭을 활용해 커버리지 기준과 모델 견고성 사이의 관계를 실증적으로 조사하였다. 실험 결과, 커버리지를 높이는 것이 반드시 견고성을 향상시키지는 않으며, 여러 커버리지 기준 간에도 강한 상관관계가 없음을 확인하였다.

저자: Yizhen Dong, Peixin Zhang, Jingyi Wang

본 논문은 딥 뉴럴 네트워크(DNN)의 테스트 커버리지와 모델 견고성 사이의 관계를 체계적으로 조사한 최초의 대규모 실증 연구이다. 연구 배경으로, DNN이 자율주행, 얼굴 인식, 악성코드 탐지 등 안전‑중요 분야에 널리 적용되면서, 적대적 공격에 취약하다는 사실이 알려졌다. 소프트웨어 엔지니어링 분야에서는 코드 커버리지를 활용한 테스트가 버그 발견과 품질 향상에 효과적이라는 경험을 바탕으로, DNN에도 Neuron Coverage, DeepGauge, MC/DC, Surprise Adequacy 등 다양한 커버리지 기준을 도입하였다. 그러나 이러한 기준이 실제로 모델의 견고성을 향상시키는지에 대한 검증은 제한된 실험과 모델에 국한돼 있었다.

연구진은 이 공백을 메우기 위해 두 가지 데이터셋(MNIST, CIFAR‑10)과 네 가지 대표적인 아키텍처(LeNet, VGG, GoogLeNet, ResNet)를 조합해 25개의 시드 모델을 각각 4번씩 학습, 총 100개의 원본 모델을 구축하였다. 각 모델에 대해 FGSM, JSMA, C&W 세 가지 최신 적대적 공격을 적용하고, 공격 파라미터를 다양하게 변형해 3,000여 개의 적대적 샘플을 생성하였다. 이 샘플들을 원본 학습 데이터에 추가해 재학습을 수행함으로써, 원본 모델과 재학습 모델(총 75개) 사이의 성능 변화를 관찰했다.

커버리지 측정은 다음 8가지 기준을 사용했다. 1) Neuron Coverage (활성화된 뉴런 비율), 2) DeepGauge‑k‑section (각 뉴런의 활성화 범위를 k 구간으로 나누어 커버 여부 판단), 3) Top‑k Neuron Coverage (TKNC, 각 레이어에서 상위 k개의 뉴런이 최소 한 번이라도 활성화), 4) Top‑k Neuron Pattern (TKNP, 레이어별 상위 k 뉴런의 순서 패턴), 5) Surprise Adequacy – Kernel Density Estimation, 6) Surprise Adequacy – Euclidean Distance, 7) MC/DC 변형, 8) 기타 변형 지표.

견고성 평가는 두 가지 메트릭으로 정의했다. 첫 번째는 전역 Lipschitz 상수로, 모델 출력이 입력 변화에 얼마나 민감한지를 수치화한다. 두 번째는 CLEVER 점수로, 공격‑독립적인 견고성 추정값이며, 입력 주변에서의 최악 Lipschitz 상수를 샘플링 기반으로 추정한다. 추가로, 공격 성공률, 평균 L₂/ L∞ 왜곡량, 방어 기법 적용 후 정확도 회복률 등 15개의 부가 메트릭을 수집했다.

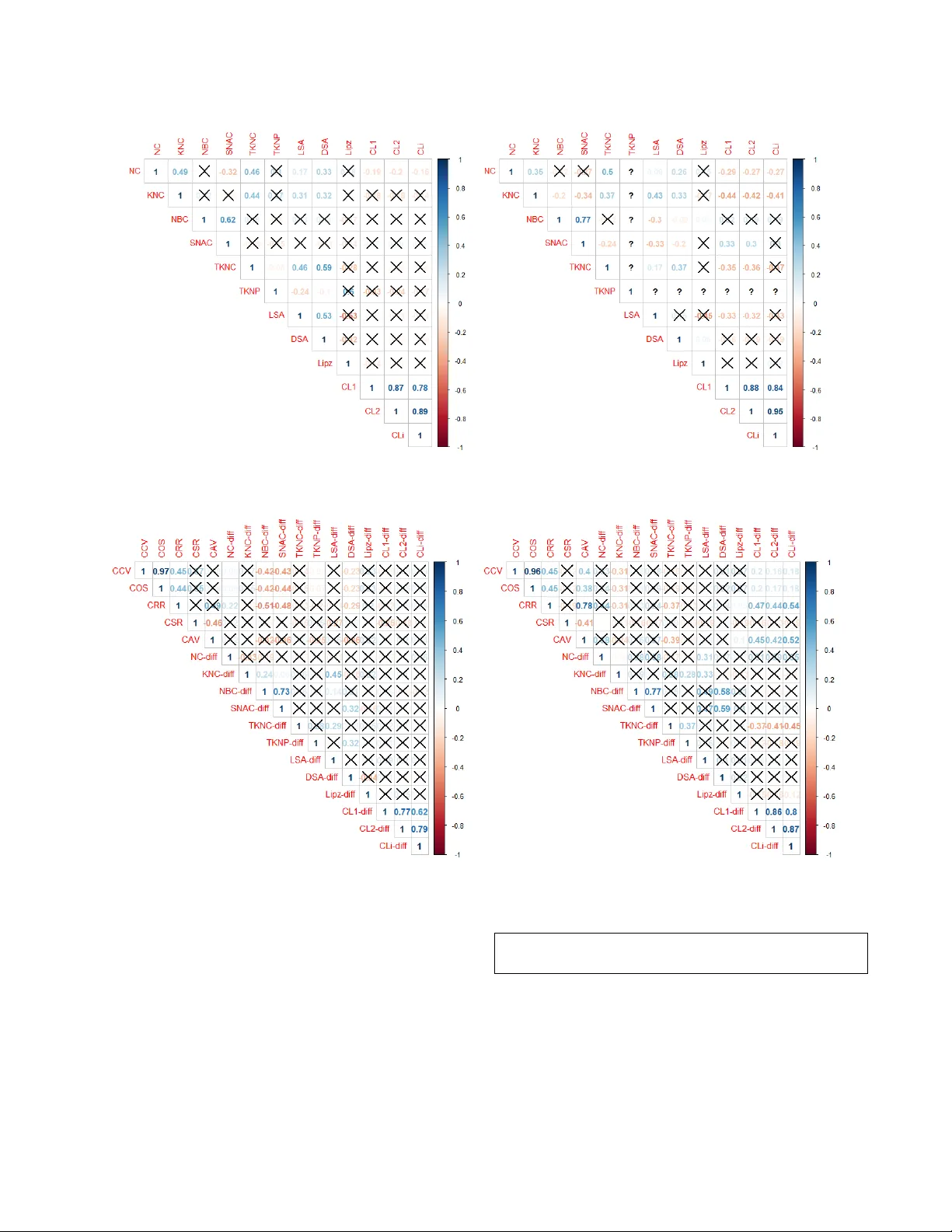

모든 메트릭 간 상관관계는 Kendall’s τ 순위 상관계수를 이용해 분석했으며, 주요 발견은 다음과 같다. (1) 커버리지와 견고성 사이의 상관계수는 대부분 0.1 이하로 매우 낮았다. 즉, 높은 Neuron Coverage나 DeepGauge‑k‑section을 달성해도 Lipschitz 상수 감소나 CLEVER 점수 상승과 같은 견고성 향상이 보장되지 않았다. (2) 서로 다른 커버리지 기준 간에도 일관된 상관관계가 없었다. 예를 들어 Neuron Coverage와 TKNC, TKNP, Surprise Adequacy 간 τ값은 0.03~0.07 수준에 머물렀다. (3) 재학습 후 커버리지 증가량과 견고성 개선량 사이에도 유의미한 연관성이 없었다. 일부 경우에는 커버리지는 크게 상승했지만 견고성 메트릭은 오히려 악화되는 현상이 관찰되었다. (4) 공격/방어 메트릭과 커버리지 간에도 뚜렷한 상관관계가 발견되지 않아, 기존 테스트 커버리지가 실제 보안·안전 요구사항을 충족시키는지 의문이 제기된다.

연구진은 이러한 결과를 바탕으로 몇 가지 실용적 제언을 제시한다. 첫째, 현재 DNN 테스트는 코드 커버리지에서 차용한 “활성화 빈도” 중심이 아니라, “입력 변동에 대한 출력 민감도”를 직접 측정하는 메트릭을 도입해야 한다. 둘째, 테스트 케이스 생성 시 단순히 뉴런을 활성화시키는 것이 아니라, 적대적 공격이 목표로 하는 경계 영역을 목표로 하는 전략이 필요하다. 셋째, 커버리지와 견고성 사이의 관계를 평가하려면 다중 메트릭을 동시에 고려하는 복합 평가 프레임워크가 요구된다.

또한, 논문은 DRT‑est(Deep Robustness Testing)라는 자체 툴킷을 공개했다. DRT‑est는 8가지 커버리지, 2가지 견고성, 15가지 공격·방어 메트릭을 자동으로 계산하고, GPU 기반 병렬 처리를 지원해 4,150 GPU 시간 이상의 연산을 효율적으로 수행한다. 제공된 100개의 모델, 3,000여 개의 적대적 샘플, 그리고 메트릭 결과는 향후 새로운 테스트 기법이나 방어 메커니즘을 비교·평가하는 표준 벤치마크로 활용될 수 있다.

결론적으로, 이 연구는 대규모 실험을 통해 “테스트 커버리지를 높이면 견고성이 향상된다”는 일반적인 믿음에 강력한 반증을 제시한다. 커버리지와 견고성은 서로 독립적인 특성일 가능성이 높으며, 따라서 DNN 테스트 연구는 기존 코드 커버리지 패러다임을 넘어 새로운 평가 지표와 테스트 전략을 모색해야 함을 강조한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기