초고속 대규모 신경망 학습을 위한 PIII 클러스터 구현

본 논문은 196개의 Pentium III 프로세서로 구성된 Linux 기반 클러스터 “Bunyip”에서 1.73 백만 개 파라미터를 가진 신경망을 9 백만 개의 일본어 문자 데이터로 학습시켜, 단일 정밀도에서 평균 163.3 GFlops/s, 가격 대비 성능 92.4 ¢/MFlops/s를 달성한 방법을 제시한다. 핵심은 SSE 기반 SGEMM 커널 “Emmerald”와 데이터 분할에 의한 손쉬운 병렬화이다.

저자: Douglas Aberdeen, Jonathan Baxter, Robert Edwards

**1. 서론**

인공신경망은 파라미터 수와 학습 데이터 양이 증가할수록 표현력이 향상된다. 특히 음성, 얼굴, 웹 페이지 등 대규모 데이터가 존재하는 분야에서는 수백만~수천만 파라미터를 가진 초대형 네트워크(ULSNN)가 필요하지만, 반복적인 경사하강법은 연산량이 방대해 실용적인 학습이 어려웠다. 본 논문은 이러한 병목을 저비용 COTS 기반 클러스터와 고성능 SGEMM 커널을 이용해 극복하고자 한다.

**2. Bunyip 클러스터 하드웨어**

- 구성: 98대 듀얼 550 MHz Pentium III PC(총 196코어), 각 노드 384 MB RAM, 13 GB IDE 디스크, 3×100 Mb/s NIC.

- 네트워크 토폴로지: 4개의 정점으로 이루어진 사면체 형태, 각 정점에 24노드, 정점 간 48포트 HP Procurve 4000 스위치(3.8 Gb/s) 4개로 연결, 총 양측 대역폭 15.2 Gb/s.

- 추가 장비: 2대 서버(부팅 ROM, 모니터, 키보드 포함)와 4포트 Gigabit 스위치, 핫스페어 2대.

- 비용: 노드 $125,636, 스위치·서버·케이블·인건비 등 포함 총 $150,913(≈AU$253,000).

**3. Emmerald: SIMD SGEMM**

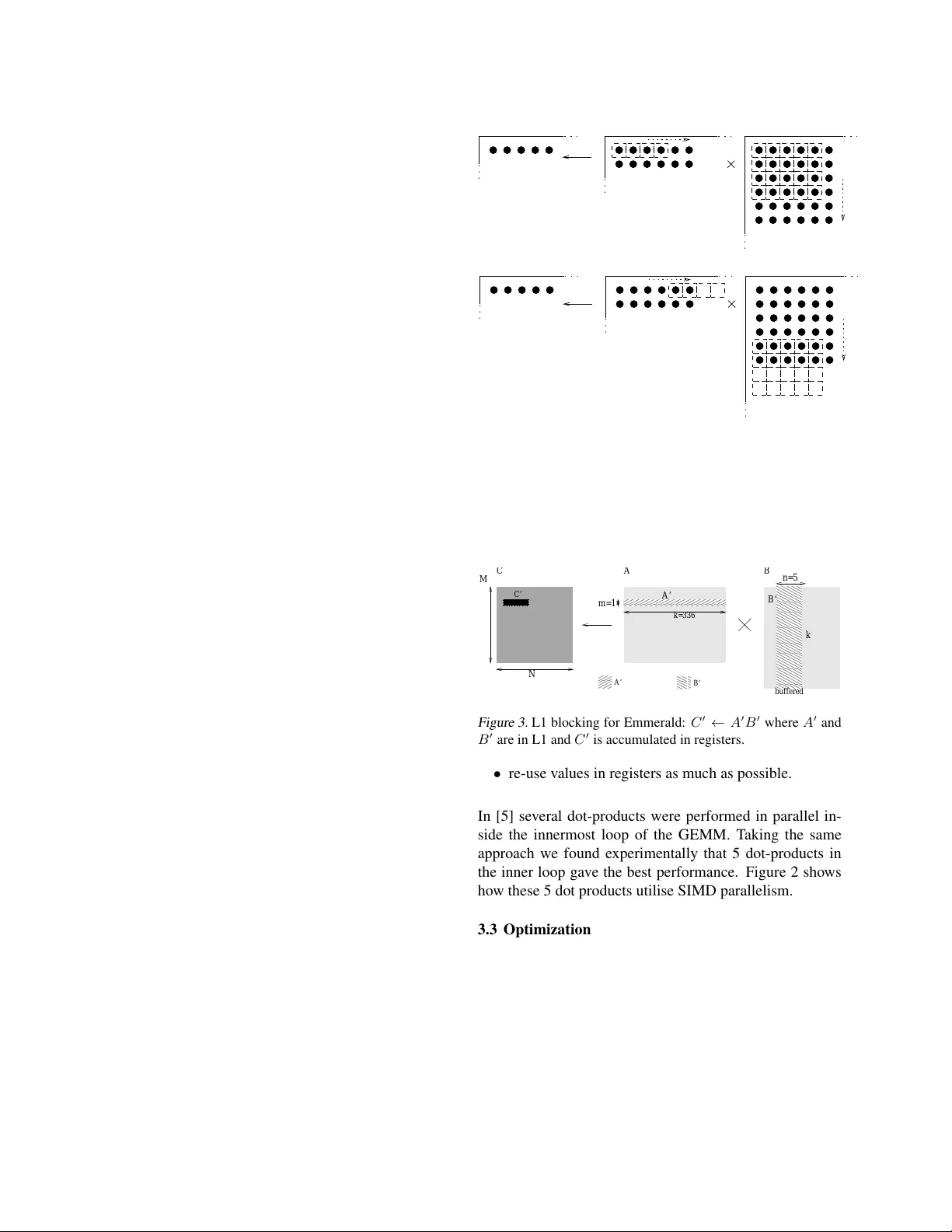

Emmerald은 Pentium III의 SSE 명령어를 활용해 4‑float 레지스터를 동시에 연산한다. 주요 최적화는 다음과 같다.

- **L1 차단**: 행렬을 L1 캐시 안에 맞게 블록화하여 내부 루프가 캐시 내 데이터만 사용하도록 함.

- **레지스터 재사용 및 언롤링**: 5개의 독립적인 내적을 동시에 수행해 레지스터에 결과를 누적, 루프를 완전 언롤링해 인스트럭션 캐시 오버플로 방지.

- **프리패칭 및 재버퍼링**: B 행렬을 L1에 미리 버퍼링하고, A 행렬은 프리패치 명령어로 접근 시점을 맞춤.

- **L2 차단**: 메인 메모리까지 확장 가능한 블록 크기 설계.

성능 측정 결과, 550 MHz PIII에서 피크 1,090 MFlops/s, 평균 1.69 × 클럭 속도, ATLAS 대비 2.09 × 빠른 성능을 보였다.

**4. 신경망 모델 및 학습**

- 구조: 입력‑숨김‑출력 3계층, 활성화 함수 tanh, 파라미터 총 1.73 M.

- 오류 함수: 평균 제곱오차(E) 최소화.

- 그래디언트 계산: 행렬‑행렬 곱과 원소‑원소 곱으로 변환, 핵심 연산을 Emmerald SGEMM에 위임. 전체 연산량은 52.2 TFlops.

- 최적화 기법: Polak‑Ribiére 공액기울기법, 지수 스텝 사이즈, 2차 보간을 이용한 라인 서치, 그래디언트 부호만으로도 충분히 최대값을 찾을 수 있어 데이터 샘플 수를 크게 줄임.

**5. 병렬화 전략**

훈련 데이터(9 M 패턴)를 슬레이브 노드에 균등 분할, 각 노드가 로컬 그래디언트와 오류를 계산. 마스터 노드가 파라미터를 전파하고, 각 슬레이브의 결과를 집계한다. 전송량은 파라미터 행렬(≈1.7 M)와 그래디언트(동일 규모) 정도에 불과해, 100 Mb/s 이중 NIC 구성에서도 충분히 처리 가능하다.

**6. 통신 및 확장성**

통신 비용은 파라미터 전송과 그래디언트 집계 두 단계로 제한된다. 실험에서는 네트워크가 병목이 되지 않았으며, 부하가 없는 구간에 163.3 GFlops/s를 4시간 지속했다. 이는 56시간 52분 동안 총 31.2 PFlops 연산을 수행한 결과이며, 메모리 사용량은 32.37 GB에 머물렀다.

**7. 결과 및 비교**

- 단정밀도(SGEMM) 평균 성능: 163.3 GFlops/s, 가격‑성능 92.4 ¢/MFlops/s.

- 이중정밀도(ATLAS DGEMM) 평균 성능: 70 MFlops/s, 가격‑성능 $2.16/MFlops/s.

- 전체 시스템 비용 대비 성능이 기존 상용 솔루션보다 20배 이상 우수함을 입증.

**8. 결론**

저비용 COTS 하드웨어와 맞춤형 SIMD SGEMM을 결합하면, 수백 코어 수준의 클러스터에서도 초대형 신경망을 실용적인 시간 안에 학습시킬 수 있다. 데이터 분할 기반의 간단한 병렬화가 통신 오버헤드를 최소화하면서 확장성을 보장한다. 향후 GPU, 다중코어 CPU, 클라우드 환경에서도 유사한 설계 원칙을 적용해 더욱 높은 성능·가격 효율을 달성할 수 있을 것으로 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기