곱셈 없는 컨볼루션을 위한 양극 형태학 신경망

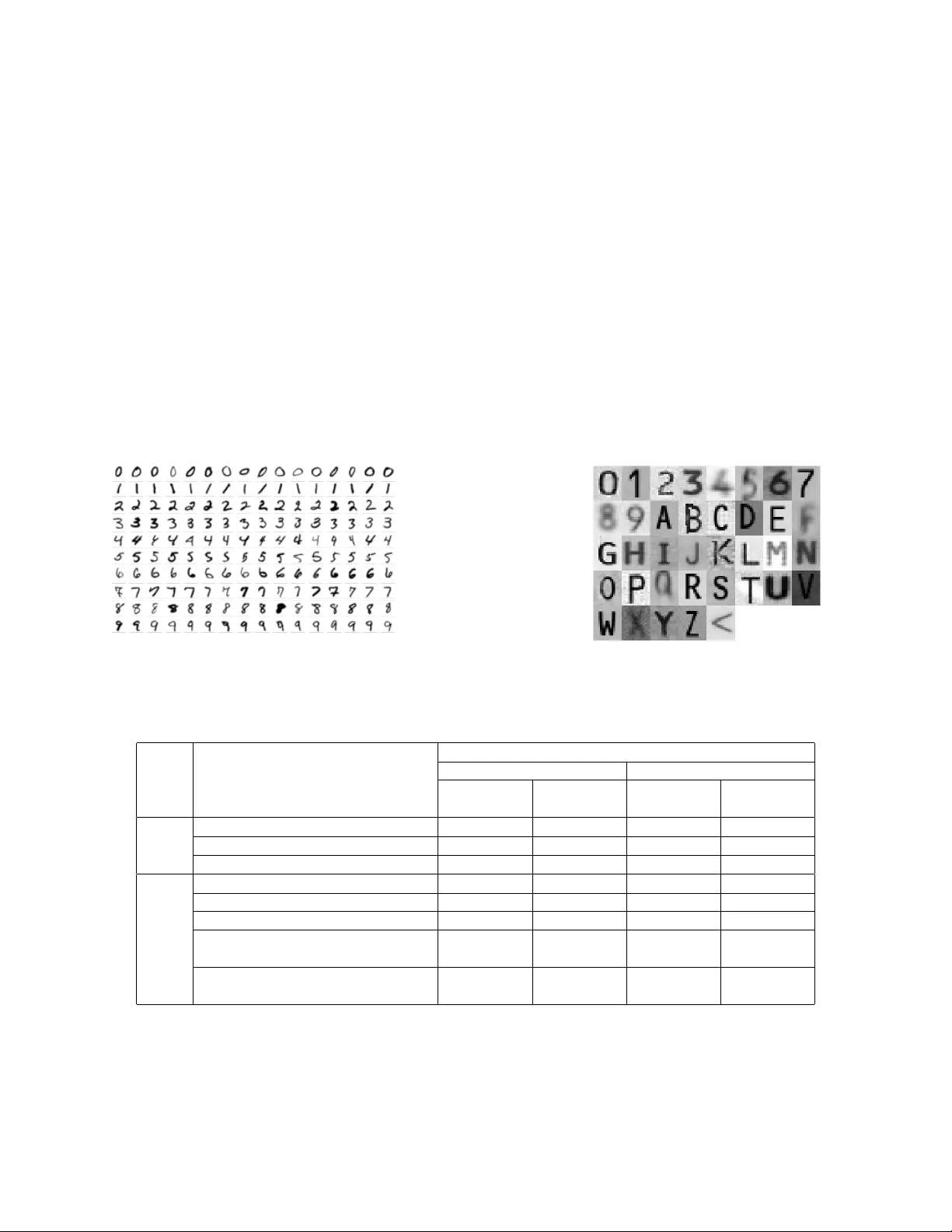

본 논문은 곱셈 대신 덧셈·뺄셈·최대값 연산과 로그·지수 활성화 함수를 이용하는 양극 형태학 신경망(BMNN) 구조를 제안한다. 기존 형태학 신경망보다 클래식 뉴런에 가까운 근사성을 가지며, 레이어별 변환 후 표준 경사하강법으로 미세조정하는 두 단계 학습 방식을 제시한다. MNIST와 MRZ 문자 인식 실험에서 컨볼루션 레이어만 변환해도 정확도 손실이 거의 없으며, 연산 지연 감소와 전력 효율 향상이 기대된다.

저자: Elena Limonova, Daniil Matveev, Dmitry Nikolaev

본 논문은 곱셈 연산을 완전히 배제하고, 덧셈·뺄셈·최대값 연산과 로그·지수 활성화 함수를 이용한 새로운 형태학 신경망 모델인 양극 형태학 뉴런(Bipolar Morphological Neuron, BMN)과 이를 기반으로 하는 양극 형태학 레이어(Bipolar Morphological Layer, BM layer)를 제안한다. 기존 형태학 신경망은 주로 단일 레이어 퍼셉트론 형태였으며, 곱셈 대신 최대·최소 연산을 사용했지만, 클래식 뉴런과의 근사성이 낮아 인식 성능이 제한적이었다. 저자들은 BMN을 설계함으로써 클래식 뉴런의 선형 결합 \(\sum_i x_i w_i\)을 \(\exp(\max_j(\ln x_j + \ln w_j))\) 형태로 근사하고, 이를 네트워크 레이어 전체에 적용할 수 있도록 구조화하였다.

BM 레이어는 입력 벡터 \(X\)와 가중치 행렬 \(V\)를 각각 양극(양·음) 두 경로로 분리한다. 각 경로는 ReLU를 통해 비음성 값을 확보한 뒤 로그 변환을 수행하고, 로그값과 가중치 로그값(\(v_{kj} = \ln|w_j|\))을 합산한다. 그 후 최대값 연산을 적용해 가장 큰 합을 선택하고, 최종적으로 지수 함수를 적용해 원래 스케일로 복원한다. 수식적으로는

\

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기