동적 제어 순환 신경망으로 물리 시스템 예측

초록

본 논문은 미분 방정식으로 기술되는 동적 시스템을 모델링하기 위해, 학습 가능한 스킵 연결과 Lyapunov 안정성 기반 정규화를 결합한 Dynamically Controlled Recurrent Neural Network(DCRNN)를 제안한다. DCRNN은 숨겨진 상태의 고유값을 원하는 위치에 배치함으로써 내부 제어기를 구현하고, 혼돈 시스템 예측 실험에서 기존 LSTM 대비 평균 제곱 오차를 약 80 % 감소시켰다.

상세 분석

DCRNN은 기존 RNN·LSTM 구조의 한계를 정확히 짚어낸다. 물리적 동적 시스템은 현재 상태, 입력, 초기 조건만으로 다음 상태가 결정되는 일계 시스템이며, 장기 메모리 셀을 갖는 LSTM은 불필요한 기억 메커니즘을 학습하려다 오히려 수렴성을 해친다. 이를 해결하기 위해 저자들은 두 가지 핵심 설계를 도입한다. 첫째, 과거 k 단계의 숨겨진 상태 hₜ₋ᵢ에 대해 가중치 αᵢ를 학습 가능한 대각 행렬로 두는 스킵 연결을 추가한다. 이 연결은 k=0이면 순수 RNN, k=1이고 α₁=1이면 기존 LSTM의 constant error carousel와 동등하게 되며, α₁을 forget gate fₜ 로 두면 LSTM의 표준 구조와도 일치한다. 둘째, 숨겨진 상태를 시스템의 상태 변수로 간주하고 Lyapunov 선형화 방법을 적용해 선형 근사 모델 A를 도출한다. 선형화된 시스템의 고유값 λ(A)가 단위 원 안에 머물도록 하는 정규화 항 C_λ을 손실 함수에 가중치 β와 함께 추가함으로써, 학습 과정에서 자동으로 고유값을 원하는 위치(보통 원점에 가깝게)로 끌어당긴다. 이는 제어 이론에서 “내부 제어기” 역할을 수행하며, 숨겨진 상태가 발산하거나 포화되는 현상을 방지한다.

정규화 항은 Euclidean norm을 이용해 목표 고유값 λ*와 현재 고유값 λ(α) 사이의 거리 제곱합을 최소화한다. 고유값 계산 복잡도 O(m²) (여기서 m=n·k) 를 감안해 실험에서는 β=1 로 설정하고, 학습률을 충분히 작게 잡아 매 iteration마다 고유값이 급격히 변하지 않도록 설계하였다. 또한, BPTT를 적용할 때 스킵 연결으로 인해 연쇄법칙이 k번 중첩되어 복잡도가 급증함을 인지하고, 보조 자료에서 효율적인 구현 방식을 제시한다.

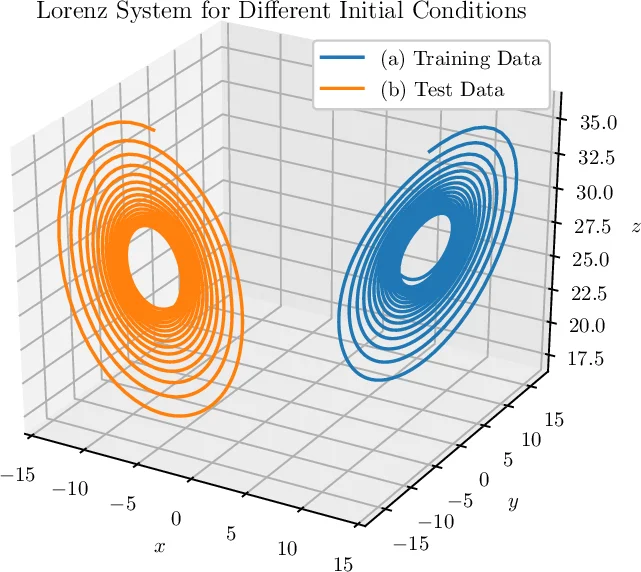

실험은 혼돈 로렌즈 시스템을 예시로 사용했으며, 100번의 무작위 초기화·시드 조건에서 DCRNN이 모두 LSTM을 능가했다. 평균 제곱 오차 감소율은 80 % ± 3 %로 보고되었으며, 이는 고유값 제어가 숨겨진 상태의 안정성을 크게 향상시켜 장기 예측 정확도를 끌어올렸음을 의미한다. 논문은 또한 DCRNN이 vanilla RNN의 일반화이며, 파라미터 k와 αᵢ를 조정하면 LSTM·GRU·CE‑RNN 등 다양한 변형으로 변환 가능함을 강조한다.

전체적으로 이 연구는 딥러닝 모델에 제어 이론을 직접 삽입함으로써 물리 기반 시계열 예측에 새로운 패러다임을 제시한다. 학습 가능한 스킵 연결과 Lyapunov 기반 고유값 정규화라는 두 축을 결합한 설계는 모델의 해석 가능성을 높이고, 수치적 안정성을 보장한다는 점에서 기존 메모리 중심 접근법과 차별화된다. 다만 고유값 계산 비용, 스킵 연결 수 k에 따른 BPTT 복잡도, 그리고 목표 고유값 선택에 대한 민감도 등 실용적 한계도 존재한다. 향후 연구에서는 효율적인 고유값 근사, 적응형 k 조정, 그리고 비선형 제어 기법과의 통합이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기