상관 사전으로 강화학습 효율화

초록

본 논문은 이산형 마코프 의사결정 과정(MDP)에서 상태·행동 간의 공간·시간적 상관관계를 베이지안 사전으로 모델링하고, 폴리아-감마(Pólya‑Gamma) 보강을 이용한 변분 추론을 제안한다. 이를 통해 모방학습, 서브골 목표 추출, 시스템 식별, 베이지안 강화학습 등 다양한 의사결정 문제에서 데이터가 적은 상황에서도 기존 독립 사전 대비 예측 정확도가 크게 향상됨을 실험적으로 입증한다.

상세 분석

이 논문은 이산 MDP에서 전이 확률이나 정책을 표현하는 다항분포의 파라미터 벡터들이 서로 독립적인 디리클레 사전으로 모델링되는 기존 접근법의 한계를 지적한다. 실제 환경에서는 상태 간, 행동 간, 혹은 목표 간에 물리적·의미적 유사성이 존재해 전이 다이나믹스와 정책이 공간적으로, 시간적으로 상관관계를 갖는다. 저자들은 이러한 상관구조를 공동 정규분포를 갖는 잠재 변수 ψ에 부여하고, 스틱‑브레이킹 변환을 통해 ψ를 단순히 확률 단순체에 매핑한다. 핵심은 폴리아‑감마(PG) 변수 ω를 도입해 로지스틱 함수와 정규분포 사이의 비공액성을 보강함으로써, 변분 추론 과정에서 닫힌 형태의 업데이트 식을 얻는 것이다. 변분 EM을 통해 하이퍼파라미터(공분산 행렬 Σ의 스케일 및 길이 스케일 등)를 자동 최적화함으로써, 사용자는 사전 설계에 대한 부담을 크게 줄일 수 있다.

알고리즘은 크게 네 단계로 구성된다. 첫째, 관측된 카운트 데이터 X(예: 상태‑행동 쌍에서의 행동 횟수)를 다항분포 형태로 표현한다. 둘째, ψ에 대한 정규 사전 N(μ, Σ)를 설정하고, 스틱‑브레이킹을 통해 p=Π_SB(ψ)로 변환한다. 셋째, PG 보강을 적용해 로그 우도와 정규 사전이 결합된 형태를 얻고, 변분 분포 q(ψ, ω)=∏k N(ψ·k|λ_k, V_k)·∏{c,k} PG(ω_ck|b_ck, w_ck) 로 가정한다. 마지막으로, 좌표 상승법을 이용해 λ_k, V_k, w_ck 등을 반복적으로 업데이트하고, ELBO를 최대화한다. 하이퍼파라미터 μ와 Σ는 변분 EM 단계에서 ELBO의 미분식에 따라 폐쇄형 혹은 수치적 업데이트가 가능하도록 설계되었다.

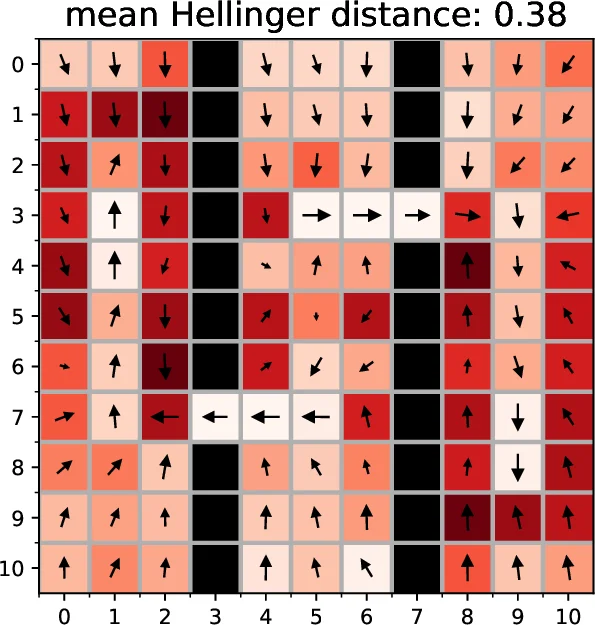

실험에서는 (1) 모방학습에서 전문가 정책을 복원할 때, (2) 서브골 모델링을 통해 복잡한 작업을 여러 단계 목표로 분해할 때, (3) 시스템 식별 시 전이 행렬을 추정할 때, (4) 베이지안 강화학습에서 사전 전이 모델을 활용해 샘플 효율성을 높일 때 각각 기존 독립 디리클레 사전 대비 로그우도와 예측 정확도가 현저히 개선됨을 보였다. 특히 데이터 양이 10배 이하로 감소해도 성능 저하가 미미한 점이 강조된다.

이 접근법의 장점은 (i) 이산 환경에서도 연속형 GP와 유사한 상관 사전 구축이 가능하고, (ii) 변분 추론이 Gibbs 샘플링보다 빠르고 자동화된 하이퍼파라미터 튜닝을 제공한다는 점이다. 반면, (a) 공분산 행렬 Σ의 구조 선택이 모델 성능에 큰 영향을 미치며, (b) 대규모 상태·행동 공간에서는 Σ의 역행렬 계산이 여전히 비용이 될 수 있다. 향후 연구에서는 저차원 임베딩을 통한 스케일링, 비정형 그래프 구조를 반영한 커스텀 커널 설계, 그리고 다에이전트 협업 상황에서의 상관 사전 확장이 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기