깊은 신경망의 사라지는 노드 현상과 학습 어려움

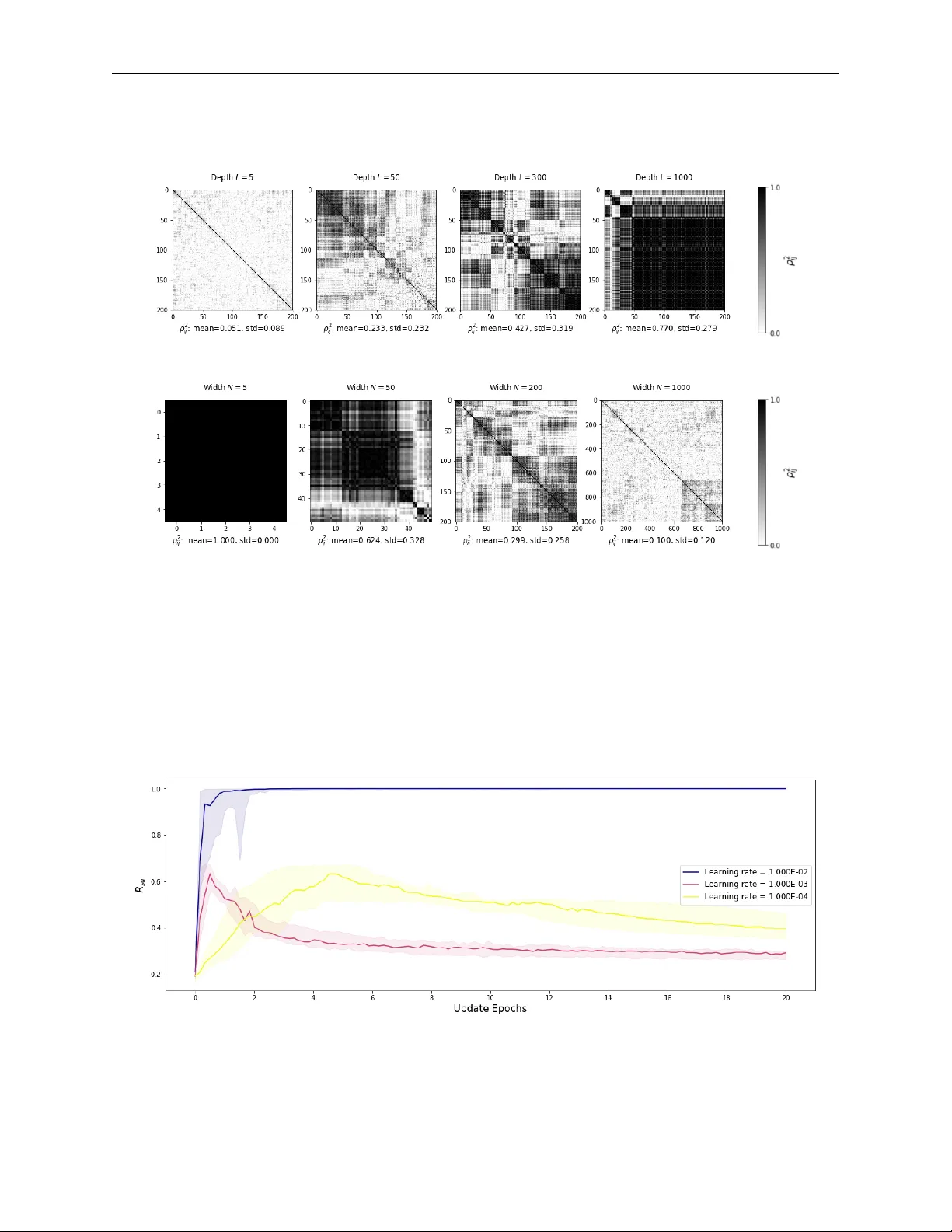

본 논문은 네트워크 깊이가 증가함에 따라 은닉 노드 간 상관관계가 급격히 높아지는 ‘사라지는 노드(vanishing nodes)’ 현상을 제시한다. 이를 정량화하기 위해 제안된 지표인 Vanishing Node Indicator(VNI)는 깊이에 비례하고 폭에 반비례한다. VNI가 1에 도달하면 실질적인 은닉 노드 수가 1로 축소되어 네트워크가 표현력을 상실하고 학습이 불가능해진다. 실험에서는 VNI가 1일 때 기울기는 소멸·폭발하지 않지만 ‘…

저자: Wen-Yu Chang, Tsung-Nan Lin

본 논문은 딥러닝 모델을 설계하고 학습시키는 과정에서 흔히 논의되는 ‘기울기 소실·폭발(vanishing/exploding gradients)’ 문제와는 별도로, 은닉 노드 간 상관관계가 급격히 증가해 실질적인 자유도가 감소하는 ‘사라지는 노드(vanishing nodes)’ 현상을 제시한다.

1. **문제 정의와 직관**

- 네트워크 깊이가 깊어질수록 각 층의 은닉 노드들은 입력 신호를 비선형 변환하면서 점점 비슷한 활성값을 보이게 된다. 두 노드가 상관계수 ρ_ij≈±1이면 하나는 다른 하나의 선형 변형으로 대체 가능하므로 중복성이 발생한다.

- 이러한 중복성이 누적되면 실제로는 하나의 유효 노드만 남게 되며, 이를 ‘네트워크 붕괴(network collapse)’라 부른다.

2. **Vanishing Node Indicator(VNI) 정의**

- VNI R²는 모든 노드 쌍 (i,j)에 대해 ρ_ij²에 가중치 σ_i²σ_j²(노드 분산) 를 곱한 뒤 전체 가중치 합으로 나눈 값이다.

- R²는 1/N(완전 독립)에서 1(완전 상관) 사이를 차지한다. 동일 분산을 가정하면 단순히 ρ_ij²의 평균이 된다.

3. **이론적 근사**

- 입력‑출력 야코비안 J=∏_l D_lW_l (D_l는 활성화 함수 미분 대각행렬) 를 사용해 출력 공분산 C≈σ_x²JJᵀ 를 얻는다.

- VNI는 tr(CCᵀ)/tr(C)² 로 변형 가능하고, 이는 J의 고유값 λ_k 의 1차·2차 모멘트 m₁, m₂ 로 표현된다.

- 기존 평균‑필드 이론 결과를 이용해 m₁=(σ_w²μ₁)^L, m₂=(σ_w²μ₁)^{2L}

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기