인간을 이해하는 AI, 협업과 신뢰의 미래

초록

AI가 일상에 깊숙이 파고들면서 인간과의 협업이 핵심 과제로 떠올랐다. 논문은 인간의 목표·능력·정신 모델을 추정·활용해 사전 지원, 설명 가능한 행동, 신뢰 형성 등을 구현하는 기술적·이론적 도전을 정리하고, 현재 연구 성과와 향후 방향을 제시한다.

상세 분석

이 논문은 인간‑AI 협업을 위한 ‘인간‑인식(Human‑Aware)’ AI 시스템의 핵심 과제를 네 가지 축으로 구분한다. 첫째, 정신 모델(Mental Model) 추정이다. 인간은 상대방의 목표와 능력을 ‘이론‑심리(Theory‑of‑Mind)’ 방식으로 추론하는데, AI가 이를 모방하려면 인간의 목표·제약·능력뿐 아니라 인간이 AI를 어떻게 인식하고 있는지(M_R^h)까지 동시에 모델링해야 한다. 논문은 이를 M_H^r(인간에 대한 AI의 모델)과 M_R^h(인간이 가진 AI 모델)이라는 두 개의 추정 함수로 정의하고, 기존 PDDL 기반 계획에 이 두 모델을 통합하는 아키텍처를 제시한다.

둘째, **사전 지원(Proactive Help)**이다. AI가 M_H^r을 활용해 인간의 목표 달성을 미리 예측하고, 충돌을 피하거나 자원을 효율적으로 배분하는 행동을 계획한다. 이는 전통적인 ‘인간‑보조’ 방식과 달리 인간을 수동적인 입력원으로 보는 것이 아니라, 인간의 의도와 제약을 적극적으로 고려한 ‘협력적’ 행동 생성으로 확장된다.

셋째, **설명 가능성(Explicability)과 설명(Explanation)**이다. AI가 M_R^h와의 차이를 최소화하는 계획 π를 찾는 과정을 ‘설명 가능 행동’이라 부른다. 최적 계획 π*와 인간이 기대하는 계획 π₀ 사이의 거리(d(π,π₀))를 최소화하는 다목적 최적화 문제로 공식화하고, 모델‑기반(전이 비용 명시)과 모델‑프리(학습된 라벨링 함수) 두 접근법을 비교한다. 차이가 너무 커서 행동을 맞추기 어려운 경우, AI는 **모델 조정 설명(Model Reconciliation)**을 제공한다. 여기서는 인간의 모델 M_R^h에 최소한의 수정 E를 제시해 π가 인간에게 설명 가능하도록 만든다. 논문은 이 과정을 메타‑검색 문제로 정의하고, 효율적인 탐색 알고리즘을 제안한다.

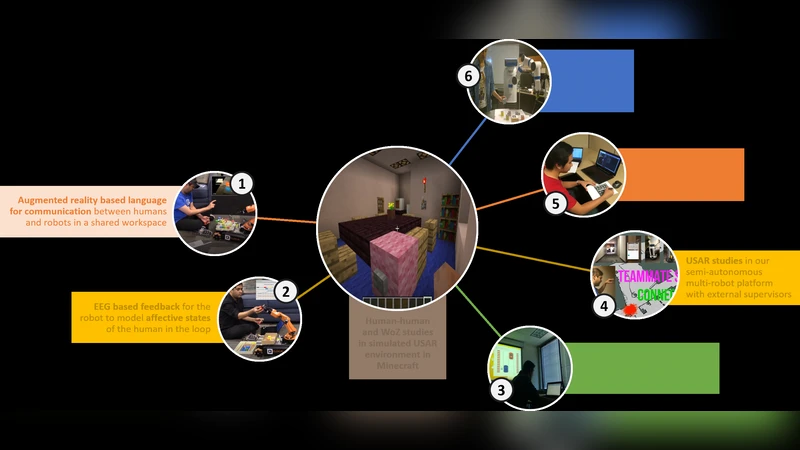

넷째, 모델 획득 및 감정 인식이다. 초기에는 공동 모델을 가정하지만, 실제 상황에서는 인간의 모델이 불완전하거나 변동한다. 저자는 과거 상호작용 로그를 이용한 인과적 모델(PDDL)부터 상관관계 기반의 얕은 모델까지 다양한 학습 스펙트럼을 제시하고, 뇌‑컴퓨터 인터페이스(예: Emotiv 헬멧)와 증강현실(HoloLens) 등을 활용해 인간의 정서·주의 상태를 실시간으로 파악하는 방법을 탐색한다. 이러한 감정 인식은 설명 시점과 방식, 사전 지원의 시기 등을 동적으로 조정하는 데 활용될 수 있다.

전체적으로 논문은 기존 AI 시스템이 ‘인간을 위한 도구’에서 ‘인간과 공동 목표를 공유하는 파트너’로 전환되기 위해서는 아키텍처 전반에 걸친 구조적 변형, 다중 정신 모델의 통합, 설명·신뢰 메커니즘의 정량화, 그리고 윤리·프라이버시 고려가 필수적임을 강조한다. 특히, 인간‑인식 AI가 성공하려면 인지과학, 인간‑컴퓨터 상호작용(HCI), 로보틱스, 윤리학 등 다학제적 협력이 필요하다는 점을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기