계층형 표현 네트워크를 이용한 저비트레이트 음성 QIM 스테가노그래피 탐지

초록

**

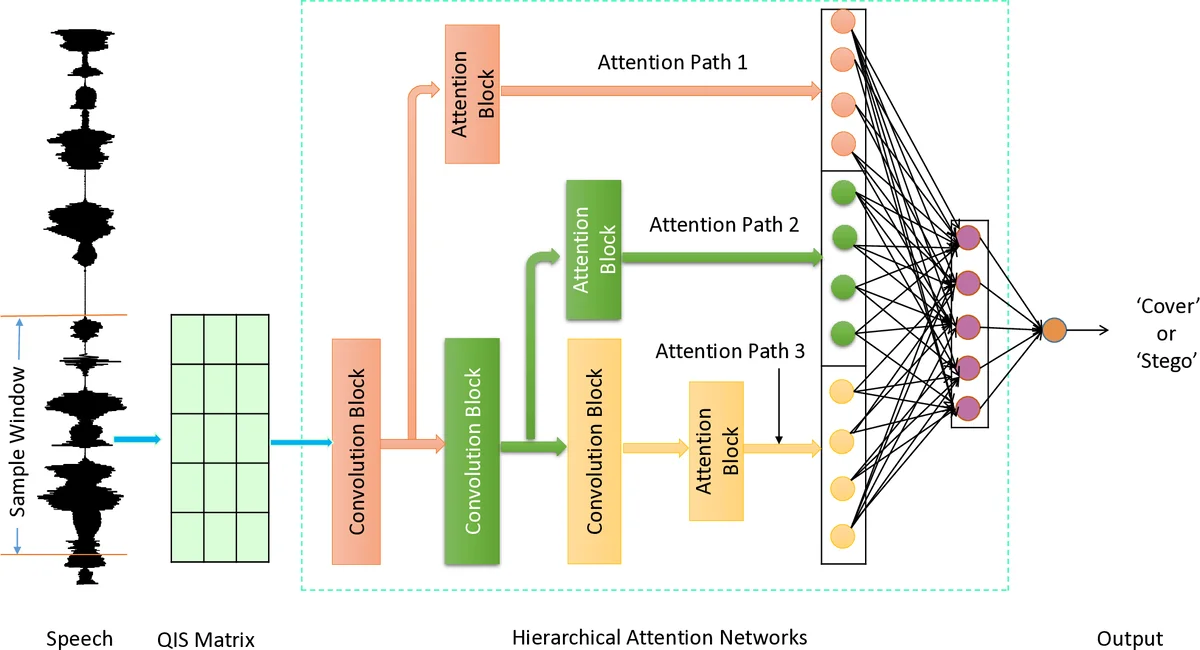

본 논문은 저비트레이트 VoIP 코덱에서 사용되는 양자화 인덱스 변조(QIM) 스테가노그래피를 탐지하기 위해, 음성 프레임의 계층적 구조를 모델링하는 1‑D CNN과 3단계 주의 메커니즘을 결합한 엔드‑투‑엔드 네트워크를 제안한다. 실험 결과, 짧은 구간 및 낮은 삽입 비율에서도 기존 방법들을 능가하며, 연산량과 지연 시간 면에서도 효율성을 보인다.

**

상세 분석

**

이 연구는 VoIP 환경에서 저비트레이트 코덱(G.729, G.723.1 등)이 사용될 때 발생하는 QIM 기반 스테가노그래피를 탐지하는 새로운 접근법을 제시한다. 기존의 스테가노그래피 탐지 기법은 주로 코드워드 간의 상관관계 혹은 프레임 내부 통계량을 이용했으며, 음성 신호가 갖는 다중 스케일·계층적 특성을 충분히 활용하지 못했다는 한계를 지적한다. 논문은 이러한 문제점을 해결하기 위해 세 가지 핵심 설계를 도입한다. 첫째, 1‑D CNN을 계층적으로 쌓아 음성 프레임을 작은 단위(음소·sub‑word)에서 큰 단위(단어·문장)까지 점진적으로 추상화한다. 둘째, 각 CNN 블록 뒤에 서로 다른 크기의 어텐션 모듈을 배치해, 저수준 특징에서는 미세한 변형을, 고수준 특징에서는 전반적인 구조 변화를 강조하도록 설계하였다. 셋째, 여러 레벨에서 추출된 특징을 단순히 연결(concatenate)한 뒤, 두 개의 완전 연결층으로 최종 이진 분류를 수행한다.

실험에서는 공개된 VoIP 스테가노그래피 데이터셋을 사용해 삽입 비율 0.1%5%와 샘플 길이 20ms200ms 구간을 다양하게 설정하였다. 제안 모델은 기존의 마코프 체인 기반, MFCC‑CNN, RNN‑코드워드 상관 모델 등에 비해 평균 4.2%p 이상의 정확도 향상을 보였으며, 특히 20ms 이하의 초단위 샘플에서 7%p 이상의 개선을 기록했다. 또한 FLOPs와 추론 지연이 기존 딥러닝 기반 방법 대비 각각 30%·25% 감소해 실시간 서비스 적용 가능성을 높였다.

하지만 몇 가지 한계도 존재한다. 데이터셋이 한정적이며, 다양한 코덱(G.711, Opus 등)이나 네트워크 손실 상황에 대한 일반화 검증이 부족하다. 어텐션 모듈의 구체적인 설계(스케일, 헤드 수 등)와 각 레이어가 실제로 어떤 변형을 포착하는지에 대한 시각화·해석이 부족해, 모델의 설명 가능성이 낮다. 또한, 학습 과정에서 과적합을 방지하기 위한 정규화·데이터 증강 전략이 상세히 기술되지 않아 재현성에 의문이 남는다. 향후 연구에서는 멀티코덱·멀티채널 데이터 확장, 어텐션 가중치 해석, 그리고 경량화 모델(예: MobileNet‑V2 기반) 등을 통해 실용성을 더욱 강화할 필요가 있다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기