시각 분석으로 보는 적대적 머신러닝 취약점

초록

본 논문은 데이터 중독 공격을 중심으로, 모델·데이터·특징·지역 구조 네 관점에서 취약점을 시각화·분석하는 통합 시각 분석 프레임워크를 제안한다. 다중 시각화 뷰와 인터랙티브 도구를 통해 공격 전후의 성능 변화, 인스턴스 변동, 특징 분포, 이웃 구조 변화를 직관적으로 파악할 수 있다. 두 개의 이진 분류 사례 연구를 통해 프레임워크의 유용성을 입증한다.

상세 분석

이 논문은 적대적 머신러닝, 특히 데이터 중독(Poisoning) 공격에 대한 모델 취약성 탐색을 시각 분석 기법으로 확장한 점이 가장 큰 공헌이다. 기존 XAI 연구는 주로 모델 입력‑출력 관계, 내부 파라미터, 혹은 성능 메트릭을 시각화했지만, 공격자가 모델을 어떻게 조작할 수 있는지, 어느 부분이 가장 취약한지는 충분히 다루지 못했다. 저자들은 ‘목표(Goal)·지식(Knowledge)·능력(Capability)·전략(Strategy)’이라는 네 가지 공격자 특성을 정리하고, 이를 시각화 설계에 매핑하였다.

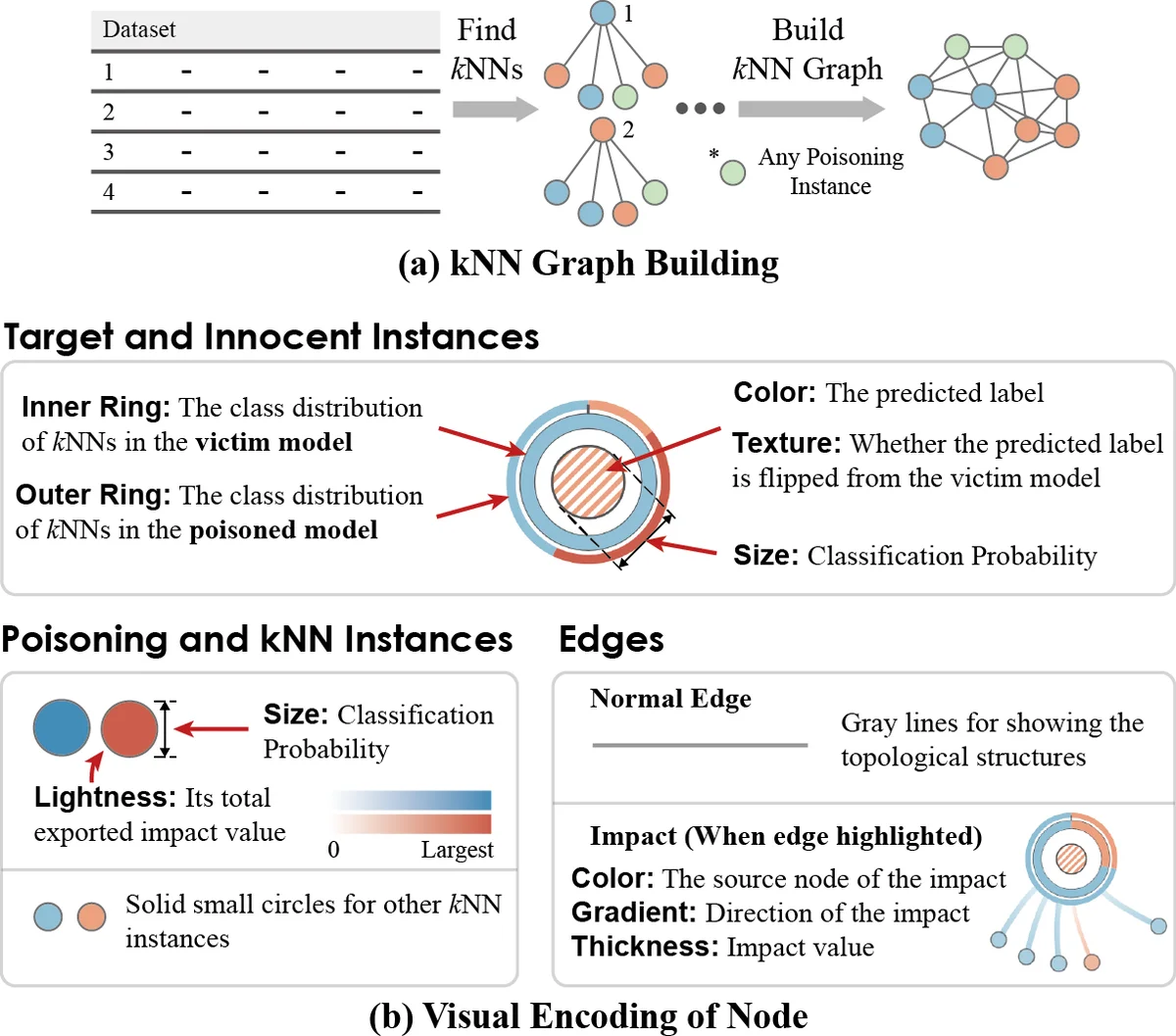

프레임워크는 네 개의 주요 뷰로 구성된다. 첫 번째는 모델 오버뷰로, 전체 성능 지표(정밀도, 재현율 등)와 공격 전후의 변화량을 한눈에 보여준다. 두 번째는 인스턴스 뷰로, 개별 데이터 포인트의 라벨 변동, 삽입된 중독 인스턴스, 그리고 결정 경계와의 거리 등을 시각적으로 표시한다. 세 번째는 특징 뷰이며, 공격 전후 특정 단어(예: “will”, “email”)와 같은 피처의 분산·평균 변화를 히스토그램과 박스플롯으로 비교한다. 네 번째는 지역 구조 뷰로, 대상 인스턴스 주변의 K‑근접 이웃 그래프를 동적으로 재구성해, 중독 후 이웃 관계가 어떻게 재배열되는지를 보여준다.

특히, 공격 비용과 효과를 동시에 고려할 수 있는 비용‑효과 매트릭스를 도입해, 동일한 목표를 달성하는 여러 공격 시나리오(예: 인스턴스 #40 vs #80)의 비용 차이를 시각적으로 비교한다. 이를 통해 사용자는 “가장 작은 삽입 비용으로 최대 성능 저하를 일으키는 인스턴스”를 빠르게 식별할 수 있다.

시스템은 모듈형 설계로, 현재는 Gradient Ascent 기반의 최적화 공격과 StingRay, Binary‑Search 등 여러 공격 알고리즘을 플러그인 형태로 교체 가능하도록 구현하였다. 또한, 인터랙티브 필터링·브러싱을 통해 특정 클래스, 피처, 혹은 거리 범위만을 선택해 상세 분석할 수 있다.

두 개의 사례 연구에서는 스팸 필터와 의료 진단 이진 분류기를 대상으로, 목표 기반 중독 공격과 신뢰도 저하 공격을 각각 적용하였다. 결과는 시각화가 제공하는 인사이트 없이 단순 성능 지표만으로는 발견하기 어려운, 예를 들어 “특정 단어의 분산이 급증하면서 결정 경계가 이동”하는 현상을 명확히 드러냈다. 이는 방어 메커니즘 설계 시, 피처 수준의 이상 탐지나 데이터 검증 정책을 강화하는 근거로 활용될 수 있다.

전반적으로 이 프레임워크는 적대적 공격 시나리오를 시각적으로 탐색·설명함으로써, 모델 설계자와 보안 전문가가 사전 방어 전략을 수립하고, 공격 발생 시 빠르게 원인을 파악하는 데 큰 도움을 준다.

댓글 및 학술 토론

Loading comments...

의견 남기기