패션 이미지 편집을 위한 자유형 파싱 기반 GAN

본 논문은 스케치와 색상 스트로크라는 자유형 입력을 이용해 패션 이미지를 직관적으로 편집할 수 있는 FE‑GAN을 제안한다. FE‑GAN은 (1) 자유형 파싱 네트워크로 불완전한 파싱 맵을 완전한 인간 파싱으로 복원하고, (2) 파싱‑인식 인페인팅 네트워크가 파싱 정보를 활용해 고해상도 텍스처를 재생성한다. 다중 스케일 어텐션 정규화 레이어를 디코더에 삽입해 스케치·색상 정보를 효과적으로 보존한다. 실험 결과, 기존 인페인팅·얼굴 편집 모델을 …

저자: Haoye Dong, Xiaodan Liang, Yixuan Zhang

본 논문은 패션 이미지 편집을 위해 사용자가 자유롭게 그린 스케치와 몇 개의 색상 스트로크만으로도 고해상도 이미지를 실시간에 가깝게 수정할 수 있는 새로운 프레임워크인 FE‑GAN(Fashion Editing Generative Adversarial Network)을 제안한다. 기존의 이미지 인페인팅·편집 연구들은 일반적인 복원 작업에 초점을 맞추어, 패션 이미지가 갖는 복잡한 의상 구조와 색상 정보를 충분히 활용하지 못했다. 또한 전통적인 컨볼루션·배치 정규화 계열을 그대로 사용하면, 입력된 스케치와 색상이 네트워크 깊은 층을 지나면서 점점 희석되어 최종 출력에 반영되지 않는 문제가 있었다.

FE‑GAN은 이러한 한계를 극복하기 위해 두 개의 주요 모듈을 설계한다. 첫 번째 모듈인 자유형 파싱 네트워크는 불완전한 인간 파싱 맵(예: 마스크된 영역이 비어 있는 파싱)과 사용자 입력(스케치, 색상, 노이즈, 마스크)을 동시에 받아들여, 완전한 파싱 맵을 생성한다. 이 단계는 “구조 복원”에 해당하며, 파싱 맵은 각 픽셀이 어떤 의상 부위(상의, 하의, 신발 등)에 속하는지를 라벨링한다. 파싱 맵을 먼저 복원함으로써, 이후 텍스처를 채우는 과정에서 의미론적 일관성을 유지할 수 있다. 네트워크는 U‑Net 기반 인코더‑디코더 구조를 사용하고, 스케치와 색상에 따라 파싱 결과가 달라지도록 설계돼, 사용자가 의도한 디자인을 직접 제어할 수 있다.

두 번째 모듈인 파싱‑인식 인페인팅 네트워크는 생성된 파싱 맵과 원본 이미지(마스크된 부분을 제외한) 그리고 동일한 사용자 입력을 받아 최종 이미지를 합성한다. 여기서는 두 종류의 인코더가 병렬로 작동한다. 첫 번째는 Partial Convolution을 활용해 전경(마스크가 없는 영역)만을 대상으로 특징을 추출함으로써, 마스크된 영역에 대한 불필요한 잡음 전파를 방지한다. 두 번째는 표준 컨볼루션을 사용해 완전한 파싱 맵에서 의미론적 정보를 추출한다. 두 인코더의 출력은 채널 차원에서 결합되고, 다중 팽창(dilated) residual 블록을 거쳐 넓은 수용 영역을 확보한다.

디코더 단계에서는 다중 스케일 어텐션 정규화 레이어(Attention Normalization Layer, ANL)를 삽입한다. ANL은 기존 Conditional Normalization(SPADE)과 유사하게 외부 조건(스케치, 색상, 노이즈)을 활용하지만, 직접적인 어피인 변환 대신 어텐션 맵을 학습한다. 정규화된 활성화에 어텐션 맵과 바이어스를 곱해 공간적으로 중요한 영역을 강조하고, 이후 ReLU와 컨볼루션을 거쳐 원본 정규화된 활성화와 concatenate한다. 이 과정은 스케치와 색상이 디코딩 과정에서 사라지는 것을 방지하고, 다양한 해상도 단계에서 조건 정보를 효과적으로 전달한다.

학습 손실은 두 네트워크에 각각 맞춤형으로 설계되었다. 자유형 파싱 네트워크는 파싱 손실(L_parsing, 교차 엔트로피 기반), 다중 스케일 특징 손실(L_feat, VGG 기반), 그리고 적대 손실(L_adv)를 가중합한다. 파싱‑인식 인페인팅 네트워크는 마스크 영역 L1 손실, 전경 L1 손실, 얼굴 L1 손실, 얼굴 TV 손실, 퍼셉추얼 손실, 스타일 손실, 그리고 적대 손실을 포함한다. 특히 얼굴 영역에 별도 TV 손실을 적용해 얼굴 디테일이 흐려지는 것을 방지한다.

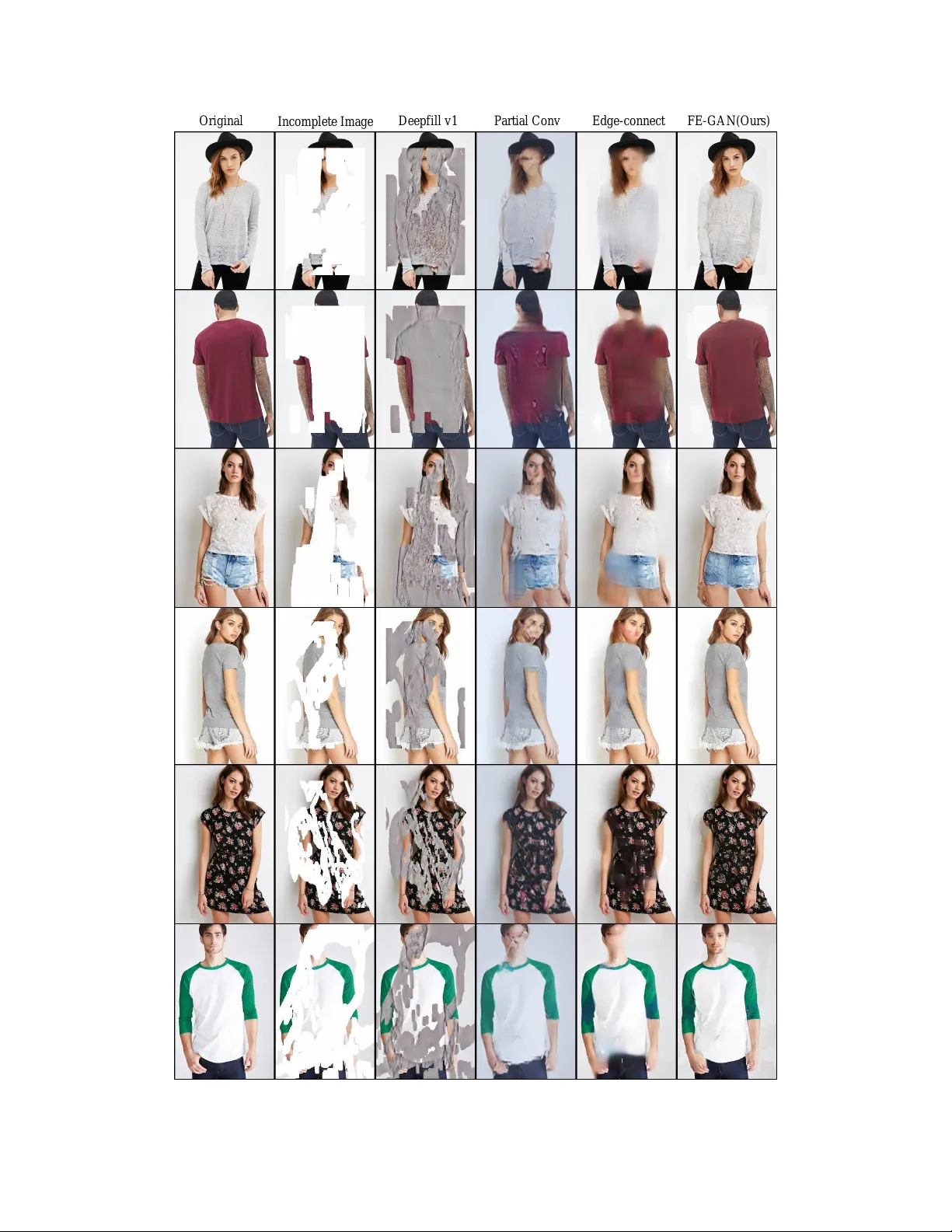

실험은 세 개의 데이터셋(DeepFashion, MPV, 자체 구축 FashionE)에서 수행되었다. 정량 평가 지표로는 FID, LPIPS, SSIM을 사용했으며, FE‑GAN은 기존 DeepFill‑v1, PartialConv, Edge‑Connect, SC‑FEGAN 등에 비해 FID를 30% 이상 낮추고, LPIPS와 SSIM에서도 유의미한 개선을 보였다. 정성적 비교에서도 스케치와 색상이 정확히 반영된 고해상도 결과를 확인할 수 있었다. 특히 색상 스트로크가 매우 희소한 경우에도 어텐션 정규화 덕분에 색상이 정확히 전달되었으며, 복잡한 레이어드 의상이나 패턴에서도 파싱 가이드를 통해 자연스러운 텍스처가 생성되었다.

본 연구의 주요 기여는 다음과 같다. (1) 스케치·색상 조건에 따라 파싱 맵을 자유롭게 조절할 수 있는 자유형 파싱 네트워크를 제안하였다. (2) 어텐션 맵을 이용한 새로운 정규화 기법인 Attention Normalization Layer를 설계해, 조건 정보를 효과적으로 보존하고 강조하였다. (3) 파싱‑인식 인페인팅 네트워크에 전경 기반 Partial Convolution과 다중 스케일 ANL을 결합해 고해상도 패션 이미지 편집을 실현하였다. 향후 연구에서는 3D 의상 모델링, 비디오 프레임 간 일관성 유지, 그리고 다른 도메인(인테리어, 자동차 등)으로의 확장이 기대된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기