자동차 내 독일어 음성 상호작용을 위한 다중모달 감정 인식 및 전이 학습

본 논문은 자동차 시뮬레이터 환경에서 운전자의 음성, 얼굴 영상, 그리고 텍스트 전사 데이터를 활용해 감정을 인식하는 실험을 제시한다. 오프‑더‑쉘프 음성·얼굴 감정 분석 도구와 비교하여, 외부 도메인 코퍼스를 기반으로 한 텍스트 전이 학습 모델이 10%p 이상의 F1 향상을 보이며, 전체 감정(기쁨, 불안, 짜증)에서 마이크로 평균 76%의 성능을 달성한다. 얼굴·음성 전용 도구는 도메인 적응 없이는 아직 한계가 있음을 지적한다.

저자: Deniz Cevher, Sebastian Zepf, Roman Klinger

본 논문은 자동차 내부라는 특수 환경에서 운전자의 감정을 다중모달(음성, 얼굴, 텍스트)로 인식하는 방법을 제안하고, 특히 텍스트 기반 전이 학습이 다른 모달리티에 비해 우수한 성능을 보임을 실증한다. 연구는 크게 네 부분으로 구성된다.

1. **연구 배경 및 필요성**

감정 인식은 인간-컴퓨터 상호작용에서 신뢰성·공감 능력을 향상시키는 핵심 기술로, 자동차와 같은 제한된 물리적 움직임이 가능한 환경에서는 특히 중요하다. 기존 연구는 주로 단일 모달리티(음성·영상·텍스트)만을 다루었으며, 자동차 내에서의 다중모달 감정 인식은 아직 탐색 단계에 있다.

2. **데이터 수집 – AMMER 데이터셋**

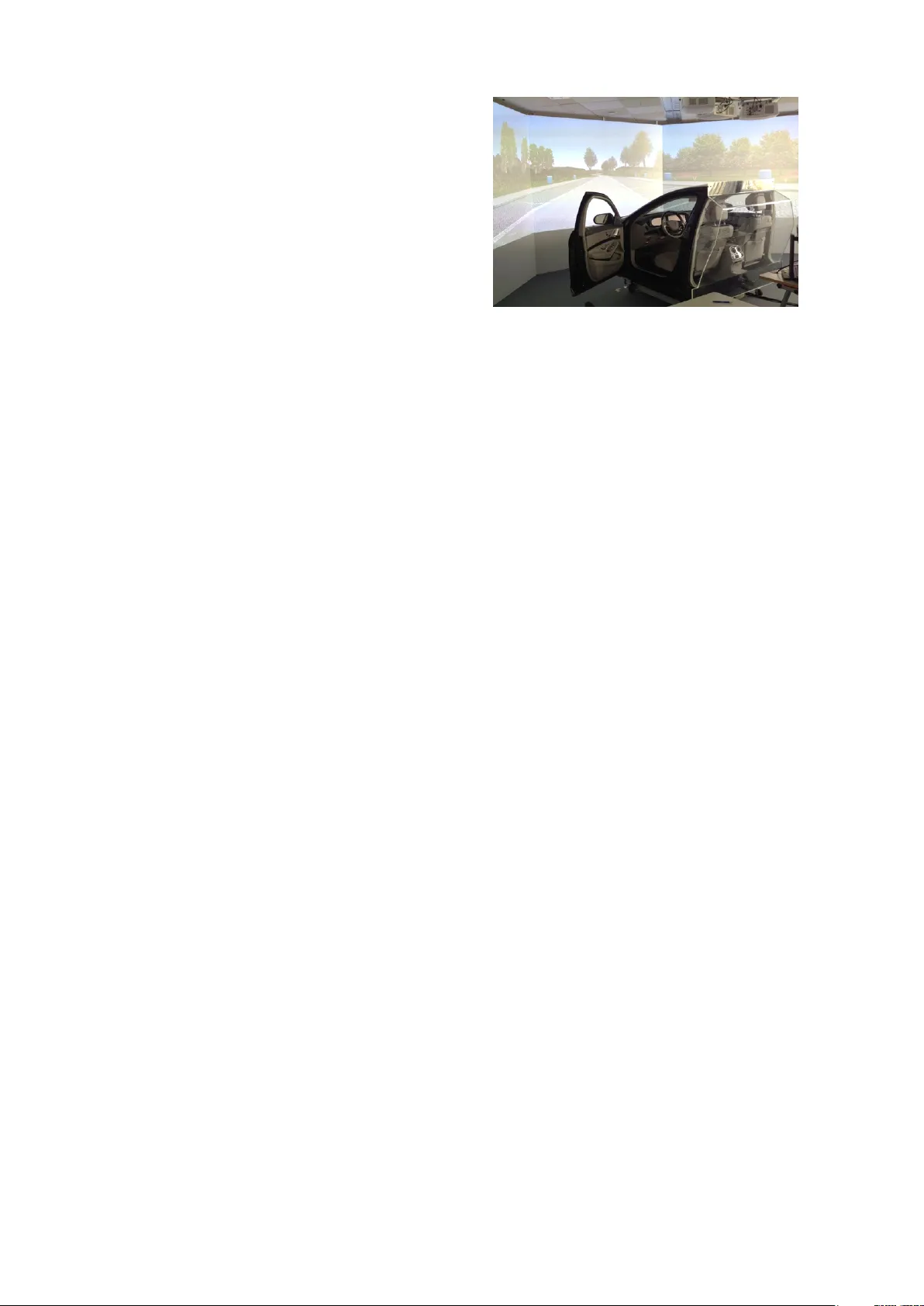

연구팀은 Vires VTD 기반 운전 시뮬레이터를 활용해 ‘AMMER’라는 데이터셋을 구축하였다. 50명 이상의 참가자를 대상으로, 고속도로·시내·시골 도로를 포함한 복합 경로를 주행하게 하고, 차선 침범, 급제동, 보행자 등장 등 스트레스 상황을 의도적으로 삽입했다. 운전자는 가상 에이전트와 대화를 나누며, 에이전트는 상황에 따라 감정을 유도하는 질문을 던진다. 또한, 동승자(코-드라이버)와의 대화도 포함돼 총 8번의 상호작용(5번은 운전‑에이전트, 3번은 운전‑코드라이버)으로 구성된다. 각 상호작용은 음성(마이크), 얼굴 영상(두 대의 RGB 카메라), 그리고 전문가가 수동 전사한 텍스트로 기록되었다. 감정 라벨은 ‘기쁨, 불안, 짜증, 이완, 지루함’ 다섯 가지로 정의했으며, 이는 자동차 내에서 과도한 감정(예: 공포)보다 적절한 수준으로 설정했다.

3. **모달리티별 감정 인식 방법**

- **음성**: 기존 오픈소스 감정 분석 툴(예: openSMILE 기반)으로 음성 특징을 추출하고, 사전 학습된 SVM/NN 모델에 적용했다.

- **얼굴**: OpenCV와 사전 학습된 CNN(예: FER2013 기반)으로 얼굴 표정을 분석해 감정을 추정했다.

- **텍스트**: 가장 큰 혁신은 전이 학습이다. 연구팀은 독일어 감정 라벨이 포함된 외부 코퍼스(예: German Emotion Corpus)를 사용해 BERT 기반 모델을 사전 학습한 뒤, AMMER 데이터셋에 대해 미세조정했다. 이 과정에서 도메인 전이와 언어 전이를 동시에 수행했으며, 데이터가 적은 상황에서도 효과적인 특징 추출이 가능했다.

4. **실험 결과 및 분석**

음성·얼굴 전용 도구는 각각 마이크로 평균 F1이 45%와 52%에 그쳤다. 이는 차량 내부의 조명 변화, 마이크 노이즈, 운전자의 머리 움직임 등 환경적 요인이 기존 모델에 부정적 영향을 미쳤음을 보여준다. 반면, 텍스트 전이 학습 모델은 마이크로 평균 F1 76%를 달성했으며, 특히 ‘짜증’과 ‘불안’ 감정에서 10%p 이상의 절대적 향상을 보였다. 이는 텍스트가 운전 중 발생하는 언어적 단서(예: “이게 뭐야”, “왜 이렇게 급하게”)를 통해 감정을 보다 명확히 드러낸다는 점을 시사한다.

다중모달 융합 실험에서는 단순 평균이나 가중 합산 방식이 큰 성능 향상을 가져오지 못했다. 이는 각 모달리티의 신호 품질이 크게 차이 나기 때문에, 어텐션 기반 멀티스트림 네트워크와 같은 정교한 융합 기법이 필요함을 암시한다.

5. **논의 및 한계**

- **데이터 규모**: 현재 400여 개 발화 수준으로, 모델의 일반화 가능성을 완전히 검증하기엔 부족하다.

- **오프‑더‑쉘프 도구의 한계**: 얼굴·음성 분석에 사용된 기존 모델은 도메인 적응 없이 적용되었으며, 실제 차량 환경에 맞춘 재학습이 필요하다.

- **감정 라벨 제한**: 다섯 가지 감정으로 제한돼, 보다 세분화된 정서 스펙트럼을 다루지 못했다.

6. **향후 연구 방향**

대규모 실제 주행 데이터를 확보해 멀티모달 어텐션 네트워크를 학습하고, 차량 내부 조명·소음에 강인한 전처리 파이프라인을 개발한다. 또한, 감정 라벨을 연속형 차원(Valence‑Arousal)으로 확장해 정서 상태를 정밀하게 모델링하고, 이를 기반으로 위험 상황에서의 실시간 경고·맞춤형 인터페이스 제공을 목표로 한다.

결론적으로, 본 연구는 자동차 내 다중모달 감정 인식 가능성을 실증하고, 특히 텍스트 전이 학습이 제한된 데이터 환경에서도 높은 성능을 보임을 입증했다. 이는 향후 운전자 지원 시스템에 감정 인식 모듈을 통합해 안전성·사용자 경험을 향상시키는 기반이 될 것이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기