시스템 최적화를 위한 딥 강화학습: 현황과 미래 과제

초록

**

본 논문은 시스템 최적화 문제에 딥 강화학습(DRL)을 적용한 최신 연구들을 종합적으로 검토하고, 효과성을 평가하기 위한 핵심 메트릭을 제안한다. 연속형·에피소드형 과제 구분, 상태·행동 임베딩, 모델 선택, 효율성·견고성 등을 분석하며, 현재 직면한 기술적·실용적 한계와 향후 연구 방향을 제시한다.

**

상세 분석

**

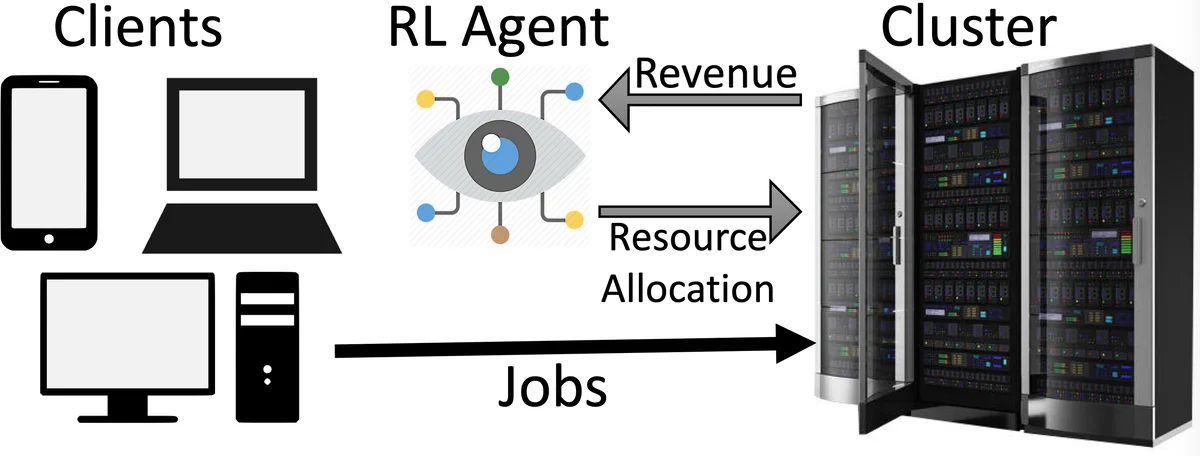

논문은 먼저 시스템 최적화가 “지연·희소·누적 보상”이라는 특성을 갖는 강화학습(MDP) 문제임을 강조한다. 전통적인 테이블 기반 Q‑learning이나 선형 근사와 달리, 딥 뉴럴 네트워크를 정책 혹은 가치 함수에 결합함으로써 미방문 상태에서도 일반화가 가능해진다. 저자는 정책 기반(PG, PPO)과 가치 기반(Q‑learning, SARSA, DDPG) 알고리즘을 구분하고, 각각이 연속형(클라우드 스케줄링)과 에피소드형(쿼리 최적화, 컴파일러 단계 순서) 문제에 어떻게 매핑되는지를 상세히 설명한다. 특히, 연속형 과제에서는 즉시 업데이트가 가능한 TD 방식이 온라인 적응에 유리하고, 에피소드형에서는 배치 학습이 가능한 정책 경사법이 효율적이라는 점을 실험적 근거와 함께 제시한다.

핵심 기여는 “필수 평가 메트릭”을 정의한 것이다. ① 성능(Reward) 향상 – 절대 보상 및 베이스라인 대비 비율, ② 샘플 효율성 – 학습에 필요한 인터랙션 횟수, ③ 연산·메모리 비용 – 모델 파라미터 수, 추론 지연, ④ 안정성·수렴 속도 – 변동성 및 학습 곡선, ⑤ 범용성·이식성 – 다른 시스템 환경으로의 전이 가능성, ⑥ 견고성 – 환경 변동·노이즈에 대한 민감도, ⑦ 해석 가능성 – 정책/가치 함수의 설명 가능성 등을 제시한다. 이러한 메트릭은 기존 연구가 보상 개선에만 집중하는 경향을 넘어, 실제 운영 환경에서의 실용성을 평가하도록 설계되었다.

또한, 논문은 딥 RL 적용 시 흔히 마주치는 실용적 문제들을 짚는다. 첫째, 시뮬레이터 품질이 낮으면 부정확한 보상 신호가 학습을 방해한다. 둘째, 보상 설계가 복잡하고 다중 목표가 얽히면 스칼라 보상으로의 축소가 어려워 정책이 비효율적일 수 있다. 셋째, 탐색·활용 트레이드오프가 잘못 설정되면 초기 탐색 비용이 과도하게 커져 실제 서비스에 적용하기 힘들다. 넷째, 시스템 규모가 커질수록 상태·행동 공간이 폭발적으로 증가해 샘플 효율성이 급감한다. 이를 완화하기 위한 방법으로 상태/행동 임베딩, 계층적 정책, 메타‑러닝, 모델 기반 플래닝 등을 제안한다.

마지막으로, 저자는 현재 딥 RL이 표준화된 벤치마크와 비교 평가가 부족하고, 이론적 수렴 보장이 약하다는 점을 비판한다. 따라서 향후 연구는 (1) 공통 데이터셋·시뮬레이터 구축, (2) 이론적 성능 한계 분석, (3) 멀티‑목표 최적화를 위한 보상 정규화 기법, (4) 연산·에너지 효율을 고려한 경량 모델 설계 등에 집중해야 한다는 방향성을 제시한다.

**

댓글 및 학술 토론

Loading comments...

의견 남기기