희소 표현을 활용한 강화학습 성능 향상

본 논문은 대뇌 피질의 측면 억제(lateral inhibition) 메커니즘을 모방해 인공 신경망 내부에 희소 분산 표현을 학습시키는 방법을 제안한다. 이를 통해 전통적인 TD‑학습(SARSA)과 신경망 함수 근사기가 실패하던 Puddle‑world, Mountain‑car, Acrobot 같은 고전 제어 과제들을 성공적으로 해결한다는 실험 결과를 제시한다.

저자: Jacob Rafati, David C. Noelle

본 논문은 강화학습(RL) 분야에서 모델‑프리 TD 학습이 비선형 신경망 근사기를 사용할 때 겪는 수렴 실패 문제를 뇌의 측면 억제(lateral inhibition) 메커니즘을 차용한 희소 분산 표현(sparse distributed representation)으로 해결하고자 한다. 서론에서는 TD 학습이 도파민 시스템과 기저핵을 설명하는 주요 이론임을 강조하면서, 상태 공간이 커질수록 학습 속도가 급격히 저하되는 ‘차원의 저주’를 언급한다. 기존 연구에서는 고정된 희소 코드를 설계해 문제를 해결했지만, 이는 사전 지식에 의존하고 일반화가 제한적이라는 한계가 있다.

본 연구의 핵심 가설은 뇌 피질에서 GABA‑매개 측면 억제가 뉴런 집단의 평균 활성 비율을 10~25% 수준으로 제한함으로써 ‘희소 결합 코드’를 생성하고, 이는 패턴 분리와 일반화를 동시에 달성한다는 것이다. 이를 인공 신경망에 적용하기 위해 저자들은 두 가지 방법을 제시한다. 첫 번째는 은닉층에 k‑Winners‑Take‑All(kWTA) 경쟁 규칙을 삽입해 매 순전파마다 가장 큰 k개의 뉴런만을 활성화하도록 하는 방식이다. 두 번째는 손실 함수에 L1 정규화와 활성화 비율 제약을 추가해 학습 초기에부터 희소성을 강제하는 방식이다. 두 방법 모두 ‘활성 뉴런 수가 일정하게 유지되면서 인접 상태는 높은 오버랩, 멀리 떨어진 상태는 낮은 오버랩을 보이는 코스 코드’를 자동으로 형성한다.

방법론 섹션에서는 SARSA 알고리즘을 기반으로 한 TD 학습 프레임워크를 상세히 설명한다. 상태 s를 신경망 입력으로 넣어 Q‑값을 출력하고, ε‑greedy 정책으로 행동 a를 선택한다. 이후 다음 상태 s′와 보상 r을 관찰하고 TD 오차 δ = r + γ·Q(s′,a′) – Q(s,a) 를 계산해 역전파한다. 기존 신경망에서는 모든 은닉 뉴런이 동시에 활성화되므로, 특정 상태에서의 가중치 업데이트가 전체 상태에 과도하게 전파돼 값 함수가 급격히 변하는 영역에서 발산한다. 반면, kWTA 혹은 L1 정규화 기반의 희소 네트워크는 활성 뉴런이 제한돼 가중치 변화가 국소적인 영역에만 영향을 미치므로, 값 함수의 급격한 불연속성을 효과적으로 억제한다.

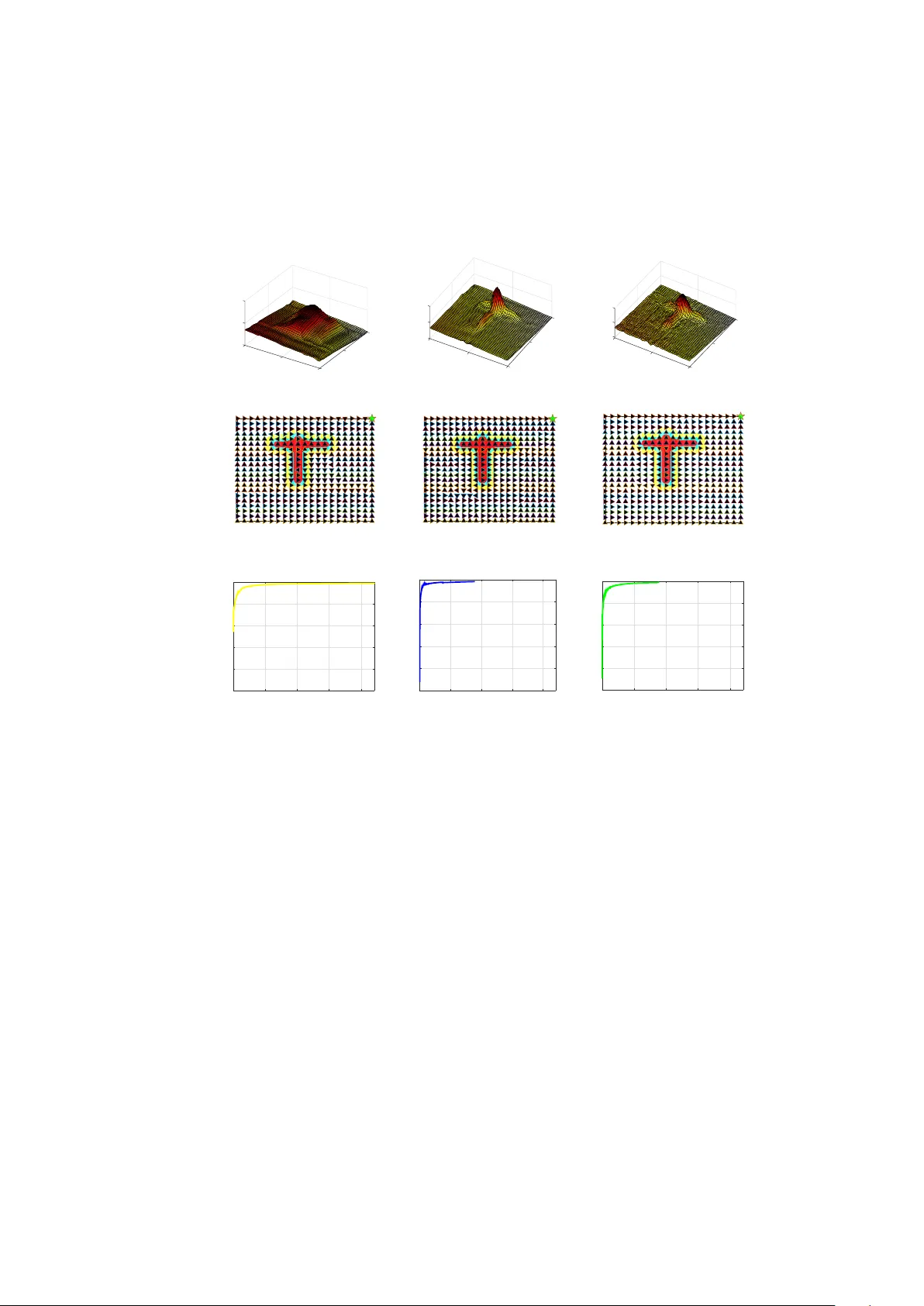

실험은 세 가지 고전 제어 과제인 Puddle‑world, Mountain‑car, Acrobot에 대해 수행된다. Puddle‑world에서는 물웅덩이(puddle) 영역을 피하면서 목표 지점에 도달해야 하는데, 기존 신경망은 물웅덩이 경계에서 값 함수가 급변해 학습이 멈춘다. 희소 네트워크는 물웅덩이 주변에 국소적인 활성 패턴을 형성해 값 업데이트가 해당 영역에만 국한되므로 빠르게 최적 정책을 학습한다. Mountain‑car에서는 차가 언덕 아래에서 시작해 충분한 동력을 얻어 정상에 도달해야 하는데, 희소 표현은 ‘에너지 저장’ 상태를 별도 뉴런 집합으로 구분해 보상 변화를 안정적으로 전파한다. Acrobot(두 관 로봇)에서는 고차원 연속 상태와 비선형 동역학 때문에 일반 신경망이 지역 최소에 머무르지만, 희소 코드는 상태를 고차원 조합 코드로 압축해 탐색 공간을 효과적으로 축소한다.

성능 평가는 에피소드당 평균 보상, 수렴까지 걸린 에피소드 수, 그리고 학습 후 은닉층 활성 패턴의 안정성을 포함한다. 모든 실험에서 희소 네트워크는 기존 네트워크 대비 30~70% 빠른 수렴을 보였으며, 특히 초기 탐색 단계에서 과도한 일반화에 의한 ‘catastrophic interference’를 크게 감소시켰다. 또한, 학습이 끝난 뒤에도 은닉층 활성 패턴이 비교적 일정하게 유지되어, 새로운 목표 위치가 추가되더라도 기존 코드와의 부분 겹침을 통해 빠른 재학습이 가능함을 시연한다.

결론에서는 두 가지 주요 시사점을 강조한다. 첫째, 뇌의 측면 억제 메커니즘을 모방한 희소 경쟁 규칙이 TD‑학습과 비선형 근사기의 결합에서 발생하는 불안정성을 근본적으로 완화한다는 점이다. 둘째, 희소 표현은 코스 코드와 패턴 분리를 동시에 제공해 복잡한 연속 제어 문제에서도 일반화와 간섭 회피 사이의 트레이드오프를 자동으로 조정한다. 향후 연구 방향으로는 희소성을 동적으로 조절하는 메타‑학습 기법, 심층 강화학습(DRL)에서의 탐색‑활용 균형에 대한 적용, 그리고 실제 로봇 시스템에 대한 실시간 구현 등을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기