깊이형 에코스테이트 네트워크의 메모리 용량 분석

본 논문은 전통적인 단층 ESN과 대비해 두 가지 깊이형 ESN 구조(병렬형·연속형)를 제안하고, 각각의 단기 메모리 용량(MC)을 이론적으로 분석한다. 병렬형 ESN은 전통 ESN과 동일한 MC를 유지하면서 평균화에 의해 예측 오차를 크게 감소시킨다. 연속형 ESN은 각 레이어가 이전 레이어 출력을 입력으로 사용함에 따라 MC가 감소하지만, 복합 특징 추출 능력으로 NRMSE가 개선된다. 시뮬레이션 결과는 병렬형이 38.5%, 연속형이 16.…

저자: Xuanlin Liu, Mingzhe Chen, Changchuan Yin

본 논문은 에코스테이트 네트워크(ESN)의 핵심 성능 지표인 단기 메모리 용량(Memory Capacity, MC)을 깊이형 구조에 적용해 분석하고, 두 가지 새로운 아키텍처를 제안한다. 서론에서는 ESN이 기존 순환 신경망에 비해 학습이 간단하고 파라미터가 적으며, 다양한 시계열 예측 분야에 활용되고 있음을 소개한다. 그러나 무작위 가중치 초기화와 단일 리저버 구조로 인해 복잡한 시스템을 모델링할 때 예측 오차가 크게 발생한다는 한계점을 지적한다. 기존 연구들은 주로 ESN의 구조적 변형이나 학습 알고리즘 개선에 초점을 맞췄지만, 메모리 용량에 대한 이론적 분석은 부족했다.

이에 저자는 두 가지 깊이형 ESN 구조를 설계한다. 첫 번째는 **병렬형(Parallel) Deep ESN**으로, L개의 독립적인 리저버를 입력에 동시에 연결하고, 각 리저버의 출력을 평균화한다. 이 구조는 각 리저버가 갖는 잡음과 편향을 상쇄시키며, 학습 비용을 감소시킨다. 수식 (4)-(6) 에서는 각 리저버의 상태 업데이트와 출력, 그리고 최종 평균 출력 정의가 제시된다. 두 번째는 **연속형(Series) Deep ESN**으로, L개의 리저버를 순차적으로 연결해 이전 레이어의 출력을 다음 레이어의 입력으로 사용한다. 이 구조는 복합적인 비선형 특징을 단계별로 추출함으로써 복잡한 시계열 패턴을 포착한다. 수식 (7)-(8) 은 연속형 레이어의 상태와 출력 업데이트를 나타낸다.

이후 섹션 III에서는 두 구조의 MC를 이론적으로 분석한다. MC는 입력 신호 s(t‑k)와 네트워크 출력 y(t) 사이의 제곱 상관계수 C_k 로 정의되며, 전체 MC는 C=∑_{k=1}^∞ C_k 로 합산된다. 저자는 리저버 업데이트 행렬 W를 순환 구조 형태(식 11) 로 가정하고, 회전 연산자(rot), 확장 행렬 Ω, 대각 행렬 Γ, 그리고 A=ΩᵀΓ²Ω 를 도입해 수학적 전개를 수행한다. 이를 통해 각 리저버의 상태 x^{(l)}(t) 를 과거 입력의 가중합 형태로 표현하고, ridge regression을 이용한 출력 가중치 U^{(l)} 를 닫힌 형태로 도출한다.

**병렬형**에 대해서는 정리 1을 제시한다. 각 리저버가 정규 행렬 Ω^{(l)} 를 만족한다면, 전체 시스템의 MC는 C = N‑1 + r²N 로 얻어진다. 여기서 N은 각 리저버의 뉴런 수, r은 리저버 내부 가중치의 고정값이다. 이 결과는 병렬형이 레이어 수 L에 관계없이 단일 리저버와 동일한 메모리 용량을 유지함을 의미한다. 또한, MC는 리저버 크기 N에만 의존하므로, 메모리 한계는 N에 의해 결정된다.

**연속형**에 대해서는 현재 논문에서는 정확한 식을 제시하지 않고, “각 레이어의 MC가 연쇄적으로 곱해져 전체 MC가 L배 감소한다”는 정성적 결론만 제시한다. 따라서 연속형은 메모리 저장 능력이 감소하지만, 레이어 간 비선형 변환을 통해 복합 특징을 학습함으로써 실제 예측 정확도는 향상될 수 있다.

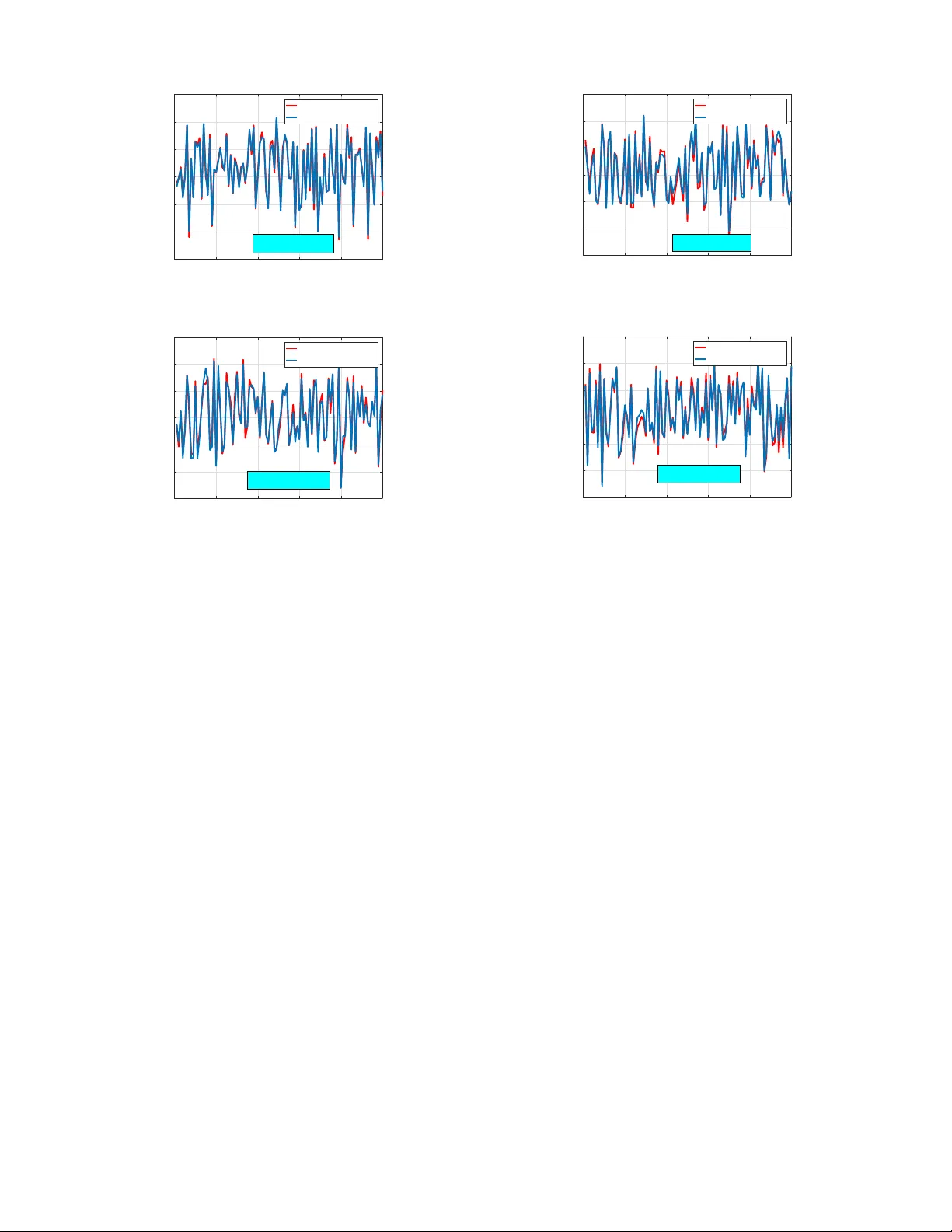

섹션 IV에서는 시뮬레이션을 통해 두 구조의 성능을 검증한다. 데이터셋은 NARMA(Nonlinear Autoregressive Moving Average) 시스템에서 생성된 시계열이며, NARMA는 현재 입력과 과거 출력에 의존하는 복잡한 비선형 동역학을 갖는다. 실험 설정은 표 I에 요약되어 있으며, 병렬형과 연속형 모두 L=3, N=50~100, r=0.9 등으로 구성된다. NRMSE(Normalized Root Mean Square Error)를 성능 지표로 사용한다. 결과적으로, 병렬형 Deep ESN은 전통 단층 ESN 대비 NRMSE를 38.5% 감소시켰으며, 연속형 Deep ESN은 16.8% 감소시켰다. 그래프(그림 4,5)에서는 학습 및 테스트 구간에서 예측 시계열이 실제 시계열에 근접함을 확인할 수 있다. 또한, 연속형 구조는 초기 ‘워밍업’ 단계에서 L·L_fo 만큼의 출력이 무시되어야 함에도 불구하고, 전체적인 예측 정확도는 병렬형에 비해 다소 낮지만 여전히 개선 효과를 보인다.

마지막으로 결론에서는 두 구조의 장단점을 정리한다. **병렬형**은 메모리 용량을 유지하면서 평균화에 의해 잡음 감소와 학습 비용 절감이라는 두 마리 토끼를 잡을 수 있다. **연속형**은 메모리 손실을 감수하더라도 복합 비선형 특징을 효과적으로 추출해 복잡한 시스템에 적용 가능하다. 현재 연속형에 대한 정확한 MC 분석이 부족하므로, 향후 연구에서는 이를 정량화하고, 다양한 실제 데이터(예: 금융, 통신, 로봇 제어)에서의 일반화 성능을 검증할 필요가 있다. 또한, 리저버 구조를 더 복잡하게 설계하거나, 적응형 스펙트럴 반경 조절 기법을 도입해 메모리와 예측 정확도 사이의 트레이드오프를 최적화하는 방안도 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기