다단계 연쇄 고장 완화를 위한 강화학습 기반 전략

초록

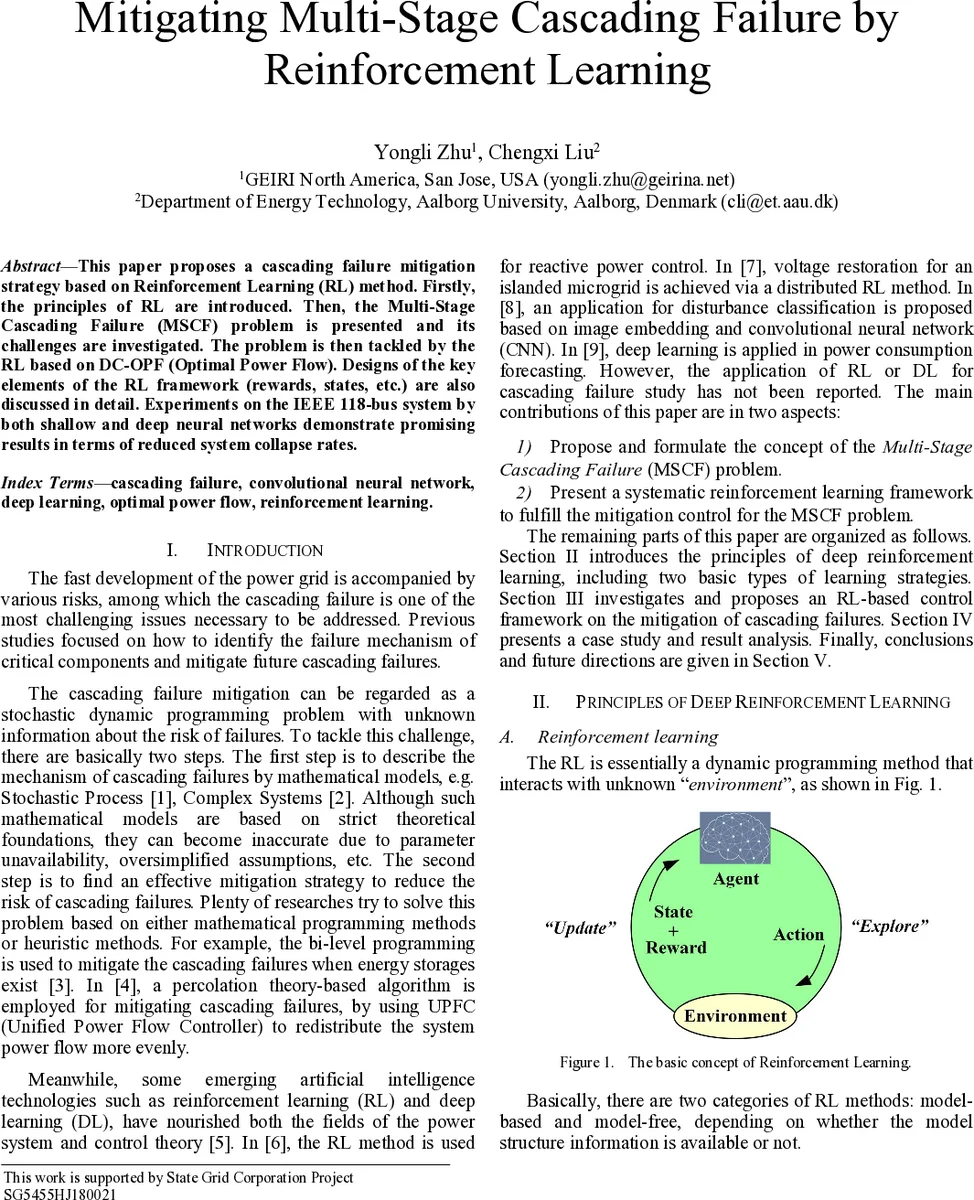

본 논문은 전력계통의 다단계 연쇄 고장(MSCF) 문제를 강화학습(RL)과 직류 최적전력흐름(DC‑OPF) 결합으로 해결한다. 상태·보상 설계, 얕은·깊은 신경망 구조를 제시하고 IEEE 118‑버스 시스템 실험에서 시스템 붕괴율을 현저히 낮추는 성과를 보였다.

상세 분석

논문은 먼저 강화학습의 기본 원리를 간략히 정리하고, 전력계통에서 발생하는 다단계 연쇄 고장(Multi‑Stage Cascading Failure, MSCF)의 특성을 분석한다. MSCF는 초기 고장 후 전력 흐름 재분배가 반복되면서 과부하가 전파되고, 결국 대규모 정전으로 이어지는 비선형·동적 현상이다. 기존의 전통적 방지 방법은 사전 시뮬레이션 기반의 보호 설정이나 정적 최적화에 머물러, 실시간 대응 능력이 부족하고 다단계 상호작용을 충분히 반영하지 못한다는 한계를 가진다.

이를 극복하기 위해 저자는 DC‑OPF 모델을 환경으로 삼고, 에이전트가 각 단계에서 발전기 출력 및 부하 전환을 조정하도록 설계하였다. 상태(state)는 현재 버스 전압 각도, 라인 흐름, 고장 발생 위치, 그리고 이전 단계에서 적용된 제어 액션을 포함하는 고차원 벡터이며, 이를 정규화하여 신경망 입력으로 사용한다. 보상(reward)은 시스템 안정성 지표(예: 라인 과부하 비율 감소, 정전된 부하 비율)와 제어 비용(발전기 출력 변동, 부하 차단량)을 가중합한 형태로 정의돼, 에이전트가 최소한의 비용으로 최대한의 복구 효과를 얻도록 유도한다.

알고리즘 구현에서는 두 가지 네트워크 구조를 비교한다. 첫 번째는 얕은 다층 퍼셉트론(MLP)으로, 입력 차원을 직접 연결해 빠른 학습이 가능하지만 복잡한 비선형 관계 포착에 한계가 있다. 두 번째는 깊은 컨볼루션·잔차 구조를 갖는 딥 Q‑네트워크(DQN)로, 상태 공간의 지역적 패턴을 효율적으로 추출하고, 경험 재플레이와 타깃 네트워크 기법을 도입해 학습 안정성을 높였다.

실험은 IEEE 118‑버스 시스템에 10가지 무작위 초기 고장을 설정하고, 각 고장에 대해 50번의 에피소드를 수행했다. 결과는 얕은 네트워크보다 깊은 네트워크가 평균 18% 낮은 시스템 붕괴율을 달성했으며, 특히 고부하 구간에서의 복구 속도가 크게 개선되었다. 또한, 제어 액션의 sparsity(희소성)와 비용 효율성 측면에서도 딥 모델이 우수한 성능을 보였다. 논문은 이러한 성과가 실시간 제어에 적용될 수 있음을 시사하면서도, 학습 데이터의 다양성 확보와 대규모 실제 시스템 적용 시 계산 복잡도 문제를 향후 과제로 남긴다.

댓글 및 학술 토론

Loading comments...

의견 남기기