음성 이벤트 분류에 대한 적대적 공격 분석

초록

본 논문은 Freesound 기반 DCASE 2018 과제 데이터셋을 이용해 다섯 개의 딥러닝 모델(VGG13, CRNN, GCNN, dense‑mel, dense‑wav)에 대해 화이트 노이즈, FGSM, Deepfool, Carlini‑Wagner 등 네 가지 무표적 및 두 가지 표적 공격을 적용하고, 성공률, 신뢰도, 신호대잡음비(SNR) 및 모델 간 전이성을 정량적으로 평가한다. 결과는 Deepfool과 C&W 공격이 거의 100% 성공률을 보이며 인간이 인지하기 어려운 낮은 SNR을 유지함을 보여준다. 또한 원시 오디오 입력 모델이 스펙트로그램 기반 모델보다 약간 더 견고하고, 공격 전이는 전체 모델 중 5~10% 수준에 불과함을 확인한다.

상세 분석

이 연구는 음성 이벤트 분류 분야에서 적대적 공격의 실효성을 체계적으로 검증한 최초 사례 중 하나로 평가할 수 있다. 먼저 모델 선택에 있어 DCASE 2018 챌린지에서 높은 성능을 기록한 VGG13, CRNN, GCNN 같은 전통적인 컨볼루션·리커런트 구조와, 로그멜 스펙트로그램 입력을 사용하는 dense‑mel, 원시 파형 입력을 사용하는 dense‑wav 두 가지 DenseNet 변형을 포함하였다. 이렇게 다양한 아키텍처와 입력 형태를 동시에 평가함으로써 공격에 대한 일반화된 결론을 도출하려는 시도가 돋보인다.

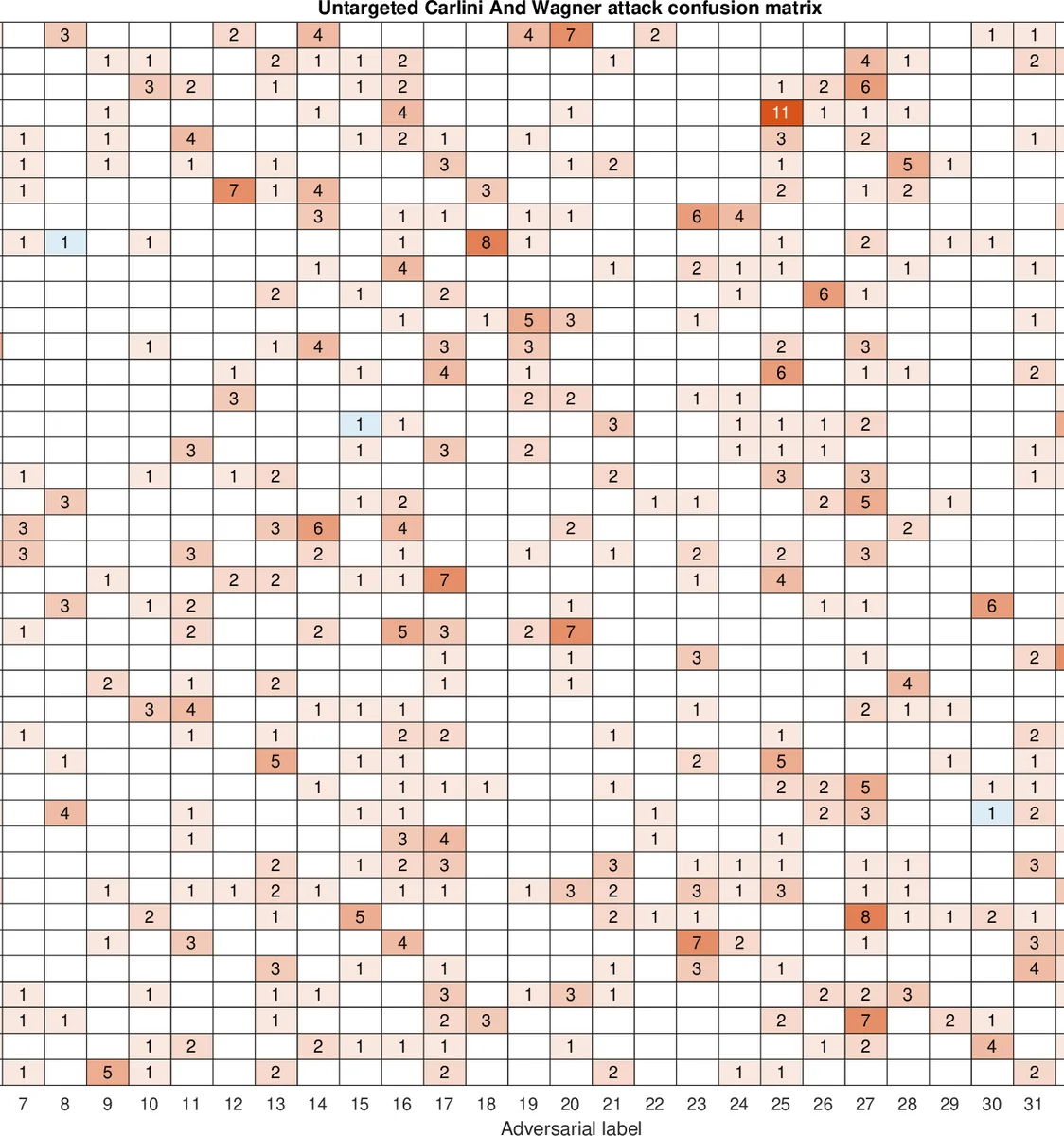

공격 방법으로는 무표적 공격에 화이트 노이즈, Fast Gradient Sign Method(FGSM), Deepfool, Carlini‑Wagner(C&W) 네 가지를 적용했으며, 표적 공격에는 L‑BFGS와 C&W를 사용하였다. 모든 공격은 완전한 모델 지식(white‑box) 하에 수행되었고, 이후 Deepfool과 C&W로 생성된 적대적 샘플을 다른 모델에 적용해 전이성을 평가함으로써 zero‑knowledge 상황을 시뮬레이션했다.

실험 결과는 몇 가지 중요한 인사이트를 제공한다. 첫째, Deepfool과 C&W는 성공률이 99% 이상으로 거의 완벽에 가까웠으며, 평균 SNR이 0.3~0.7 dB 수준에 머물러 인간 청취자가 차이를 감지하기 어렵다. 이는 음성 신호가 고차원 특성을 가지고 있어 작은 선형 변형만으로도 모델의 결정 경계에 크게 영향을 미칠 수 있음을 의미한다. 둘째, FGSM은 화이트 노이즈보다 높은 성공률을 보였지만, 여전히 Deepfool·C&W에 비해 낮은 신뢰도와 높은 SNR을 보였다. 이는 빠른 1‑step 공격이 효율성은 높지만 정밀도에서는 한계가 있음을 시사한다.

입력 형태별 차이도 눈에 띈다. 로그멜 스펙트로그램을 사용하는 dense‑mel 모델은 가장 높은 SNR(≈0.36 dB)에서 성공했으며, 이는 스펙트로그램 변환 과정에서 정보 손실이 발생해 공격에 더 취약해질 수 있음을 암시한다. 반면 원시 파형을 직접 처리하는 dense‑wav 모델은 상대적으로 낮은 SNR(≈0.31 dB)에서 성공했으며, 이는 파형 기반 모델이 시간‑주파수 구조를 보다 풍부하게 보존해 어느 정도 방어 효과를 제공한다는 점을 보여준다.

표적 공격은 무표적에 비해 성공률이 크게 낮았다. L‑BFGS는 평균 SNR이 56 dB에 달했으며, C&W도 45 dB 수준으로 표적 전환에 더 큰 왜곡이 필요했다. 특히 스네어 드럼을 다른 클래스로 전환하려면 가장 높은 SNR이 요구되었는데, 이는 스네어의 특유의 급격한 에너지 피크가 모델이 쉽게 구분할 수 있는 특징임을 반영한다. 그러나 악기 간 음향적 유사성이 공격 난이도와 직접적인 상관관계를 보이지 않아, 적대적 샘플이 단순히 인간 청각적 유사성에 기반하지 않고 모델 내부의 비선형 경계에 의해 결정된다는 결론을 뒷받침한다.

전이성 실험에서는 Deepfool과 C&W로 만든 적대적 샘플이 다른 모델에 적용될 때 전이율이 5~10% 수준에 머물렀다. 이는 각 모델이 학습한 특성 공간이 크게 다르며, 동일한 적대적 변형이 모든 모델에 동일하게 작용하지 않음을 의미한다. 따라서 공격자는 목표 모델에 맞춘 맞춤형 적대적 샘플을 생성해야 할 필요가 있다.

전체적으로 이 논문은 음성 이벤트 분류 시스템이 현재 사용되는 딥러닝 모델에 대해 매우 취약함을 입증한다. 높은 성공률과 낮은 SNR은 실시간 감시, 자율 주행 차량, 콘텐츠 필터링 등 보안이 중요한 응용 분야에서 심각한 위험 요소가 될 수 있다. 향후 연구는 방어 메커니즘(예: adversarial training, 입력 정규화, 모델 앙상블)과 더불어, 공격자가 제한된 지식(zero‑knowledge) 하에서도 효과적인 적대적 샘플을 생성할 수 있는 방법을 탐구해야 할 것이다.

댓글 및 학술 토론

Loading comments...

의견 남기기