텍스트 기반 제로샷 오디오 분류

초록

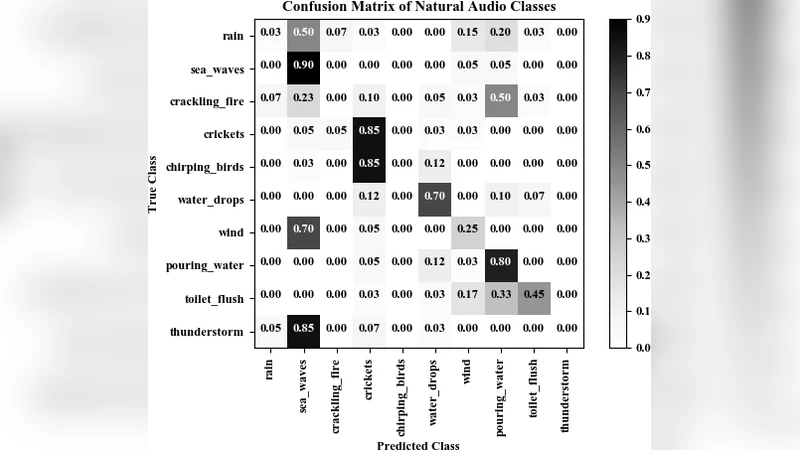

본 논문은 대상 클래스의 오디오 샘플 없이도 텍스트 라벨만으로 음성 인식을 수행하는 제로샷 학습 프레임워크를 제안한다. VGGish로 추출한 오디오 특징과 Word2Vec으로 만든 라벨 임베딩을 이중선형 모델에 입력해 호환성을 측정한다. ESC‑50 데이터셋에서 평균 26 %의 정확도를 달성했으며, 자연음 클래스에서는 39.7 %까지 상승한다.

상세 분석

이 연구는 “오디오 ↔ 텍스트” 양쪽의 의미 공간을 정량화하고, 두 임베딩 사이의 상호작용을 이중선형(bilinear) 형태로 모델링한다는 점에서 혁신적이다. VGGish는 사전학습된 CNN 기반 오디오 피처 추출기로, 멜스펙트로그램을 128‑차원 벡터로 압축한다. 이 벡터는 음향 신호의 시간‑주파수 구조를 보존하면서도 차원 축소 효과를 제공한다. 반면 클래스 라벨은 Word2Vec을 이용해 300‑차원 의미 벡터로 변환한다. Word2Vec은 대규모 텍스트 코퍼스에서 단어 간 의미적 유사성을 학습하므로, “dog bark”와 “wolf howl” 같은 라벨이 서로 가깝게 매핑된다.

이중선형 모델은 입력된 오디오 임베딩 x와 라벨 임베딩 y 사이에 매개변수 행렬 W를 두고, 점수 s = xᵀWy 로 정의한다. 여기서 W는 두 임베딩 공간을 연결하는 변환 역할을 하며, 학습 과정에서 목표 라벨에 대한 점수를 높이고 비목표 라벨에 대한 점수를 낮추는 순위 손실(rank loss) 혹은 교차 엔트로피 손실을 최소화한다. 제로샷 상황에서는 학습 단계에서 본 적 없는 라벨 y에 대해 W가 일반화될 수 있도록, 라벨 임베딩 자체가 풍부한 의미 정보를 담고 있어야 한다. 따라서 라벨 텍스트가 충분히 구체적이고, Word2Vec이 학습된 코퍼스와 일치할수록 성능이 향상된다.

실험은 ESC‑50 데이터셋을 5‑fold 교차 검증 방식으로 수행했으며, 훈련 클래스와 테스트 클래스를 겹치지 않게 분리했다. 무작위 추측(10 %)에 비해 평균 26 %의 정확도를 기록했으며, 특히 “자연음” 카테고리에서 39.7 %에 달했다. 이는 라벨 간 의미적 연관성이 강한 카테고리일수록 제로샷 전이 효과가 크게 작용한다는 것을 시사한다. 그러나 전체 평균이 아직 실용 수준에 미치지 못하고, 일부 라벨(예: “human voice” vs “speech”)은 의미적 구분이 미세해 성능이 저하된다.

한계점으로는 (1) VGGish가 사전학습된 오디오 도메인에 편향되어 있어, 특수 환경 소리(예: 기계음)에는 표현력이 부족할 수 있다. (2) Word2Vec은 정적 임베딩이라 다중 의미(동음이의어) 구분이 어려워 라벨이 다의어일 경우 오류가 발생한다. (3) 이중선형 모델은 파라미터 수가 dim_x × dim_y 로 급증하므로, 고차원 임베딩을 그대로 사용할 경우 과적합 위험이 있다. 이를 완화하기 위해 차원 축소(예: PCA)나 정규화 기법이 필요하다.

향후 연구 방향은 (가) 멀티모달 사전학습 모델(예: CLIP)과 결합해 오디오와 텍스트를 공동 임베딩 공간에 매핑하는 것, (나) 동적 컨텍스트를 반영하는 Transformer‑기반 라벨 임베딩을 도입해 다의어 문제를 해결하는 것, (다) 메타러닝 기법을 적용해 소수의 훈련 클래스만으로도 새로운 라벨에 빠르게 적응하도록 하는 것이다. 이러한 확장은 제로샷 오디오 인식의 실용성을 크게 높일 것으로 기대된다.

댓글 및 학술 토론

Loading comments...

의견 남기기