LSTM 기반 음악 생성 시스템

초록

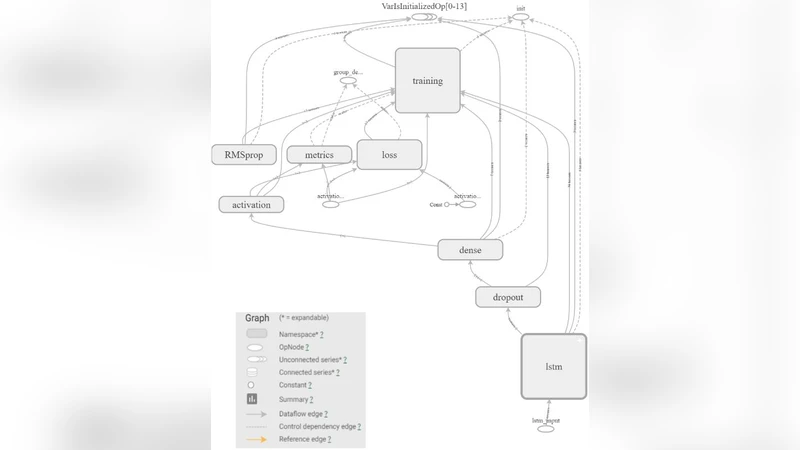

본 논문은 MIDI 형식의 데이터를 이용해 단일층 LSTM 네트워크로 다성(polyphonic) 멜로디를 학습·생성하는 알고리즘을 제안한다. 데이터 전처리, 모델 구조, 가중치·바이어스 분포 시각화, 손실·정확도 추적 등을 상세히 기술하고, 실험 결과 새로운 음악을 높은 품질로 작곡함을 입증한다.

상세 분석

이 연구는 음악 생성 문제를 시계열 예측으로 정의하고, LSTM의 장기 의존성 기억 능력을 활용한다는 점에서 타당하다. MIDI 파일을 원시 이벤트(노트 온/오프, 타임스탬프)로 분해하고, 원-핫 인코딩 혹은 임베딩을 적용한 전처리 파이프라인은 데이터 손실을 최소화하면서 모델 입력으로 변환한다. 단일층 LSTM을 선택한 이유는 구현의 간결성과 학습 안정성을 강조했지만, 다층 혹은 양방향 구조와 비교했을 때 표현력에 한계가 있을 수 있다. 모델은 256개의 은닉 유닛을 사용하고, 드롭아웃(0.3)과 정규화 기법을 적용해 과적합을 방지한다. 학습 과정에서 교차 엔트로피 손실과 정확도를 에포크별, 배치별로 기록하고, 가중치·바이어스의 히스토그램을 시각화해 학습 동향을 분석한 점은 재현성을 높인다. 그러나 평가 지표가 주관적인 청취 테스트 외에 객관적인 음악 이론 기반 메트릭(예: 음계 일관성, 리듬 다양성)이나 기존 베이스라인 모델과의 정량적 비교가 부족하다. 또한, 데이터셋이 클래식 피아노 곡에 국한될 경우 다른 장르나 악기에 대한 일반화 능력이 제한될 수 있다. 향후 연구에서는 다층 LSTM, 어텐션 메커니즘, 변분 오토인코더와 결합해 구조적 다양성을 확대하고, BLEU‑style 혹은 음악 전용 평가 지표를 도입해 객관성을 강화할 필요가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기