코퍼스 연관성 샘플링을 활용한 다국어 음성 인식 향상

본 논문은 다국어 음성 인식 모델을 학습할 때, 각 코퍼스 간의 언어·도메인 유사성을 반영한 “코퍼스 연관성 샘플링(Corpus Relatedness Sampling)” 전략을 제안한다. 코퍼스 수준 임베딩을 학습해 코사인 유사도로 유사도를 측정하고, 초기에는 균등 샘플링, 점진적으로 온도를 높여 목표 코퍼스와 유사한 코퍼스를 더 많이 샘플링한다. 16개의 저자원 코퍼스에 대해 기존 사전학습‑미세조정 파이프라인보다 평균 1.6% PER(Phon…

저자: Xinjian Li, Siddharth Dalmia, Alan W. Black

본 연구는 저자원 언어의 음성 인식 성능을 향상시키기 위해, 다국어 acoustic model을 학습할 때 코퍼스 간의 연관성을 고려한 새로운 샘플링 전략인 “코퍼스 연관성 샘플링(Corpus Relatedness Sampling, CRS)”을 제안한다. 기존의 다국어 모델 학습 방식은 (1) 모든 코퍼스를 균등하게 샘플링해 하나의 대규모 모델을 사전학습(pretrain)하고, (2) 목표 코퍼스에 대해 별도로 fine‑tuning 하는 두 단계로 이루어진다. 이러한 접근은 각 코퍼스가 가지고 있는 언어적·도메인적 특성을 활용하지 못한다는 한계가 있다. 예를 들어, 전화 대화 데이터는 다른 전화 대화 데이터와, 같은 언어의 방송 데이터와는 다른 연관성을 가질 수 있다.

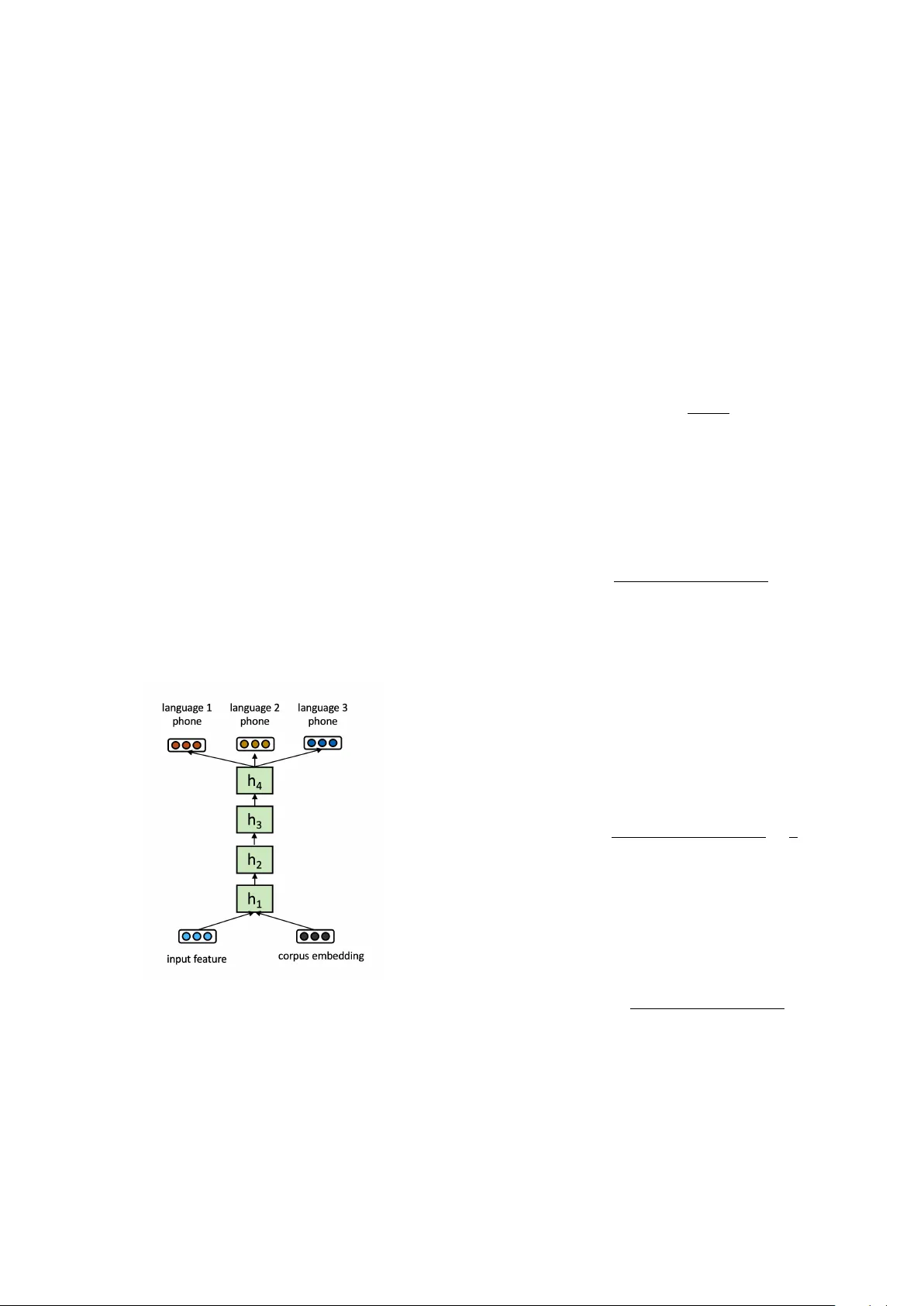

이를 해결하기 위해 논문은 두 가지 핵심 아이디어를 제시한다. 첫 번째는 “코퍼스 임베딩”이다. 각 코퍼스 C_i에 대해 고정 차원의 벡터 e_i를 초기화하고, 음성 입력 x에 e_i를 더해 Encoder(LSTM)로 전달한다. 이렇게 하면 임베딩 e_i가 모델 파라미터와 함께 학습되며, 코퍼스의 언어·도메인 특성을 내포하게 된다. 두 번째는 이 임베딩을 이용한 샘플링 확률 계산이다. 목표 코퍼스 C_t와 각 코퍼스 C_i 사이의 코사인 유사도 score(C_i, C_t)를 구하고, 이를 온도 T가 적용된 소프트맥스 함수에 넣어 P(C_i)=softmax(T·score(C_i, C_t))를 얻는다. 온도 T는 샘플링 분포의 평탄도를 조절한다. T=0이면 모든 코퍼스가 균등하게 선택돼 기존 사전학습과 동일하고, T→∞이면 목표 코퍼스만 선택돼 fine‑tuning과 동일한 효과를 만든다.

훈련 과정에서는 초기 온도 T₀를 매우 낮게 설정하고(예: 0.01), 매 epoch마다 성장률 a(예: 1.5)를 곱해 온도를 점진적으로 상승시킨다. 초기에는 다양한 코퍼스의 정보를 폭넓게 학습하고, 훈련이 진행될수록 목표 코퍼스와 높은 유사도를 가진 코퍼스가 더 많이 선택돼 목표 도메인에 특화된 모델로 수렴한다. 이 방식은 기존의 두 단계 파이프라인을 하나의 연속적인 최적화 과정으로 통합하면서, 과적합을 방지하는 내재적 정규화 효과도 제공한다.

실험은 10개 언어(영어, 중국어, 암하라어, 벵골어, 네덜란드어, 독일어, 스페인어, 스와힐리어, 터키어, 줄루어)에서 총 16개의 코퍼스를 사용했다. 각 코퍼스는 전화, 읽기, 방송 등 3가지 도메인으로 라벨링했으며, 모든 코퍼스에서 100,000 utterance를 무작위 추출해 학습에 사용하였다. 모델은 6층 bidirectional LSTM(각 층 320 셀) 기반 CTC 구조이며, 평가 지표는 Phone Error Rate(PER)이다.

표 2의 결과는 사전학습 모델(pretrain), fine‑tuned baseline, 제안된 CRS 세 모델을 비교한다. 평균 PER은 각각 26.7%, 20.1%, 18.5%이며, CRS가 기존 fine‑tuning 대비 평균 1.6%p(절대) 개선했다. 특히 소규모 코퍼스(예: Dutch, Amharic)에서 큰 폭의 개선이 관찰되었으며, 이는 온도 스케줄이 과적합을 억제하고 연관 코퍼스의 보조 정보를 효과적으로 활용했기 때문이다.

코퍼스 임베딩 자체의 유용성도 별도로 검증했다. 표 3과 Figure 2는 임베딩 기반 코사인 유사도가 언어 수준(영어‑영어, 중국어‑중국어)과 도메인 수준(전화‑전화, 읽기‑읽기)에서 높은 일치를 보임을 보여준다. t‑SNE 시각화에서는 동일 언어·도메인 코퍼스가 클러스터를 형성해, 임베딩이 의미 있는 구조적 정보를 학습했음을 확인한다.

결론적으로, 이 논문은 (1) 코퍼스 수준 임베딩을 통해 다국어 음성 모델에 언어·도메인 정보를 주입하고, (2) 온도 기반 샘플링 스케줄을 통해 초기 전역 학습과 목표 특화 학습을 자연스럽게 연결함으로써, 기존의 두 단계 파이프라인을 하나의 연속적인 최적화 과정으로 통합한다는 점에서 혁신적이다. 구현이 간단하고 기존 모델 구조에 최소한의 수정만으로 적용 가능하다는 실용적 장점도 갖는다. 향후 연구에서는 임베딩 차원을 늘리거나, 다른 거리 측정법을 적용해 더 정교한 유사도 모델을 탐색하고, 언어 모델과 결합한 end‑to‑end 시스템에 적용하는 방향이 제시된다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기