대규모 베이지안 비선형 행렬 완성

본 논문은 희소하고 거대한 행렬에 대해 비선형 관계를 모델링하는 베이지안 프레임워크를 제시한다. Gaussian Process Latent Variable Model(GP‑LVM)을 기반으로 하여, 데이터 파티셔닝과 증분 학습, 그리고 제한된 통신을 이용한 분산 구현을 설계한다. 각 파티션에서 학습된 서브 모델들을 Product‑of‑Experts(PoE) 방식으로 결합함으로써, 확장성은 유지하면서도 불확실성 추정과 자동 복잡도 제어를 제공한다…

저자: Xiangju Qin, Paul Blomstedt, Samuel Kaski

본 논문은 대규모이고 매우 희소한 행렬에 대한 비선형 행렬 완성 문제를 베이지안 관점에서 해결하고자 한다. 전통적인 행렬 완성 방법은 선형 가정을 기반으로 하여, 관측되지 않은 원소를 잠재 변수 X와 가중치 행렬 W의 선형 결합으로 예측한다. 베이지안 접근은 이러한 선형 모델에 자동 복잡도 제어와 과적합 방지를 제공하지만, 비선형 관계를 모델링하려면 Gaussian Process Latent Variable Model(GP‑LVM)을 활용해야 한다. 기존의 베이지안 GP‑LVM은 차원 축소와 잠재 표현 학습에 성공했지만, 희소 행렬에 적용하기엔 변분 업데이트를 열마다 별도로 수행해야 하는 계산량이 크게 늘어나 확장성이 부족했다.

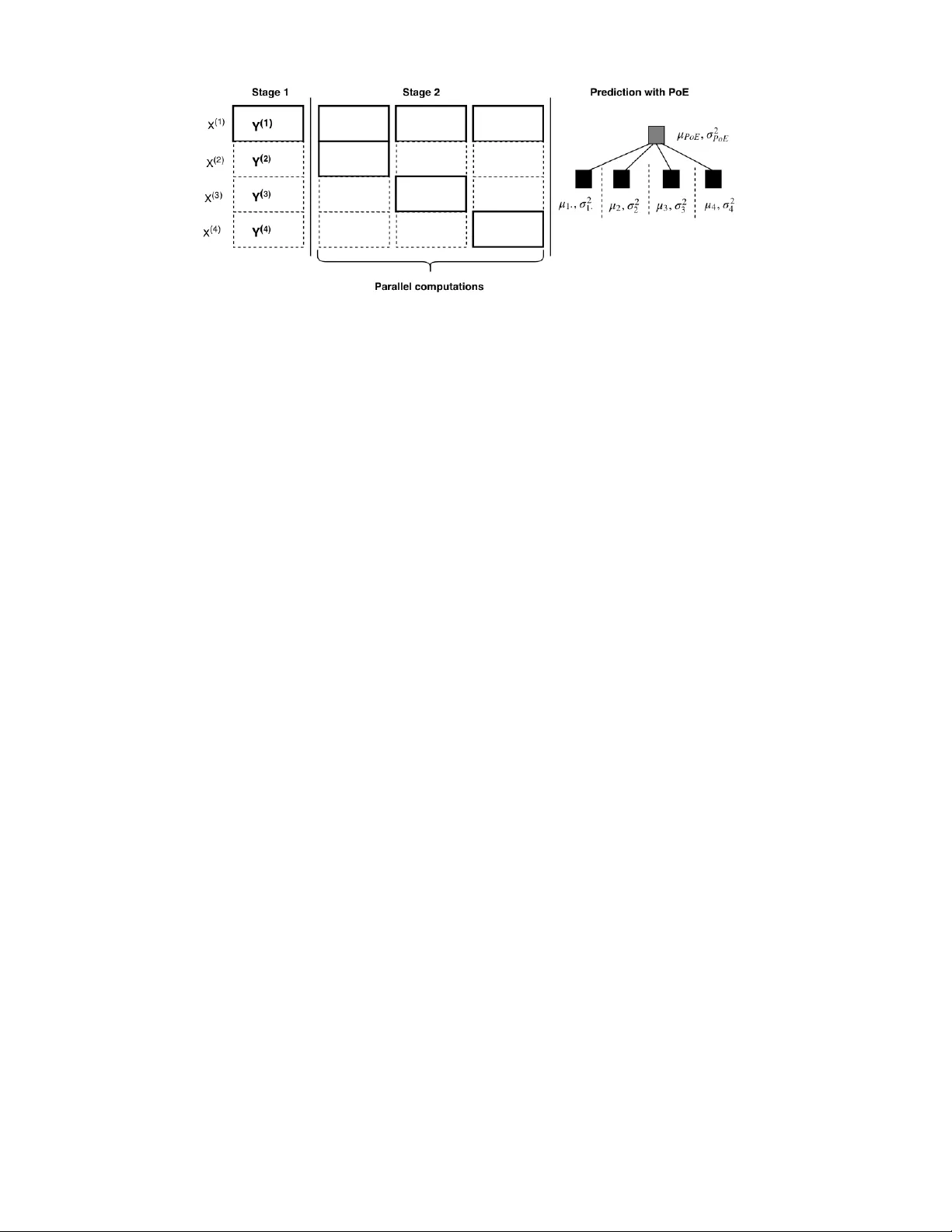

이를 해결하기 위해 저자들은 다음과 같은 세 가지 핵심 기법을 제안한다. 첫째, 전체 행렬 Y를 I개의 서로 겹치지 않는 서브셋 Y(1)…Y(I)로 분할한다. 초기 단계에서는 하나의 서브셋 Y(1)만을 사용해 잠재 변수 X(1)와 인듀싱 포인트, 커널 하이퍼파라미터를 학습한다. 이때 변분 사후분포 q(X(1))를 얻으며, 이는 이후 단계의 초기값으로 활용된다. 둘째, 나머지 서브셋들을 병렬로 처리하면서 증분 학습(incremental learning)을 적용한다. 기존 증분 학습에서는 X(1)와의 차이를 Frobenius norm으로 정규화했지만, 본 논문은 변분 사후분포 간 KL divergence을 정규화 항으로 사용한다. 즉, q(X(1))가 ˆq(X(1))와 크게 달라지지 않도록 제한함으로써, 각 워커가 독립적으로 연산하면서도 초기 서브셋의 정보를 유지한다. 셋째, 예측 단계에서는 각 서브 모델을 독립적인 GP 전문가로 보고 Product‑of‑Experts(PoE) 방식을 적용한다. PoE는 각 전문가의 예측 분포를 곱해 정규화된 Gaussian으로 결합하는데, 여기서는 첫 번째 서브셋이 여러 번 사용된 효과를 보정하기 위해 “corrected PoE”를 도입한다. 구체적으로, 첫 번째 서브셋의 사후를 한 번만 남기고 나머지 서브셋들의 사후를 보정하여 평균과 분산을 재계산한다.

또한, 저자들은 중간 단계에서 서브 모델들을 집계(aggregation)하는 전략을 제시한다. 증분 학습을 통해 잠재 변수의 식별성을 어느 정도 확보했기 때문에, 각 서브 모델의 변분 분포와 하이퍼파라미터를 평균·최빈값 등으로 합산해 하나의 통합 모델을 만든 뒤, 최종 PoE 예측에 활용한다. 이 과정은 PoE가 블록 대각 행렬 근사에 머무르는 한계를 완화하고, 더 큰 서브 모델을 사용함으로써 전체 데이터의 공분산 구조를 더 정확히 반영한다.

복잡도 측면에서, 각 서브셋의 크기를 N_i, 인듀싱 포인트 수를 M(

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기