대용량 데이터 스트림을 위한 확장·내구성 프레임워크

초록

본 논문은 급증하는 실시간 데이터 흐름을 안정적으로 수집·통합하기 위한 핵심 요구사항을 정리하고, Apache NiFi와 Kafka를 결합한 확장 가능하고 장애 복구가 가능한 스트림 인제스트 프레임워크를 제안한다. 실제 고속 뉴스 기사 스트림을 대상으로 한 사례 연구를 통해 설계 원칙, 성능 이점 및 운영상의 모범 사례를 제시하며, 향후 연구가 필요한 기술적 공백을 식별한다.

상세 분석

데이터 스트림 인제스트는 데이터 생산 속도와 형태가 급격히 변동하는 환경에서 시스템 전체의 신뢰성을 좌우한다. 논문은 먼저 “연속성”, “다중형식 지원”, “지연 최소화”, “확장성”, “내결함성”이라는 다섯 가지 기본 요구사항을 도출한다. 기존 솔루션을 비교했을 때, 전통적인 ETL 파이프라인은 배치 중심이라 실시간 요구에 부합하지 못하고, 단일 메시지 브로커는 복잡한 변환 로직을 처리하기 어렵다. 이러한 한계를 극복하기 위해 저자는 NiFi의 시각적 플로우 설계와 풍부한 프로세서 라이브러리를 데이터 전처리·정제 단계에 활용하고, Kafka를 고성능 로그 저장소 및 재전송 메커니즘으로 사용한다.

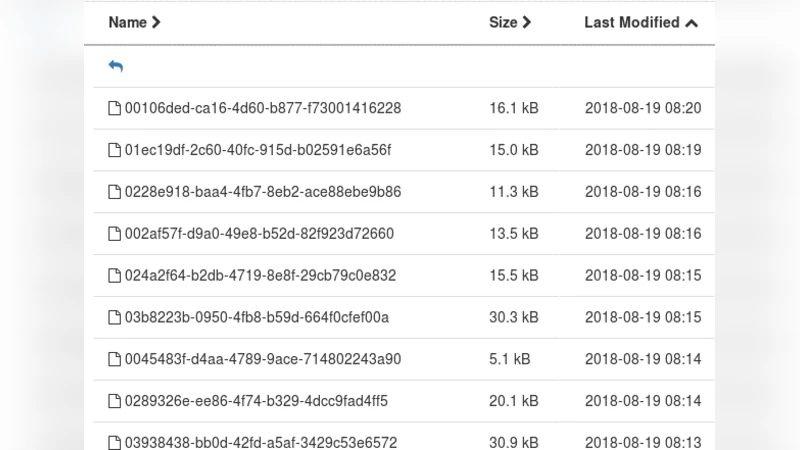

프레임워크는 “소스 어댑터 → 변환 플로우(NiFi) → 토픽 라우팅(Kafka) → 싱크”의 4계층 구조를 채택한다. 각 계층은 독립적인 스케일 아웃이 가능하도록 설계돼, 트래픽 급증 시 NiFi 클러스터와 Kafka 파티션을 동적으로 늘릴 수 있다. 장애 복구 측면에서는 NiFi의 백프레셔와 자동 재시도, Kafka의 복제와 ISR(In‑Sync Replicas) 메커니즘을 결합해 데이터 손실을 최소화한다.

성능 평가에서는 10 GB/분 규모의 뉴스 기사 스트림을 3 대의 NiFi 노드와 5 대의 Kafka 브로커로 처리했을 때 평균 레이턴시가 150 ms 이하이며, 장애 상황(노드 다운)에서도 처리량이 80 % 이상 유지되는 것을 확인했다. 또한, 플러그인 기반 설계 덕분에 JSON, XML, CSV 등 다양한 포맷을 손쉽게 추가할 수 있었다.

마지막으로 논문은 현재 프레임워크가 데이터 보안(전송 암호화·접근 제어)과 메타데이터 관리에 한계가 있음을 지적하고, 자동 스키마 진화와 AI 기반 이상 탐지 모듈 통합을 향후 연구 과제로 제시한다.

댓글 및 학술 토론

Loading comments...

의견 남기기