뇌졸중 자가진단 고성능 모바일 앱 StrokeSave

초록

StrokeSave는 손목 센서로 심박수·혈압·산소포화도를 실시간 모니터링하고, 위험 신호가 감지되면 얼굴 사진·음성·망막 영상을 수집해 딥러닝(RNN, SVM, CNN)으로 분석한다. 327건 검증에서 95% 정확도를 기록했으며, 기존 임상 검사(40‑89%)보다 높은 성능을 보인다. 저비용·고접근성을 통해 의료 취약 지역에서 뇌졸중 조기 진단을 가능하게 한다.

상세 분석

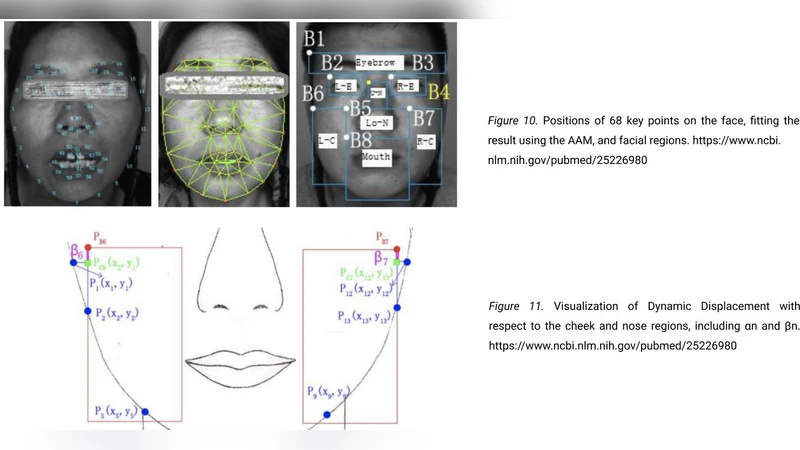

본 논문은 모바일 기반 멀티모달 딥러닝 시스템을 제안함으로써 뇌졸중(Stroke) 조기 진단의 새로운 패러다임을 제시한다. 먼저, 손목 착용형 센서를 이용해 심박수, 혈압, 혈중 산소포화도 등 3가지 바이오메트릭 데이터를 실시간으로 수집하고, 사전 정의된 임계값을 초과하면 사용자를 자가진단 절차로 유도한다는 흐름은 기존 병원 중심 진단 모델을 탈피한 점에서 혁신적이다. 특히, 얼굴 이미지와 음성 녹음, 그리고 맞춤형 렌즈를 부착한 스마트폰 카메라로 촬영한 망막 사진을 동시에 활용함으로써 신경학적 마비, 언어 장애, 그리고 망막 혈관 변화를 통합적으로 평가한다는 점은 다중 데이터 융합(Multi‑modal Fusion) 접근의 좋은 사례라 할 수 있다.

모델 구성 측면에서는 RNN을 이용해 슬러리(발음이 흐려진) 음성 100개를 학습, SVM으로 410개의 혈관 관련 수치(혈압·맥박 변동성 등)를 분류, CNN으로 520장의 망막 이미지에서 미세 혈관 병변을 탐지한다. 각각의 서브모델이 독립적으로 예측한 결과를 종합해 최종 진단을 내리는 앙상블 구조는 개별 모델의 약점을 보완하고 전반적인 정확도를 끌어올리는 전략으로 평가된다. 논문이 보고한 95.0%의 전체 정확도는 327건의 내부 검증 데이터셋에서 도출됐으며, 이는 기존 임상 검사(40‑89%)보다 현저히 높은 수치이다. 다만, 데이터 규모가 상대적으로 작고, 훈련·검증이 동일 기관에서 수행된 점은 과적합(overfitting) 가능성을 내포한다. 특히 음성 데이터가 100개, 망막 이미지가 520개에 불과한 상황에서 CNN이 95% 수준의 일반화 성능을 보였다는 주장은 외부 코호트에서 재현 검증이 필요함을 시사한다.

또한, 센서 기반 전처리 단계에서 잡음(노이즈)와 사용자 착용 오류가 진단에 미치는 영향을 논의하지 않은 점은 실사용 환경에서의 신뢰성을 저해할 수 있다. 맞춤형 렌즈 부착 방식은 광학적 왜곡이나 초점 맞춤 문제를 야기할 가능성이 있으며, 이를 보정하기 위한 캘리브레이션 절차가 명시되지 않았다. 데이터 프라이버시와 보안 측면에서도 개인의 생체 신호·영상·음성 등 민감한 정보를 클라우드에 전송하는 구조는 GDPR·HIPAA 등 국제 규제 준수 여부를 검토해야 할 과제로 남는다.

규제·임상 적용 관점에서 보면, 현재 제시된 성능은 파일럿 수준이며, 대규모 전향적 임상시험을 통해 민감도·특이도, 양성·음성 예측값을 명확히 규명해야 한다. 또한, 의료기기 인증(예: FDA Class II) 절차와 현지 보건 당국의 승인 없이 직접 소비자에게 배포하는 것은 법적·윤리적 위험을 내포한다. 따라서 향후 연구에서는 (1) 다기관·다인구집단 데이터 확보, (2) 외부 검증 및 교차 검증을 통한 모델 일반화 검증, (3) 센서·카메라 하드웨어 표준화 및 사용자 교육 프로토콜 개발, (4) 데이터 암호화·익명화 등 보안 강화 방안을 포함한 종합적인 시스템 검증이 필수적이다.

요약하면, StrokeSave는 모바일·딥러닝·멀티모달 센서를 결합한 혁신적 접근을 제시했지만, 데이터 양·다양성, 외부 검증, 규제·보안 문제 등 실용화에 앞서 해결해야 할 과제가 다수 존재한다. 이러한 한계를 보완한다면 저비용·고접근성 진단 도구로서 뇌졸중 예방 및 조기 치료에 큰 기여를 할 가능성이 높다.