음성인식과 화자다이어리제이션 통합 모델

초록

본 논문은 의료 대화와 같은 다중 화자 환경에서 자동음성인식(ASR)과 화자다이어리제이션(SD)을 별도 시스템이 아닌 하나의 RNN‑T 모델로 동시에 수행하는 방법을 제안한다. 음향 신호와 언어 정보를 모두 활용해 화자 역할 토큰(spk:dr, spk:pt)을 단어와 함께 출력함으로써 전통적인 파이프라인 대비 단어 수준 화자 오류율(WDER)을 15.8%에서 2.2%로 크게 감소시켰다.

상세 분석

이 연구는 기존의 ASR‑SD 파이프라인이 갖는 구조적 한계를 정확히 짚어낸다. 전통적인 시스템은 (1) 음성 인식, (2) 화자 구분, (3) 두 결과의 정합이라는 세 단계로 이루어지며, 각각 독립적인 목표함수와 학습 데이터를 사용한다. 특히 SD 단계는 음향 특징만을 이용해 화자 변화를 탐지하고, 클러스터링을 통해 화자 라벨을 부여한다. 이 과정에서 단어 경계와 무관하게 화자 라벨이 할당되기 때문에, 화자 전환이 단어 중간에 발생하면 오류가 누적된다.

논문은 이러한 문제점을 해결하기 위해 RNN‑Transducer(RNN‑T)를 기반으로 한 end‑to‑end 모델을 설계한다. RNN‑T는 CTC의 블랭크 메커니즘을 확장해 출력 간 의존성을 모델링하고, 별도의 언어 모델 없이도 시퀀스 간 상관관계를 학습한다. 핵심 아이디어는 출력 어휘에 화자 역할 토큰을 추가하는 것으로, 모델은 음성 프레임을 인코더가 고차원 표현으로 변환하고, 이전 출력(단어·화자 토큰)을 기반으로 예측 네트워크가 다음 토큰을 생성한다. 공동 네트워크는 인코더와 예측 네트워크의 출력을 결합해 최종 소프트맥스 확률을 산출한다.

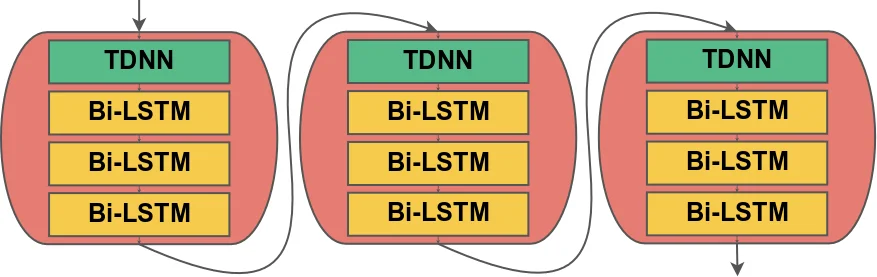

데이터 전처리 측면에서 저자들은 15초 이하의 짧은 오디오 세그먼트로 긴 대화를 슬라이딩 윈도우 방식으로 분할하고, 각 세그먼트에 화자 역할이 부착된 형태소 기반 전사본을 목표 시퀀스로 사용한다. 형태소 단위는 단어보다 짧아 시간 해상도를 유지하면서도, 단어보다 길어 출력 시퀀스 길이를 크게 줄여 학습 효율성을 높인다. 인코더는 80차원 로그멜 스펙트로그램을 입력으로 받아 TDNN‑LSTM 블록(1D Conv → 3×Bi‑LSTM)으로 구성되며, 시간 해상도를 10 ms에서 80 ms로 축소한다. 예측 네트워크는 4 K 형태소 어휘를 512 차원 임베딩으로 매핑한 뒤, 1024‑유닛 단방향 LSTM과 512‑유닛 완전 연결층을 거쳐 토큰 확률을 계산한다.

학습은 대규모 의료 대화 코퍼스(≈15 000 시간, 100 K 대화)와 128개의 TPU를 활용해 2일 이내에 수렴시켰으며, 손실 함수는 TensorFlow 구현의 RNN‑T loss를 사용해 전방‑후방 알고리즘을 효율적으로 수행한다. 평가에서는 기존 RNN‑T 기반 ASR만을 사용한 베이스라인과, 전통적인 5단계 SD 파이프라인(음성 검출, 임베딩, 변환점 탐지, k‑means 클러스터링, ASR‑SD 정합)을 비교하였다. 새로운 평가 지표인 Word Diarization Error Rate(WDER)를 도입해, 단어 수준에서 화자 라벨이 얼마나 정확히 매핑되는지를 측정하였다. 결과는 WDER가 15.8%에서 2.2%로 86% 상대 개선되었으며, WER는 0.6%만 증가하는 트레이드오프를 보였다. 이는 화자 라벨링이 단어 경계와 직접 연계됨으로써 시간 기반 DER의 누적 오류를 크게 억제했음을 의미한다.

이 접근법은 화자 역할이 언어적 패턴과 강하게 연관된 도메인(예: 의료, 고객 상담)에서 특히 효과적이다. 화자 역할 토큰을 학습 목표에 포함함으로써 모델은 “의사는 질문을, 환자는 답변을”과 같은 대화 구조를 스스로 학습한다. 또한, RNN‑T의 구조적 장점 덕분에 추가적인 화자 변환 탐지 모듈이나 클러스터링 단계가 필요 없으며, 전체 파이프라인이 하나의 신경망으로 통합돼 실시간 배포와 유지보수가 용이해진다. 향후 연구에서는 다중 화자(3명 이상) 상황, 화자 역할이 불명확한 자유 대화, 그리고 비언어적 신호(음성 강도, 억양)와의 융합을 통해 모델의 일반화 능력을 확장할 여지가 있다.

댓글 및 학술 토론

Loading comments...

의견 남기기