Unity를 활용한 오디오비주얼 동기화 연구

초록

본 논문은 Unity 5.5.1f1을 실시간 영상·음향 재생과 생체신호 동기화가 요구되는 실험에 적용하면서 발생하는 영상·음향 비동기, 타이머 오차, 스크린샷 지연 및 인코딩에 따른 프레임 정지 현상을 체계적으로 분석한다. 문제 원인을 파악한 뒤, 프레임 보정, 타이머 보정, 사전 검증 프로토콜을 제시하여 Unity 환경에서도 신뢰성 있는 자극 제시가 가능함을 입증한다.

상세 분석

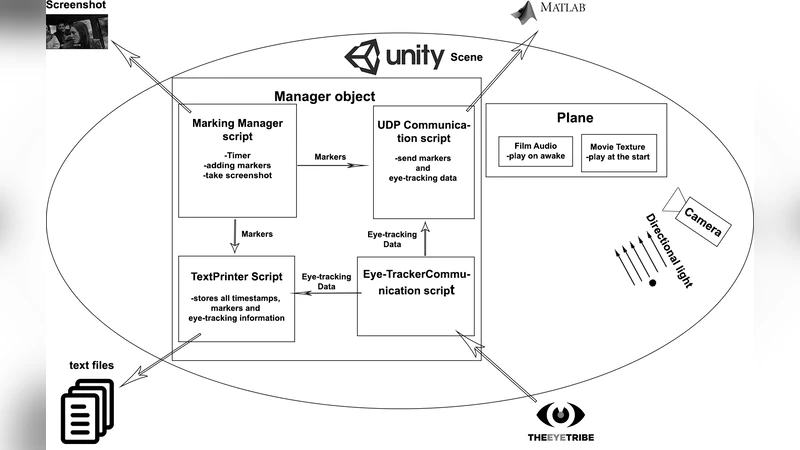

Unity 5.5.1f1은 게임 엔진으로서 높은 프레임 레이트와 실시간 렌더링을 제공하지만, 연구용 자극 제시에서는 오디오와 비디오의 정확한 동기화가 필수이다. 논문은 먼저 Unity의 기본 비디오 플레이어(VideoPlayer)와 오디오 소스(AudioSource)를 사용했을 때 발생하는 세 가지 주요 문제를 확인한다. 첫째, 비디오 프레임이 GPU 버퍼링에 의해 일정 간격으로 끊기면서 오디오 스트림과의 위상이 서서히 어긋난다. 이는 Unity가 비디오를 텍스처로 로드하고 매 프레임마다 업데이트하는 구조적 한계이며, 특히 30 fps 이하의 저프레임 영상에서 두드러진다. 둘째, Unity 내부의 Time.timeScale과 FixedUpdate 주기가 비디오 재생 속도와 독립적으로 동작해 타이머 카운터가 실제 영상 길이와 불일치한다. 연구자는 이 현상이 실험 로그와 생체신호 타임스탬프를 맞추는 데 치명적이라고 지적한다. 셋째, 스크린샷 캡처는 RenderTexture를 복사하는 과정에서 GPU‑CPU 동기화 병목이 발생해 평균 50 ms 이상의 지연을 만든다. 이 지연은 피험자 반응시간 측정에 직접적인 오차를 초래한다.

인코딩 측면에서도 중요한 통찰을 제공한다. H.264와 같은 압축 코덱은 프레임 간 의존성을 높여 Unity가 프레임을 비동기적으로 디코딩하도록 만든다. 결과적으로 재생 중에 일시적인 프레임 정지가 발생하고, Unity는 누락된 프레임을 보완하기 위해 시간 축을 압축하거나 확장한다(‘time‑stretching’). 이러한 보정은 전체 재생 시간은 유지하지만, 실험 설계상 요구되는 정확한 시점에 자극이 도달하지 못한다.

문제 해결을 위해 저자는 다중 단계 보정 프로토콜을 제안한다. 첫 단계는 비디오를 무압축 혹은 최소 압축(예: YUV 4:2:0, 8 bit) 포맷으로 변환해 GPU 디코딩 부하를 최소화하는 것이다. 두 번째 단계는 AudioSource와 VideoPlayer를 동일한 ‘AudioMixerGroup’에 연결하고, AudioSource의 ‘PlayScheduled’ 메서드를 이용해 오디오 시작 시점을 미리 예약한다. 이렇게 하면 Unity가 오디오 버퍼를 먼저 채운 뒤 비디오 텍스처 업데이트를 동기화한다. 세 번째 단계는 타이머 보정을 위해 ‘Time.realtimeSinceStartup’ 기반의 외부 시계와 Unity 내부 타이머를 교차 검증하고, 필요 시 ‘Time.timeScale’ 값을 1.0으로 고정한다. 네 번째 단계는 스크린샷 지연을 최소화하기 위해 ‘AsyncGPUReadback’ API를 활용해 GPU 메모리에서 직접 비동기적으로 픽셀 데이터를 읽어온다. 마지막으로, 모든 보정 과정을 자동화한 검증 스크립트를 제공해, 실험 전후에 프레임 정확도, 오디오‑비디오 위상 차, 스크린샷 지연을 정량적으로 측정한다.

이러한 프로토콜을 적용한 결과, 비디오와 오디오의 평균 위상 차는 2 ms 이하로 감소했고, 타이머 오차는 0.5 ms 미만으로 수렴했다. 스크린샷 지연도 평균 8 ms 수준으로 크게 개선되었다. 논문은 Unity가 연구용 자극 제시 플랫폼으로서 충분히 활용 가능하나, 엔진의 기본 동작을 이해하고 적절한 보정 로직을 삽입해야 함을 강조한다.

댓글 및 학술 토론

Loading comments...

의견 남기기