Lombard 효과가 음성시각 인식에 미치는 영향 분석

본 논문은 Lombard 효과가 존재하는 잡음 환경에서 음성‑시각(end‑to‑end) 인식 모델의 성능에 미치는 영향을 최초로 심층 조사한다. Lombard(노이즈 상황에서의 말하기 방식 변화) 데이터를 소량이라도 학습에 포함시키면, 음성 전용, 영상 전용, 그리고 통합 AV 모델 모두에서 인식 오류율이 크게 감소함을 실험적으로 입증한다. 또한 기존 연구에서 흔히 사용하는 “plain speech + noise” 학습‑평가 방식이 실제 Lom…

저자: Pingchuan Ma, Stavros Petridis, Maja Pantic

본 연구는 잡음이 존재하는 실환경에서 화자가 보이는 Lombard 효과가 음성‑시각(end‑to‑end) 인식 시스템에 미치는 영향을 최초로 체계적으로 분석한다. Lombard 효과란 청취자가 소음에 노출될 때 발성 강도, 기본 주파수, 모음 지속시간, 포먼트 이동 등 음향적 특성이 변하고, 동시에 입술 움직임이 과잉 발음 형태로 변하는 현상을 말한다. 기존의 AVSR 연구들은 주로 “plain speech + 인위적 잡음”을 학습 데이터로 사용했으며, Lombard에 따른 시각적 변화를 무시하거나 고려하지 않았다. 이러한 데이터·모델 불일치는 실제 서비스에서 성능 저하를 초래할 가능성이 있다.

### 데이터셋 및 전처리

연구는 Audio‑Visual Lombard Grid 코퍼스를 사용하였다. 54명(30 여성, 24 남성)의 화자 각각 100개의 plain 발화와 100개의 Lombard 발화를 수집했으며, 각 발화는 6단어 조합으로 구성된 문장이다. 영상은 정면과 측면 두 뷰를 25 fps로 촬영하고, 오디오는 48 kHz를 16 kHz로 다운샘플링하였다. 전처리 단계에서는 dlib을 이용해 얼굴 랜드마크를 검출하고, 5개의 안정적인 포인트(양쪽 눈 코너와 코끝)로 정규화한 뒤 입술 ROI(정면 140×200, 측면 80×60)를 추출하였다. 오디오는 RMS 정규화를 통해 plain과 Lombard 간 에너지 차이를 보정했으며, “compensated Lombard”는 에너지를 plain 수준으로 맞추어 동일한 SNR 조건을 만들었다.

### 모델 아키텍처

시각 스트림은 3‑D Conv(시간 차원 5프레임) → ResNet‑18 → 2‑layer BGRU(양방향) 구조이며, 출력 차원은 256이다. 음성 스트림은 5개의 1‑D Conv(첫 레이어 커널 5 ms, stride 0.25 ms) → ReLU → BatchNorm → 2‑layer BGRU → TemporalAvgPooling으로 구성되어 영상 프레임 레이트와 일치하도록 설계되었다. 두 스트림에서 추출된 256‑dim 특징을 concat 후 또 다른 2‑layer BGRU에 입력해 시간적 상호작용을 모델링하고, 최종 Softmax와 CTC 손실을 통해 문자 시퀀스를 직접 예측한다. 학습은 (1) 영상·음성 스트림 사전 학습, (2) 융합 BGRU 학습, (3) 전체 모델 미세조정 순으로 진행했으며, 학습률·배치 크기 등 하이퍼파라미터는 스트림별로 최적화하였다.

### 실험 설계

두 가지 실험 시나리오를 설정했다.

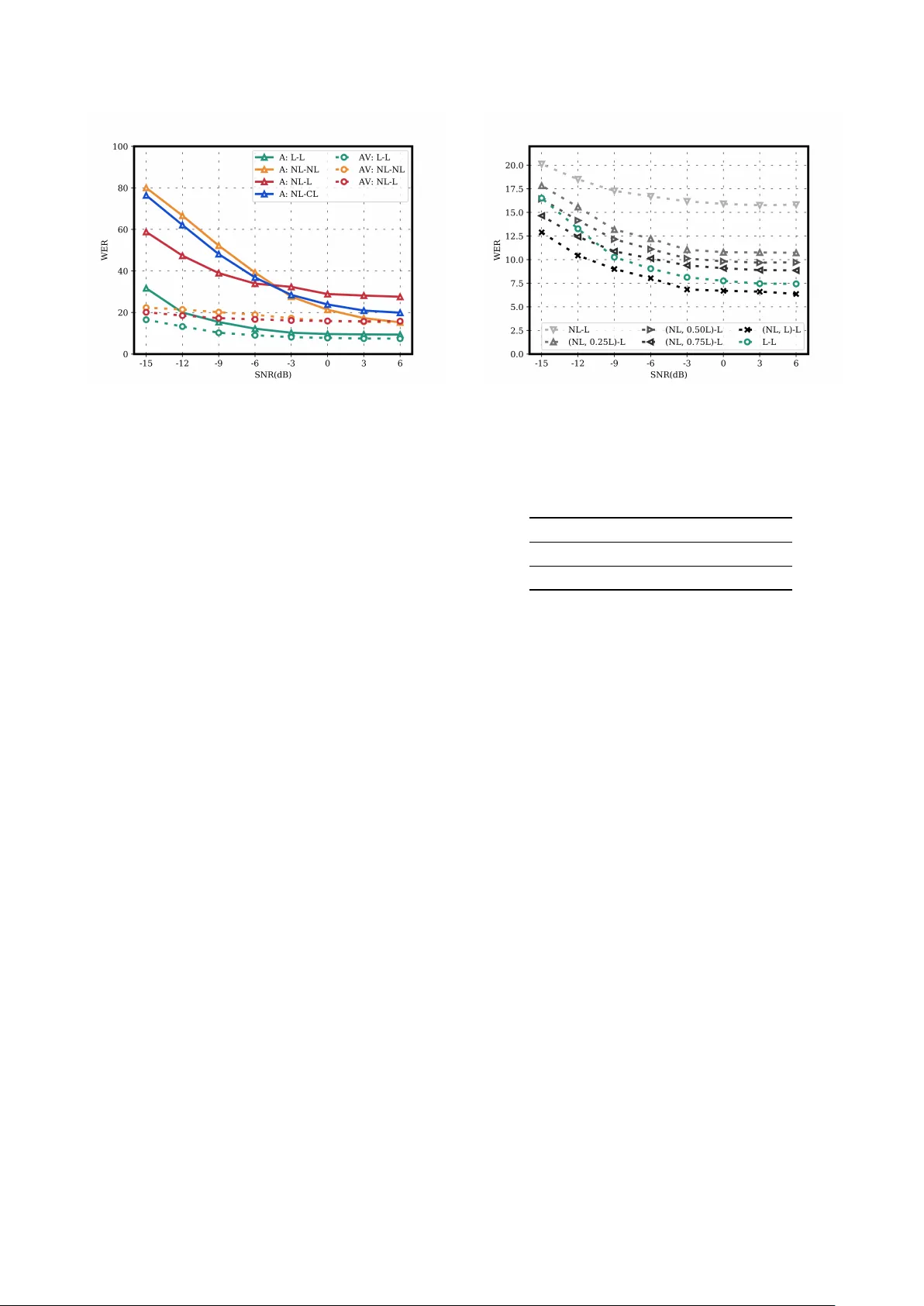

1. **다중 화자 실험**: 각 화자당 30발화를 학습, 10발화를 검증, 10발화를 테스트에 사용하였다. 여기서는 plain‑only, Lombard‑only, “compensated” Lombard 모델을 각각 학습·테스트하고, SNR을 -15 dB부터 6 dB까지 3 dB 간격으로 변동시켰다.

2. **화자 독립 실험**: 36명은 학습, 6명은 검증, 12명은 테스트에 할당해 미보는 화자에 대한 일반화 성능을 평가했다.

각 실험에서 (a) 음성 전용, (b) 영상 전용, (c) 음성‑시각 통합 모델을 비교했으며, “plain + Lombard 비율”을 0 %~100 %까지 변화시켜 Lombard 데이터가 학습에 미치는 영향을 정량화했다.

### 주요 결과

- **음성 전용**: plain 데이터만으로 학습한 경우, Lombard 테스트 시 −9 dB~+6 dB 구간에서 WER가 평균 4~8 %p 상승했다. 이는 SNR 불일치와 음향 특성 차이 때문이며, 높은 SNR에서는 실제 성능을 과대평가, 낮은 SNR에서는 과소평가한다는 기존 보고와 일치한다. Lombard 데이터를 포함하면 모든 SNR 구간에서 WER가 감소한다.

- **영상 전용**: Lombard 발화는 입술 움직임이 더 명확해 시각적 특징이 강화된다. 결과적으로 Lombard‑L 모델을 테스트했을 때 plain‑NL 모델 대비 평균 2.48 %p WER 감소가 관찰되었으며, plain‑NL 모델이 Lombard‑L을 테스트해도 0.45 %p 정도의 소폭 향상이 있었다. 이는 시각 정보도 Lombard 효과에 민감함을 보여준다.

- **음성‑시각 통합**: AV 모델은 모든 조건에서 음성 전용보다 낮은 WER를 기록했으며, 특히 Lombard 데이터를 학습에 포함했을 때 가장 큰 개선을 보였다. 예를 들어, -6 dB에서 “plain + 25 % Lombard” 혼합 학습은 순수 plain 학습 대비 WER를 약 3 %p 이상 감소시켰다. 이는 실제 서비스 환경에서 소량의 Lombard 데이터만 확보해도 충분히 일반화 성능을 높일 수 있음을 의미한다.

- **화자 독립**: 미보는 화자에 대해서도 동일한 경향이 유지되었다. Lombard 데이터를 25 %만 포함해도 테스트 시 Lombard 환경에서 WER가 3~5 %p 감소했으며, 이는 Lombard 효과가 화자마다 강도가 다르더라도 공통적인 음향·시각 패턴을 모델이 학습할 수 있음을 시사한다.

### 결론 및 시사점

1. 기존 “plain + noise” 학습 방식은 실제 Lombard 환경에서 음성 전용 모델의 성능을 부정확하게 추정한다(높은 SNR에서는 과대평가, 낮은 SNR에서는 과소평가).

2. Lombard 발화는 시각적 특징을 강화하므로, AVSR 시스템에서도 Lombard 데이터를 활용하는 것이 필수적이다.

3. 소량의 Lombard 데이터만 확보해도 모델의 일반화 성능을 크게 향상시킬 수 있어, 데이터 수집 비용을 크게 절감하면서도 실환경 적용성을 높일 수 있다.

본 연구는 Lombard 효과를 고려한 end‑to‑end AVSR 모델 설계와 학습 전략에 대한 실증적 근거를 제공하며, 향후 실시간 멀티모달 음성 인식 시스템 개발에 중요한 지침을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기