감정 제어 가능한 합성 음성 구축 방법론

본 논문은 감정 표현을 자유롭게 조절할 수 있는 텍스트‑투‑스피치(TTS) 시스템을 구현하기 위한 3단계 방법론을 제시한다. 첫째, 다양한 감정 데이터를 수집·정제하고, EmoV‑DB라는 새로운 다국어 감정 데이터베이스를 구축한다. 둘째, 자동 감정 라벨링을 위해 ASR 기반 특징 추출과 비지도 학습 기반 잠재 공간을 활용한 표현 벡터를 생성한다. 셋째, 중립 TTS 모델을 소규모 감정 데이터로 파인튜닝하고, 감정 강도와 스타일을 연속적으로 제…

저자: Noe Tits

본 논문은 감정 표현을 자유롭게 조절할 수 있는 텍스트‑투‑스피치(TTS) 시스템을 구축하기 위한 전반적인 방법론을 제시한다. 연구는 크게 세 단계로 구성된다. 첫 번째 단계는 감정 음성 데이터 수집이다. 기존의 대규모 중립 음성 코퍼스는 감정 다양성이 부족하므로, 저자들은 EmoV‑DB라는 새로운 데이터베이스를 직접 구축하였다. 이 데이터베이스는 영어와 프랑스어 화자를 포함해 5가지 감정(유희, 분노, 혐오, 졸음, 중립)을 각각 2명·1명씩 녹음했으며, 총 7,000문장의 고품질 음성을 제공한다. 데이터는 무향실에서 수집되었고, CMU‑Arctic와 SIWIS 텍스트를 사용해 강제 정렬(gentle) 스크립트와 함께 제공한다.

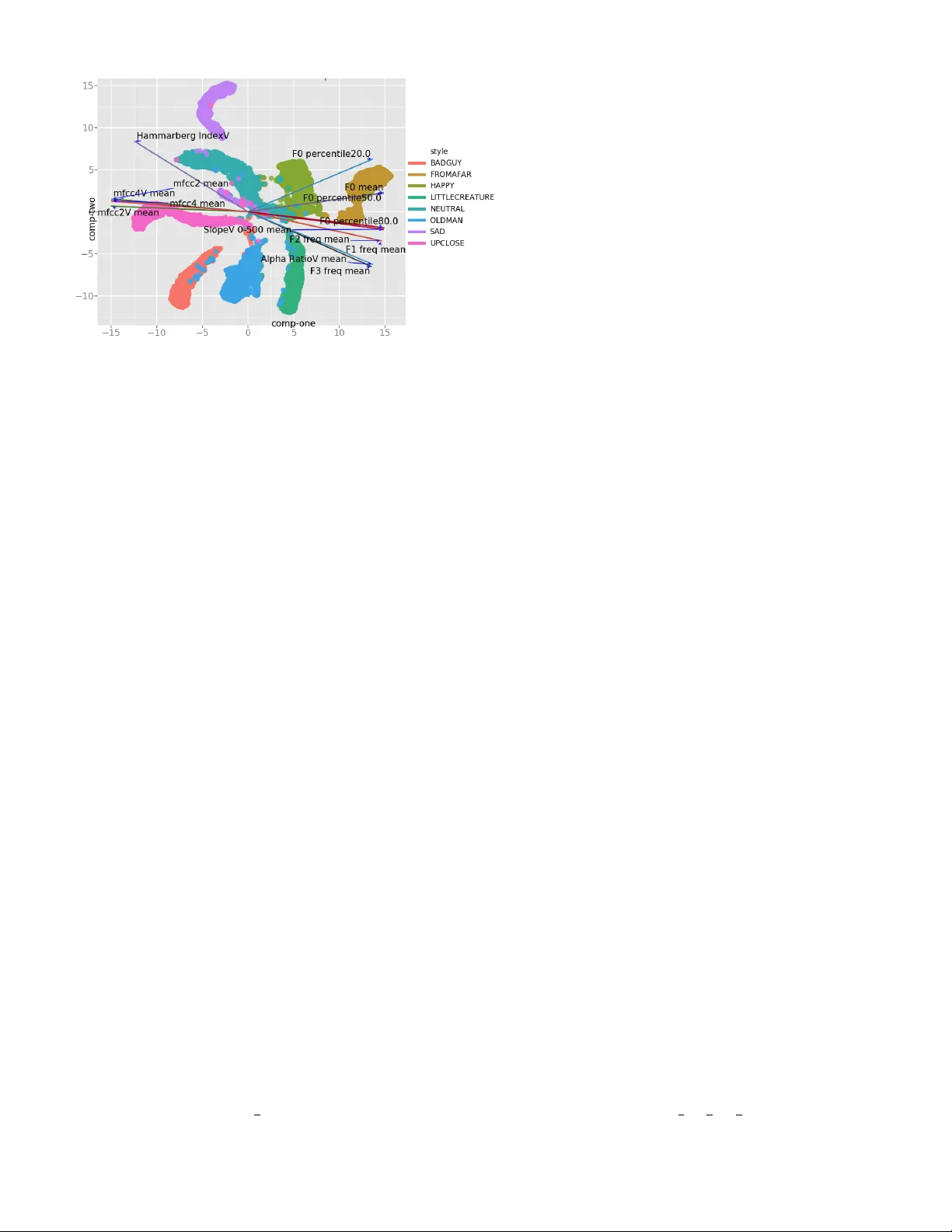

두 번째 단계는 감정/표현성을 자동으로 라벨링하고 특징을 추출하는 기술 개발이다. 이를 위해 두 가지 접근을 시도한다. 첫 번째는 자동 음성 인식(ASR) 모델을 활용한 감독 학습 방식이다. 15개의 dilated convolution 레이어와 128개의 gated convolution unit으로 구성된 WaveNet‑style ASR를 VCTK 데이터로 사전 학습한 뒤, IEMOCAP 데이터에 적용해 중간 레이어 출력을 특징으로 사용한다. 선형 회귀 모델을 통해 valence와 arousal를 예측했으며, 이때 얻은 특징이 기존 eGeMAPS 기반 특징보다 높은 상관성을 보였다. 이는 ASR가 음성의 다양한 변동성을 포착하면서 감정 신호도 내포한다는 중요한 증거이다. 두 번째는 비지도 학습 기반 잠재 공간 구축이다. 멜‑스펙트로그램을 8차원 임베딩으로 압축하고, 이를 UMAP으로 2차원 시각화한다. 각 임베딩 좌표와 전통적인 음성 특징(F0 평균, 지속시간, 스펙트럼 중심 등) 사이의 선형 관계를 분석해, 특정 방향으로 이동하면 해당 음성 파라미터가 선형적으로 변한다는 사실을 확인했다. 이러한 시각화와 회귀 분석은 감정 제어를 직관적으로 이해하고 설계할 수 있는 기반을 제공한다.

세 번째 단계는 감정 TTS 모델을 실제로 구현하고, 감정 강도와 스타일을 연속적으로 제어하는 것이다. 저자들은 DCTTS(Deep Convolutional TTS)를 기반으로 중립 음성(LJ‑Speech, 24시간)으로 사전 학습한 뒤, EmoV‑DB의 중립 부분으로 파인튜닝한다. 이후 각 감정 카테고리별로 별도 파인튜닝을 수행한다. 객관적 intelligibility 평가는 100문장에 대해 Word Error Rate 기반 정확도를 측정했으며, 전체 중립 모델(0.630) 대비 파인튜닝된 중립 모델(0.517)은 약간 감소했지만, 소규모 데이터만 사용한 모델(0.004)보다 현저히 높은 성능을 보였다. 이는 파인튜닝이 데이터 효율성을 크게 향상시킨다는 점을 시사한다. 주관적 MOS 테스트에서는 감정 인식이 가능했으나 intelligibility가 다소 낮아지는 트레이드오프가 존재한다.

감정 강도 제어를 위해 저자들은 디코더 입력에 감정 임베딩을 삽입하고, 학습 시에는 one‑hot 인코딩을 사용했지만 합성 단계에서는 연속값을 입력해 중립과 목표 감정 사이를 보간한다. 이 방식은 감정 강도를 수치적으로 조절할 수 있게 하며, 온라인 데모를 통해 실시간으로 감정 변화를 확인할 수 있다.

결론에서는 현재까지의 성과를 정리하고, 향후 연구 방향을 제시한다. 다화자 VAE‑TTS 모델을 도입해 여러 화자와 감정 데이터를 공동 학습함으로써 화자 특성, 음소, 감정 표현을 분리하고 일반화하는 것을 목표로 한다. 또한, 개발된 감정 임베딩과 시각화 도구를 실시간 제어 인터페이스에 통합해 사용자가 직관적으로 감정 강도와 스타일을 조절할 수 있는 친화적인 툴을 제공하고자 한다. 전체적으로 이 논문은 데이터 수집, 특징 추출, 모델 파인튜닝, 감정 강도 제어라는 전 과정을 포괄적으로 다루며, 감정 합성 음성 분야에 실용적인 로드맵을 제시한다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기