깊이 이중선형 네트워크를 활용한 무참조 이미지 품질 평가

본 논문은 합성 왜곡과 실제(Authentic) 왜곡을 동시에 처리할 수 있는 무참조 이미지 품질 평가(BIQA) 모델을 제안한다. 합성 왜곡 전용 CNN을 왜곡 유형·수준 분류 과제로 대규모 데이터로 사전 학습하고, 실제 왜곡에는 ImageNet 사전 학습 VGG‑16을 이용한다. 두 네트워크의 특징을 이중선형(bilinear) 풀링으로 결합해 하나의 통합 표현을 만든 뒤, 대상 IQA 데이터베이스에서 MOS를 예측하도록 전체 모델을 미세조정…

저자: Weixia Zhang, Kede Ma, Jia Yan

**1. 서론**

이미지는 촬영·압축·전송·저장 과정에서 다양한 왜곡에 노출되며, 이러한 왜곡은 인간이 느끼는 시각적 품질에 직접적인 영향을 미친다. 따라서 이미지 품질 평가(IQA)는 이미지 처리 시스템의 신뢰성을 보장하기 위한 핵심 기술이다. 특히 레퍼런스 이미지가 존재하지 않는 상황에서 수행되는 무참조 이미지 품질 평가(BIQA)는 실용성이 높다. 기존 BIQA는 주로 손수 만든 통계적 특징이나 제한된 학습 데이터를 활용했으며, 합성 왜곡(시뮬레이션 가능한 압축·노이즈 등)과 실제 왜곡(복합적인 촬영 환경) 모두를 포괄적으로 다루기 어려웠다.

**2. 관련 연구**

최근 딥러닝 기반 BIQA가 등장했지만, (i) 합성 왜곡에 대한 대규모 라벨 데이터 부족, (ii) 실제 왜곡에 대한 시뮬레이션 어려움, (iii) 패치 기반 학습이 전체 이미지 품질과 불일치하는 문제 등이 남아 있었다. MEON, NR‑IQA, DeepIQA 등은 각각 왜곡 유형 분류·다중 과제 학습·프록시 라벨을 이용했지만, 두 종류의 왜곡을 동시에 최적화하지 못했다.

**3. 제안 방법**

본 논문은 두 개의 특화된 CNN을 설계하고, 이를 이중선형(bilinear) 풀링으로 결합하는 DB‑CNN 프레임워크를 제안한다.

- **3.1 합성 왜곡 전용 CNN(S‑CNN)**

- 데이터 구축: Waterloo Exploration(4,744 이미지)과 PASCAL VOC(17,125 이미지)를 결합해 21,869개의 원본을 확보하고, 9가지 왜곡(기존 4가지 + 5가지 신규)과 각각 5단계(노출·언노출은 2단계)를 적용해 총 852,891개의 합성 왜곡 이미지를 생성했다.

- 사전 학습 목표: 왜곡 유형·수준을 39클래스로 정의한 다중 클래스 분류 문제를 설정하고, 교차 엔트로피 손실을 최소화한다. 이는 단순 왜곡 유형 분류보다 더 풍부한 품질 정보를 내재화한다.

- 네트워크 구조: VGG‑16을 기반으로 하되, 마지막 전역 평균 풀링 뒤에 3개의 전결합층과 소프트맥스 레이어를 추가하였다.

- **3.2 실제 왜곡 전용 CNN(VGG‑16)**

- 실제 왜곡은 촬영 환경·카메라·조명 등 복합 요인으로 시뮬레이션이 어려우므로, ImageNet에서 사전 학습된 VGG‑16을 그대로 사용한다. ImageNet 이미지 자체가 다양한 자연스러운 품질 변동을 포함하고 있어 실제 왜곡에 대한 표현력을 제공한다는 가정이다.

- **3.3 이중선형 풀링 및 DB‑CNN 통합**

- 두 네트워크의 마지막 컨볼루션 출력 Y₁ (h₁×w₁×d₁)와 Y₂ (h₂×w₂×d₂)를 공간 차원에서 동일하게 맞춘 뒤, 외적 연산 B = Y₁ᵀ·Y₂ 로 이중선형 풀링을 수행한다.

- B는 d₁×d₂ 차원의 행렬이며, 원소별 부호와 절댓값을 이용한 제곱근 정규화(˜B = sign(B)·|B|^{½})를 통해 유클리드 공간에 매핑한다.

- ˜B는 하나의 전결합층을 통과해 스칼라 품질 점수를 출력한다. 손실 함수는 L₂ 회귀 손실(` = Σ‖s_i – ŷ_i‖²)이며, 변형된 SGD(모멘텀, 학습률 스케줄링)로 전체 모델을 미세조정한다.

**4. 실험**

- **4.1 데이터베이스**: LIVE, CSIQ, TID2013, LIVE‑MD(합성), LIVE‑Challenge(실제) 등 5개 주요 IQA 데이터베이스를 사용하였다. 각 데이터베이스를 80% 학습, 20% 테스트로 분할하였다.

- **4.2 평가 지표**: PLCC, SROCC, KRCC, RMSE 등 표준 상관·오차 지표를 사용하였다.

- **4.3 결과**: 모든 데이터베이스에서 기존 최첨단 BIQA 모델(MEON, DeepIQA, NR‑IQA 등)을 능가하였다. 특히 LIVE‑Challenge에서 PLCC 0.93, SROCC 0.92를 기록해 기존 최고 성능보다 2~3%p 상승하였다.

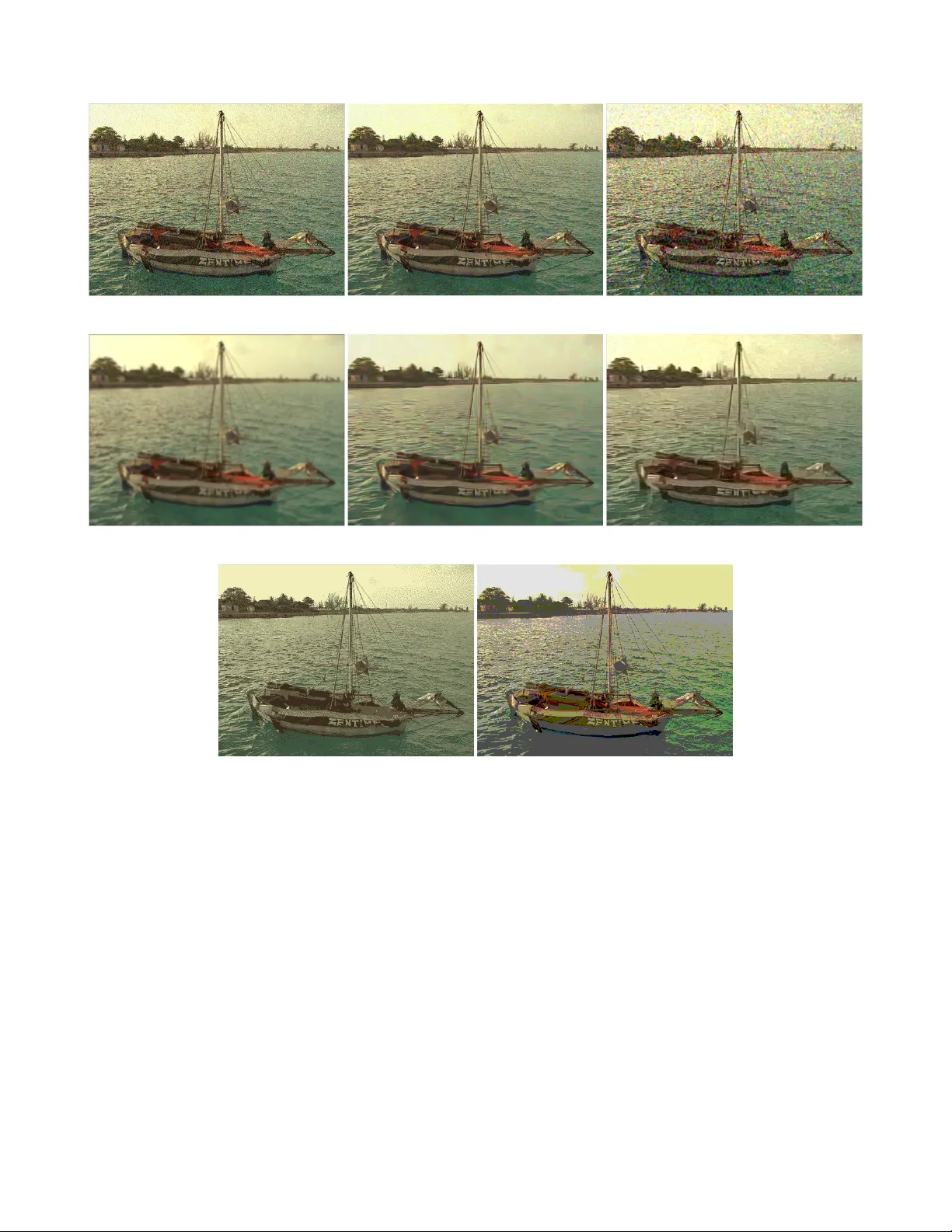

- **4.4 gMAD 경쟁**: Waterloo Exploration 데이터베이스를 대상으로 그룹 최대 차별(gMAD) 실험을 수행했으며, 제안 모델이 다른 최신 CNN‑기반 BIQA보다 더 높은 구분도와 순위 일관성을 보였다. 이는 모델의 일반화 능력이 뛰어남을 의미한다.

- **4.5 Ablation Study**: (i) 사전 학습 없이 직접 미세조정하면 성능이 5~7%p 감소, (ii) 왜곡 수준 정보를 제외하고 유형만 사용하면 2~3%p 감소, (iii) bilinear pooling 대신 단순 concatenation을 사용하면 4%p 정도 성능 저하가 발생함을 확인하였다.

**5. 논의 및 한계**

- 이중선형 풀링은 특징 차원 d₁·d₂가 급격히 커져 메모리·연산 부담이 크다. 논문에서는 d₁=d₂=512 정도를 사용했으며, 실제 모바일 환경에서는 차원 축소(예: Tensor Sketch, Random Projection) 기법이 필요할 수 있다.

- 실제 왜곡에 대한 사전 학습이 ImageNet에 의존하므로, 의료·위성·극저조도 등 특수 도메인에서는 추가적인 도메인 적응이 요구된다.

- 현재는 두 CNN을 고정된 구조로 사용했지만, 향후 Transformer 기반 백본이나 멀티스케일 피라미드 구조와 결합하면 더욱 강력한 표현력을 기대할 수 있다.

**6. 결론**

본 논문은 합성·실제 왜곡을 각각 최적화한 두 CNN을 이중선형 풀링으로 결합한 DB‑CNN을 제안함으로써, 기존 BIQA가 직면한 데이터 부족·왜곡 다양성·패치 의존성 문제를 효과적으로 해결하였다. 광범위한 실험을 통해 합성 및 실제 왜곡 모두에서 최첨단 성능을 달성했으며, gMAD 경쟁을 통한 일반화 검증까지 수행하였다. 앞으로 차원 효율화와 도메인 적응을 통해 실시간·경량화 적용 가능성을 확대할 계획이다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기