오디오만으로 강의 영상 자동 생성 루미에르넷

루미에르넷은 강사의 오디오 내레이션을 입력으로 받아, 전체 포즈와 배경을 포함한 고품질 헤드샷 강의 영상을 자동으로 합성하는 완전 딥러닝 기반 파이프라인이다. 오디오 → 잠재 코드 → DensePose → 영상 순서의 모듈형 구조와 BLSTM, VAE, SeqPix2Pix 세 가지 신경망을 활용해 각 단계별 학습과 최적화를 독립적으로 수행한다.

저자: Byung-Hak Kim, Varun Ganapathi

본 논문은 온라인 교육 플랫폼에서 강사의 오디오 내레이션만으로 전체 포즈와 배경을 포함한 고품질 강의 영상을 자동으로 생성하는 시스템, LumièreNet을 제안한다. 기존 연구들은 주로 입술 영역이나 얼굴 일부만을 합성했으며, 강사의 감정과 의사소통은 몸짓·자세·제스처까지 포함된 전신 움직임에 크게 의존한다는 점을 간과했다. 이를 보완하기 위해 저자들은 오디오 → 비디오 변환 과정을 확률적 그래프 모델로 정의하고, 두 개의 중간 변수 w (DensePose 기반 포즈 이미지)와 z (압축된 잠재 코드)를 도입해 조건부 독립성을 확보하였다. 이 설계는 전체 변환을 P(y|x)=P(y|w)·P(w|z)·P(z|x) 라는 세 단계 곱으로 분해함으로써 각 단계별 네트워크를 독립적으로 설계·학습할 수 있게 한다.

첫 번째 단계는 오디오 특징 추출과 BLSTM 매핑이다. 오디오는 40개의 로그 멜‑필터뱅크를 44 ms 윈도우, 33.3 ms 간격으로 추출해 정규화한 뒤, 15 프레임 길이의 look‑back 윈도우와 함께 양방향 LSTM(각 방향 256 셀)으로 처리한다. BLSTM의 출력은 128 차원의 잠재 코드 z 로 변환되며, 이는 시간적 연속성을 유지하도록 설계되었다.

두 번째 단계는 VAE를 이용한 z → w 변환이다. 사전 학습된 DensePose 추정기(OpenPose·DensePose)로부터 얻은 2D U,V 맵을 VAE 인코더에 입력해 평균·분산 파라미터를 추정하고, 샘플링된 z 를 디코더가 복원해 DensePose 이미지 w 를 생성한다. 여기서 VAE는 전통적인 픽셀‑L2 손실 대신 VGG‑19 기반 퍼셉추얼 손실을 사용해 구조적 일관성을 강화한다.

세 번째 단계는 SeqPix2Pix를 통한 w → y (실제 영상) 변환이다. 기존 Pix2Pix는 프레임별 독립적인 이미지‑투‑이미지 매핑에 머물렀지만, 영상 생성에는 시간적 일관성이 필수이다. 저자들은 G(Generator)를 w → y 매핑에 사용하고, 추가적인 Temporal Predictor P를 도입해 이전 L 프레임(논문에서는 L=2)과 현재 G(w) 출력을 입력으로 다음 프레임을 예측하도록 설계했다. 손실 함수는 LS‑GAN 손실에 퍼셉추얼 L2 손실(λ₀)과 두 종류의 L1 픽셀 손실(λ₁, λ₂)을 가중합한 복합 형태이며, PatchGAN 대신 전역 구조를 보존하는 디스크리미네이터를 사용한다.

학습 절차는 먼저 VAE를 독립적으로 학습하고, 이후 BLSTM과 SeqPix2Pix를 병렬로 학습한다. VAE는 RMSProp(lr=2.5e‑4)으로, BLSTM은 RMSProp(lr=1e‑6)으로, SeqPix2Pix는 Adam(lr=2e‑4, β₁=0.5, β₂=0.999)으로 최적화한다.

실험은 Udacity 스튜디오에서 4시간 분량의 강의 영상을 촬영해 진행했다. 영상은 30 fps, 1920×1080 해상도로 촬영 후 455×256으로 리사이즈하고 중앙 256×256을 사용했다. 오디오는 48 kHz→16 kHz로 변환했다. DensePose 추정은 COCO‑DensePose 데이터로 사전 학습된 ResNet‑101 모델을 사용했으며, SeqPix2Pix 학습 시 30프레임당 1프레임만 샘플링해 효율성을 높였다.

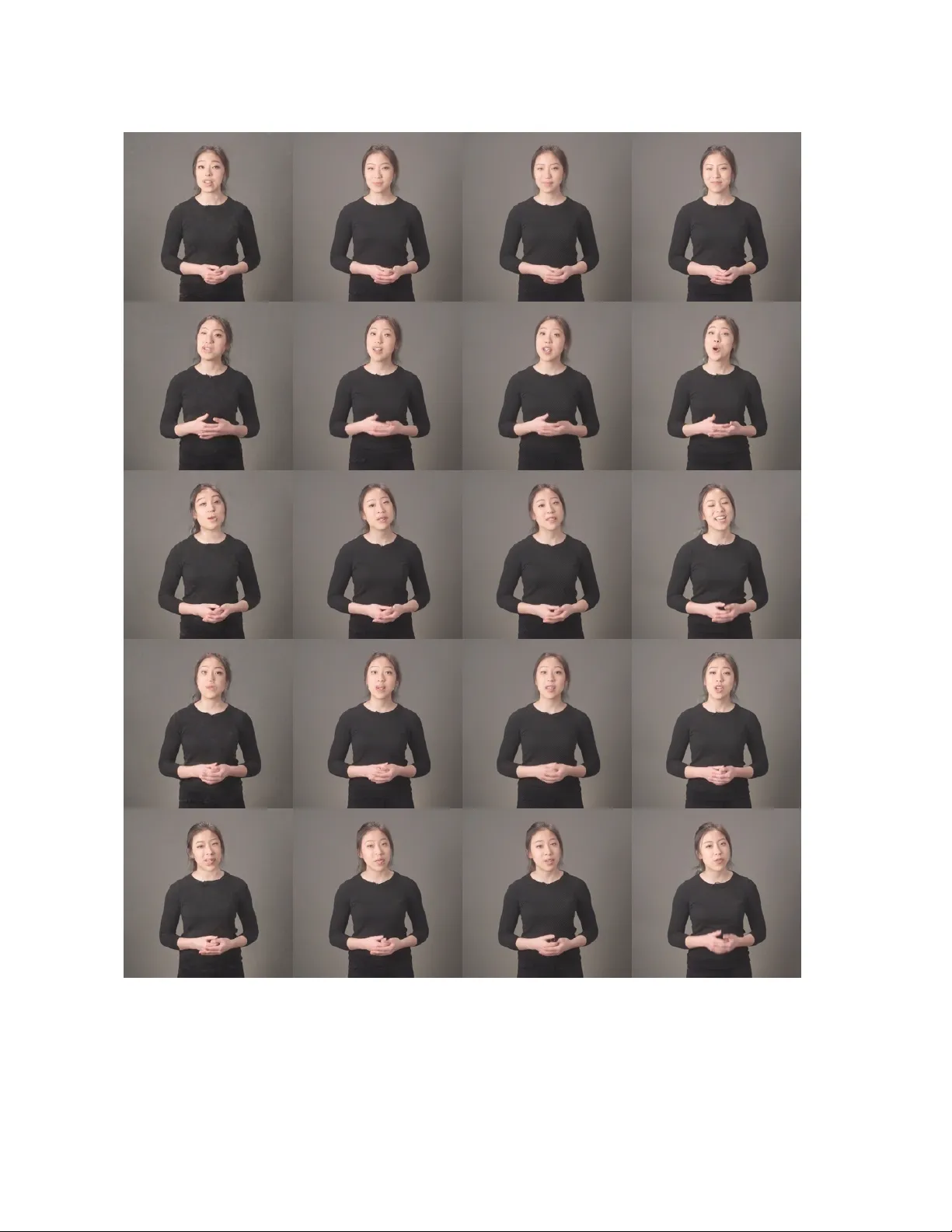

정량적 평가는 MSE, PSNR, SSIM으로 수행했으며, BLSTM의 look‑back 윈도우 W=15 가 가장 낮은 MSE를 보였다. VAE 재구성 결과는 정면 얼굴과 몸통 형태를 거의 완벽히 복원했지만, 손가락 사이의 경계가 흐릿해 최종 영상 품질에 영향을 미쳤다. 최종 영상 생성에서는 Test Set 1과 Test Set 2 모두에서 Baseline 대비 SSIM이 0.88~0.93 수준을 기록했으며, PSNR은 약 29 dB에 도달했다.

본 논문은 완전 모듈형 딥러닝 파이프라인을 통해 오디오만으로 전신 강의 영상을 생성할 수 있음을 입증했으며, 각 모듈을 독립적으로 개선하거나 교체할 수 있는 확장성을 제공한다. 현재 한계는 미세 움직임(눈 깜빡임, 손가락 디테일) 재현과 배경 다양성이다. 향후 연구에서는 텍스트‑투‑비디오, 다인물 강의, 실시간 인터랙티브 시스템 등으로 확장하고, 합성 영상에 대한 윤리적 표기와 강사 동의 절차를 강화할 필요가 있다.

원본 논문

고화질 논문을 불러오는 중입니다...

댓글 및 학술 토론

Loading comments...

의견 남기기